NVIDIAのDGX B200を用いたスパコンを東京工科大が構築へ

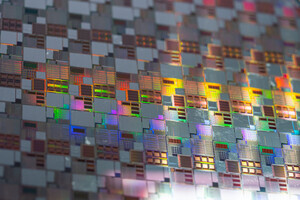

東京工科大学は6月11日、NVIDIAのBlackwell GPU アーキテクチャを採用した統合型AIプラットフォーム「NVIDIA DGX B200」を用いたAIスーパーコンピュータ(スパコン)を構築し、2025年10月より本格稼働させる計画を発表した。

同AIスパコンは、DGX B200システムを12台、NVIDIA Quantum InfiniBandの高速ネットワークで接続し、NVIDIA DGX BasePODリファレンス アーキテクチャに基づいて設計されるもの。システム全体のAIの学習理論性能(FP8)は0.9EFLOPSで、国内の私立大学では最大級のAIスパコンになるという。

2023年よりNVIDIAと連携を進めてきた東京工科大

同大は2023年にNVIDIAの日本法人と学術交流連携を締結。AIにとどまらず、人材育成や研究のコラボレーションも推進してきており、例えばNVIDIAテクノロジーの活用と啓蒙が可能な学生の育成を目指す「NVIDIA 学生アンバサダープログラム」では、同大の学生がNVIDIA社員のサポートを受けながら生成AIやロボティクス、デジタルツインのテクノロジーを習得するといった協業を進めてきたという。

今回のAIスパコン設置について同大では、AIスキルを身につけるための最短ルートは実践にあるとの考えのもと、学生が小規模なデータや小規模なプロジェクトだけで満足していては、将来イノベーションを生み出すようなAI活用の本質を学ぶことはできないとの判断から、計算資源の制約にとらわれることなく、大規模データと高性能な計算環境を活用しながら学び続けられるようにすることを実現するべく投資を決定したと説明している。

演算性能だけでなく、AI活用に向けたソフトでも協力

そのため単なるハードウェアの拡充に留まらず、NVIDIA NIM や NeMo マイクロサービスを含むソフトウェア ツール、ライブラリ、フレームワークで構成されるクラウド ネイティブのスイートである「NVIDIA AI Enterpriseソフトウェア プラットフォーム」の導入も決定しており、AIの活用を推進していくことを目指すとする。

具体的には2025年度以降の主要プロジェクトとして、AI技術の実装経験を通じて、産業界で即戦力となるAI人材を育成するプログラムの推進や、セキュアな学内環境において、専用の大規模言語モデル(LLM)を構築し、教育・研究・業務支援への応用を図る取り組み、AIの社会実装において求められる倫理的・法的観点の教育と検証を行う環境を整備し、責任あるAIの活用を促進する取り組み、NVIDIA Omniverseのテクノロジーを用いた、現実世界と仮想空間を結びつけるデジタルツインの構築により、ものづくりや都市設計における革新的な実証研究、AIの判断根拠を人間が理解できるようにする説明可能AI技術(XAI)を用いた透明性・公平性・法的信頼性のあるAI開発、高性能計算機とAIの融合により、従来の手法では困難だった複雑な物理現象の高精度な解析と予測などを予定しているという。

-

東京工科大学の学生が制作する女性のAIデジタルヒューマン「KIANA」。3DCGで女性の外観をデザインし、リアリティのある表情の動きができることに加え、NVIDIAのAIプラットフォームとつないで自然言語で会話ができように開発が進められているという (提供:東京工科大)

なお、同AIスパコンは、同大AIテクノロジーセンターの「AI中核拠点(TUT AI CORE BASE)」に設置される予定だという。