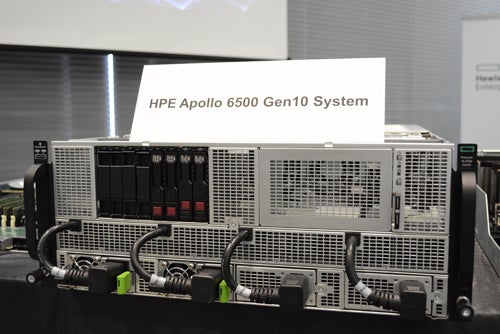

日本ヒューレット・パッカード(HPE)は4月23日、都内で記者会見を開き、AI(人工知能)/ディープラーニングに適し、「NVIDIA Tesla V100 GPU」を搭載したサーバ「HPE Apollo 6500 Gen10 System」を発表した。

企業が使えるAI/ディープラーニングに適したサーバ

新製品について、日本ヒューレット・パッカード ハイブリッドIT事業統括 ハイブリッドIT製品統括本部 カテゴリーマネージャーの高橋健氏は「用途は外観検査、自動翻訳、人物検出、HPCとなり、特に強みを持つのが外観検査だ。特徴としては『エンタープライズ環境に最適な設計』『幅広いワークロードに応える柔軟性』『サポートサービス』の3点となる」と説明した。

エンタープライズ環境に最適な設計に関しては、HPE ProLiantDL380 Gen10サーバをベースに8基のV100 GPUの搭載を可能とし、SAS/SATA×16、NVMe×4をサポートするDL380 Gen10ドライブケージ×2、2200W 80plus Platinumのパワーサプライを最大4個搭載。

また、GPUモジュールはPCIe Gen3×4に加え、高帯域かつエネルギー効率の高いNVIDIA NVLinkインターコネクト向けにSXM-2も利用できるという。マザーボードモジュールはFlexL OM、USB×2、VGA、1Gbe×4、LP PCIe Gen3×16となる。ラックは業界標準の1075mmラックのため、前世代のGen9では必要であったエンクロージャ、電源用筐体を不要としている。

幅広いワークロードに応える柔軟性についてはNVIDIA Tesla V100 GPUに加え、PCIeとSMX-2に対応した「NVIDIA Tesla P100 GPU」や「NVIDIA Tesla P40 GPU」「AMD Radeon Instinct M125」に対応し、近日中には32GBのV100 GPUのサポートを予定している。

GPUの接続パターンはハイエンドモデルの「NVLink 2.0」、スタンダードモデルの「PCIe 4:1」「PCIe 8:1」の3つを用意。NVLink 2.0はGPU間の通信帯域が広く、1つのGPUから複数のGPUに接続することを可能とし、AI/ディープラーニングのワークロードにおいてGen 9と比較し、最大3倍の性能向上を確認しており、学習に要する時間を3分の1に短縮することができるという。

PCIe 4:1とPCIe 8:1は、ディープラーニングの技術者でも、どちらのトポロジーが有効か判断することは難しいため、BIOS設定の変更だけで接続トポロジーの切り替えを可能としている。

サポートサービスでは、これまでAI/ディープラーニングは学術系での採用が多かったが、新製品は企業でも活用できることを意識している。

オンプレミス環境の従量課金モデル「HPE GrenLake Flex Capacity」や独自のリモートツールを用いた「プロアクティブケア」、システム管理を効率化する「プロアクティブケアアドバンス」、問題発生時の対応を行う「ファウンデーションケア」、IT環境のカスタムサポートを担う「データセンターケア」、「運用支援サービス」など幅広いサポートを提供する。

新製品の施策とは

新製品の施策としては、企画から実装、運用・改善までデータ分析プラットフォームの活用総合的に支援。ディープラーニング開発環境の構築を目的に新製品へのOS、ディープラーニングフレームワーク基盤を導入する「Deep Learning開発環境構築サービス」を提供。

また、フレームワークやGPUなど、最適なハードウェアとソフトウェアを選定することを支援するツールとして「HPE Deep Learning Cookbook」を提供する。

同ツールは、ベンチマークツールをオープンソース化し、GitHub上にアップしている「Deep Learning Benchmaking Suite」と、HPEラボにおけるベンチマーク結果にアクセス可能なWebベースで公開している「HPE Deep Deep Learning Perfomance Guide」、ディープラーニングワークロード向けのハードウェアとソフトウェアのレシピ「Reference Designs」の3つで構成している。

さらに、6月にはHPEの大島本社のソリューションセンターにNVLinkに対応したNVIDIA Tesla V100を8基フル搭載した新製品を設置し、GPUベンチマークセンターのオープンを予定しており、リモートでのアクセスも可能だという。

エヌビディア エンタープライズ事業部 事業部長の井﨑武士氏は「これまで、われわれのGPUはインターネット、医療、工業・製造業、セキュリティ、管理・物流、大学のスーパーコンピュータなど幅広く活用されている。今後、ディープラーニングにおけるネットワークのサイズ、アルゴリズム、要求される計算能力は高まり、複雑さが増していくため、柔軟なシステムが必要になることから、新製品のシステム構成が課題解決に役立つと考えている」と、述べた。

HPEが目指す“ビジネスのためのAI”

日本ヒューレット・パッカード ハイブリッドIT事業統括 ハイブリッドIT製品統括本部の本田昌和氏はAI for Businessを実現するAI戦略について次のように説明した。

「ビジネスにおけるAI活用における課題は、AI専門家の不在や人的リソースの不足、プラットフォーム構築の難易度が高いため統合ソリューションの欠如に加え、パートナーエコシステムの活用だ。われわれは企業における多様なAIの実現を支援していく」。

これらの課題に対し、同社ではHPEラボの知見やデータ活用支援サービスなどAI活用の総合支援サービス、GPU利用方式への対応をはじめとした統合AIソリューションを備える。また、NVIDIAとの技術革新や、高速スケールアウト型のファイルストレージシステムを提供するWekaIOとのパートナーシップを締結している。

本田氏は「これまで、研究機関や大学の研究機関で使われていた製品の活用ニーズが一般ユーザーでも高まっているため、新製品は活用の幅を拡大していくための製品だ」と、強調していた。