AMDが先ごろ、おひざ元のサンノゼ市で「AMD Advancing AI」と題するAI向け半導体の新製品発表の大規模なイベントを開催した。

いかにも勢いのあるCEOのLisa Suの登壇の様子を見ていて、「いよいよAI半導体市場での本格的な技術開発競争の時代が始まったな」という印象を持った。空前のAIブームに乗って、総売り上げで世界最大の半導体企業となったNVIDIAに対し、競合AMDとしてその独り勝ち状態を見過ごさないという強い決意が感じられ、MI300A/Xシリーズを中心に据える半導体製品の仕上がりと重要顧客各社との協業に大きな自信を持っていることを伺わせるイベントとなった。

大規模イベントの開催で自信を見せるAMD

巨大なAI市場が出現して、加速的に拡大するずっと以前から高性能グラフィックス・プロセッサー(GPU)の市場で競合してきたAMDだが、GPUのAIアクセラレーターとしての活用にいち早く目をつけたNVIDIAとの差はこの数年でみるみる広がった。CPU市場では宿敵Intelとの技術競争で大きく健闘しているAMDであるが、突如出現したAI半導体の巨大市場ではNVIDIAの図抜けた成長に完全に差をつけられているのが現状である。

前回のイベントでNVIDIAを次のターゲットに据えることを宣言したAMDのCEO、Lisa Suが自信たっぷりにその成果を紹介する姿が印象的だった。

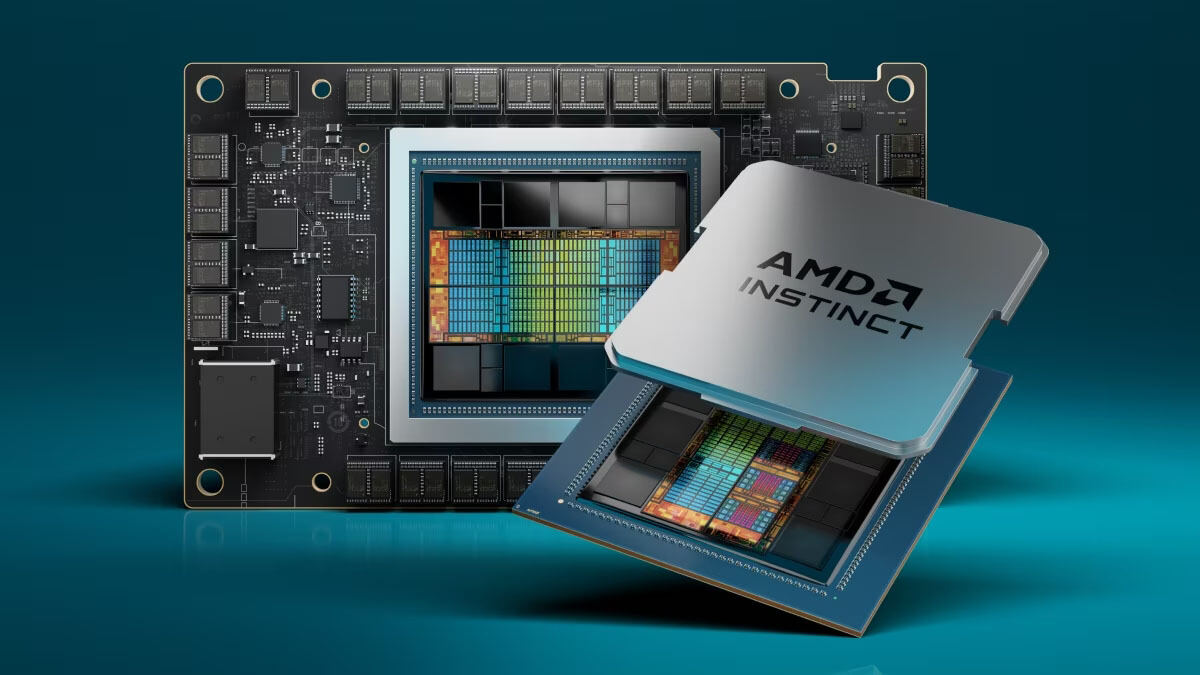

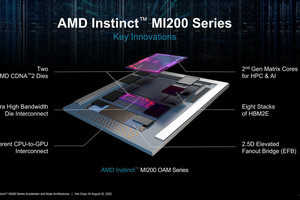

第3四半期から出荷が始まった「Instinct MI300A/X」という大規模なチップレット製品群を中心に、重要顧客・パートナーとの協業の成果がかなり明瞭な形で提示された。半導体製品の性能ベンチマークでは各環境でのNVIDIA製品との直接比較をはっきりと示した。かつてAMDは常にCPU市場での宿敵Intelとの直接比較を示してきたが、今回の比較のグラフではNVIDIAの黄緑のコーポレートカラーに置き換わっている。すべてNVIDIAの最新製品H100との比較であるが、NVIDIAの次期製品H200との比較も今後製品が入手可能になった段階で公開することになるだろう。熾烈な技術競争がこれから本格的に始まるという予感は、かつてIntelとの競争をじかに経験した私としてはわくわく感が大いに刺激される。

AMDのAI半導体製品の仕上がりが上々であることを明確に示しているのが、今回のイベントで次々に登壇した協業顧客・パートナーの充実ぶりである。HPE、Dell、Supermicroといったサーバー製品提供者に加えて、AI市場で鎬を削るCSP(Cloud Solution Provider)の4大プラットフォーマーのうち、MicrosoftのAzureとOCI(Oracle Cloud Infrastructure)が採用を決めた。かねてより指摘されていたNVIDIAの開発ソフトウェア環境での圧倒的な優位性も、AMD版CUDAとも言えるROCmを現在のAI市場で最も重要視されてる生成AI/LLM(大規模言語モデル)に最適化したバージョンにアップグレードし、その差を少しずつ縮めていると感じる。

NVIDIAによって完全に囲い込まれたCUDAの環境は、開発者にとっての使いやすさの点においてはまだまだ圧倒的な優位性があるが、肝心のH100のようなハード製品が供給不足で超高値が続く状況では、あくまでオープン環境でパートナーとの協業を積極的に模索するAMDを支持する顧客も出てくるというのはこの業界の必定だ。

半導体業界はメインフレーム、パソコン、スマートフォンといった巨大市場が加速的に拡大する度にひしめく競合の切磋琢磨で技術を発展させてきた。我々はこの一年、AI市場の拡大過程を目の当たりにしてきたが、その中で繰り広げられる加速的な技術競争は、業界に身を置く事のまさに醍醐味なのだと感じる。

NVIDIAとがっちり手を組むAmazon/AWS

最近の発表会でもうひとつ目を引いたのが、AWSの発表会である。「Re:Invent AWS」と題されたこの年次イベントでAWSは自社開発のAIプロセッサーの最新製品「Graviton4」と「Trainium2」を発表した。両製品とも従来のAWS自社開発AIプロセッサーのデザインをさらにアップグレードし、絶対性能の向上と消費電力の低減を実現したという。

Amazon全体でのAWSビジネスの比率は拡大の一途をたどり屋台骨ともなっている。クラウド事業でのAIサービスの進化はそれ自体がクラウド提供者の価値を決める時代になっている。かつてはCPUベースであったサーバーセンターは、多くのノードがGPUや専用プロセッサーベースに置き換わっている。こうした状況でAIサービスの付加価値向上に必須なワークロードを高速に処理するためには、自社開発プロセッサーによるサービスの差別化はますます重要になってくる。

このAWSのイベントで私が注目したのは、NVIDIAのCEO、Jensen Huangが登壇し、NVIDIAの次期製品H200/GH200の供給でAWSを強力にサポートすると強調したことだ。米国有力紙の報道によればJensen HuangがAWSの年次イベントに登壇するのは今回が初めてであるらしい。AWSの自社開発AIプロセッサーの発表に、競合ともとれるNVIDIAのCEOが登壇するという奇妙なシーンを見て、「どうやら業界の主要プレーヤーは自社の企業価値を高めるために、どこと組むかをはっきり決める時代に入ったな」、という感想を持った。

こうした主要プレーヤー同士の協業が明らかになってくるというのは市場での競争が加速化し「勢力地図」が形成されている証拠である。クラウド事業でAWSが最も警戒するのがMicrosoftである。2023年のAWSの売り上げは約900億ドルであるが、2位につけるMicrosoftは650億ドルで、ChatGPTを取り込んで勢いに乗るMicrosoftはAWSとの差を縮めている。MicrosoftもAIプロセッサーの自社開発を進めており、それとは別にAMDとの共同開発によるデザインも進行しているという。

かつてのx86互換CPUの乱立時代を思い出させる展開

こうしたダイナミックな業界の動きを見ていて、思い出すのがパソコン・サーバー市場の急拡大の時期に百花繚乱のごとく出現したx86互換CPU乱立の時代である。

結局、最終的にAMDとIntelが残ったが、当時のAMDにとっては大手顧客の取り込みは必須命題であった。数あるPC/サーバーブランドの中で、最もIntelと関係が親密だったDellは、CEOのMichael Dellが「Dellは未来永劫100%、Intelだ」と公言してはばからなかったが、AMDが64ビット処理のOpteronプロセッサーの発表をすると、Dellの大手企業顧客がDellへのOpteron実装を要求する事態となり、DellとIntelの蜜月は終わりを告げた。

急拡大するAI市場では、半導体ハードウェアのCPUに加えてGPU、そして自社開発の専用チップ、またサーバーハードウェア・ソフトウェアの提供者、開発者コミュニティー、クラウドサービスの提供者といった具合に、主要プレーヤーとなる登場人物が格段と多様化している。今後の勢力地図がいったいどのようになるのかが注目される。