「GPT-4o」はOpenAIが開発したマルチモーダルな生成AIです。「o」は「omni」の頭文字で「全体」を意味しており、テキストのみではなく音声や画像にも対応しています。2024年5月13日に発表され、これまでのGPT-4同様に、スマホアプリやAPI経由などで利用可能です。加えて、MacOS向けのアプリも提供されるようになりました。

このGPT-4oは、ChatGPTの無課金ユーザーでも利用できます。これまで有料版の利用に二の足を踏んでいた方もぜひ試してみてください。なお、GPT Storeに登録されているGPTsを、無課金ユーザーも利用可能となりました。

-

GPT-4oの紹介(OpenAIの公式サイトより)

実際、何がすごいの?

「早い、安い、自然」と3拍子揃っているのが、GPT-4oの特徴です。

これまでのGPT-4よりもレスポンスが早く、API利用時の料金は半額となっています。そして、より“人間に近い”機能を備えていると言われています。例えば、笑いを含むリアクションをしたり、シーンに合わせてさまざまな口調や言い回しをしたりといった具合です。

ただし、実際どんな感じなのかは見てみないと分かりにくいと思います。OpenAIが公開している1分強のYoutube動画「Say hello to GPT-4o」を見ると、イメージを素早くつかむことができるでしょう。

動画の中では、人間とChatGPT(GPT-4o)の音声によるやり取りが行われています。特徴的な箇所は以下の会話部分で、リアクション含めて極めて自然な会話となっています。

人間:「新しい製品の発表がある。実はあなたに関するものなんだ」

ChatGPT(GPT-4o):「ん? 私? 」(少し笑いながらリアクション)

また、同じくOpenAIが公開している「Two GPT-4os interacting and singing」では、スマホにインストールされた2つのAI同士を対話させている様子が見られます。音声や画像を認識した上で会話が展開されており、まるで人間同士のやり取りのような世界が実現できているのです。

ただし、2024年5月13日の発表において、「We'll roll out a new version of Voice Mode with GPT-4o in alpha within ChatGPT Plus in the coming weeks.」とあります。つまり、GPT-4oで進化した音声機能については、今後リリースされる予定となっています(2024年6月30日現在)。もちろん、従前からのGPT-4の音声機能は利用可能です。

モデルの精度

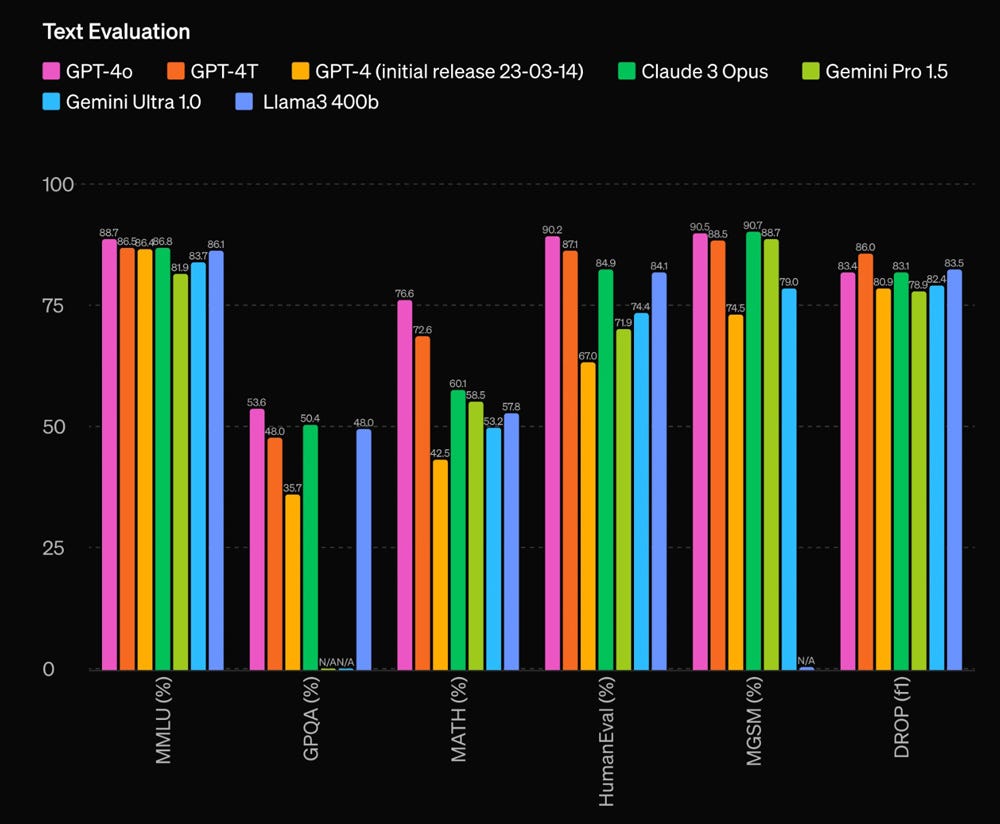

F GPT-4oはOpenAIのフラグシップモデルとなっており、以下の通りMMLU(Massive Multitask Language Understanding )などさまざまなベンチマークで高い精度を誇っています。

GPT-4oとGPT-4でそれぞれどんなモデルが使われているかは、公式サイトを参照してください。

なお、2024年6月21日に米Anthropicから「Claude 3.5 Sonnet」が発表され、次々と新しいモデルや、新たな機能が生まれてきています。

Mac版アプリが利用可能に

従来、スマホ版のアプリを使っていたが、Macでも使いたいと思っていた方もいらっしゃるのではないでしょうか。以下に、Mac版アプリのインストール方法と使い方を紹介します。

ChatGPTの画面にMacのSafariなどでアクセスすると、Mac版アプリが利用可能な旨の通知が表示されます。

画面右上のアカウントのアイコンをクリックし、「macOSアプリをダウンロードする」を選択します。

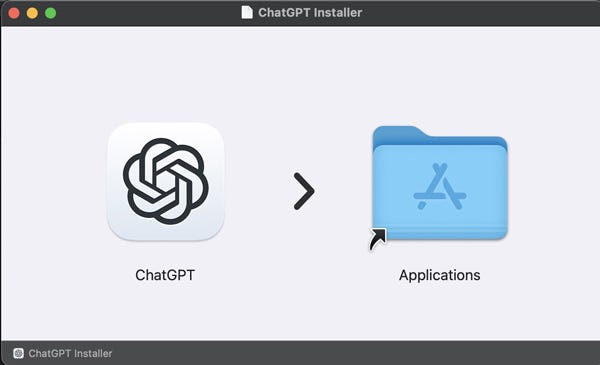

「ChatGPTDesktoppublic_latest.dmg」ファイルがダウンロードされます。ファイルをダブルクリックし、以下のように通常のdmgファイルと同様の方法でインストールします。

LaunchpadからChatGPTを開いてログインすると、GPT-4oモデルが選択されていることが分かります。また、スクリーンショットを撮ってGPT-4oに聞いたり、右下のヘッドフォンアイコンをクリックすることで音声チャットを開始したりすることもできます。

ランチャー経由での起動も可能です。

インストールと簡単な利用方法の紹介は以上です。

なお、今後ChatGPTと通常のPC操作がよりシームレスになっていくことが考えられます。例えば、2024年6月10日に米Appleから「Apple Intelligence」が発表されました。これにより、今後、「ユーザーがツールの間を行ったり来たりしなくても、ChatGPTの専門知識や画像と文書を理解する機能にアクセスできる」ようになるとされています。

究極的には、ChatGPTを使っているということをあまり意識することなく、便利な機能を享受できるようになると考えられます。

マルチモーダルに触れてみる

では、今回のタイトルにもなっている「マルチモーダル」とは何でしょうか。

GPT-4oはテキスト以外、つまり音声や画像、動画のモーダルにマルチに対応しています。つまり、テキストによるチャットボットとしての側面に加えて、音声(を処理する耳・口)と画像(を処理する目)を持っているというわけです。

これらをマルチに組み合わせた例を3点紹介します。

1. 画像の中のテキストも識別

ChatGPTでは、もともと画像の取り扱いが可能でした。画像の読み込みには「GPT-4V」が、画像生成には「DALL・E3」が使われていました。

では、それらと比べてGPT-4oは何が優れているのでしょうか?

まず、統合的なモデルであることにより、文字と図を同時に扱える点です。旧来、DALL・E3で画像を生成し、GPT-4 turboでテキストを作成していました。つまり、画像生成用のモデルとテキスト生成用のモデルが分かれていました。そのため、文字を含んだ画像のように、文字と画像を同時に取り扱うのが難しかったのです。

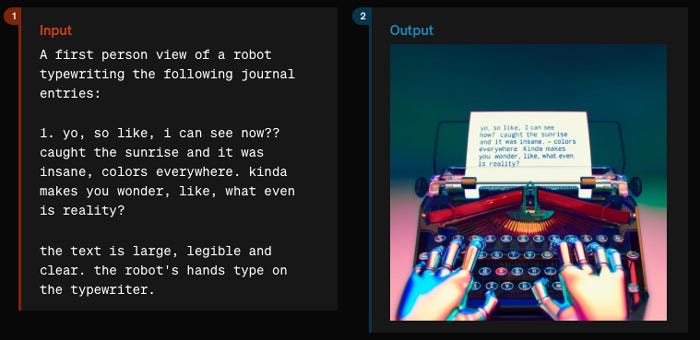

GPT-4oでは、「図の中に文字を入れ込む」という、画像とテキストを組み合わせて扱う機能が強化されています。「ロボットがタイピングしている様子をロボットの視点で描写してほしい。記載する内容は~~の通り。」といったプロンプト(下図左側)を入力すると、テキスト付きの画像が生成(下図右側)されます。

2. 音声チャットの結果をテキストに

MacのChatGPTアプリで音声機能を使ってみましょう。右下の音声ヘッドホンのアイコンをクリックします。

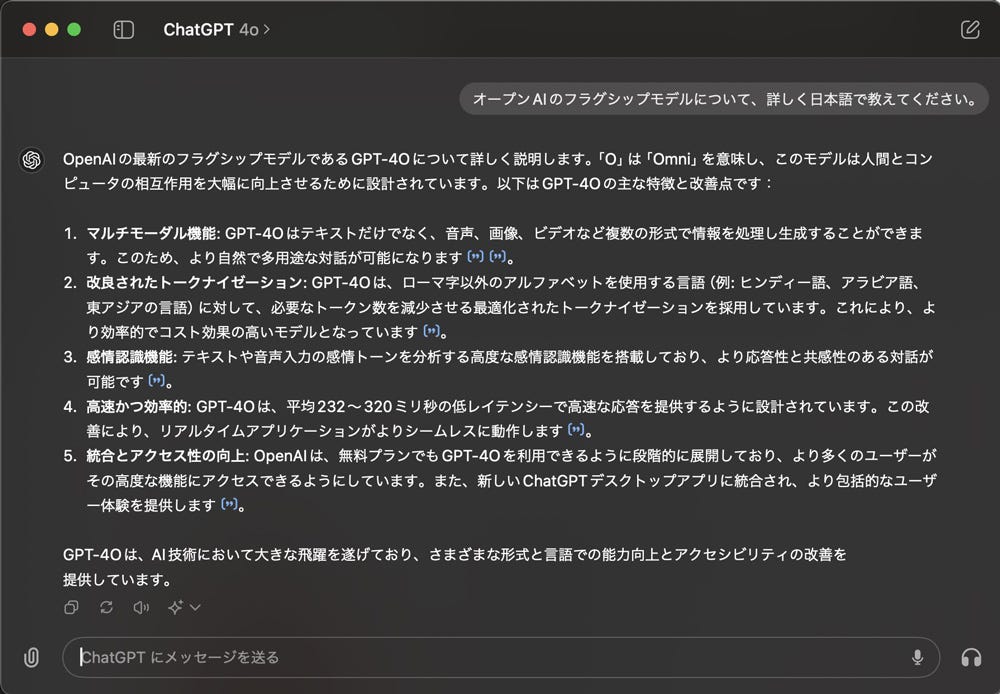

すると、以下の画面が表示されます。早速、話しかけてみましょう。今回は、「Open AIのフラグシップモデルについて、詳しく日本語で教えてください」と話しかけてみます。

話し終えたら少し待つと、返事が返ってきます。ゆっくり考えて話をしたい場合は、画面をドラッグしたまま発話します。「送信するには指を離します」と表示されるので、話し終わったらドラッグをやめます。

会話した内容はテキストで記録されていますので、後で見返すこともできます。

なお、[設定]-[スピーチ]-[音声]から、好みに合わせた音声を選択することができます。

【コラム】オンライン英会話としての活用

日本人の中には、ビジネスなどで英会話が必要なケースに頭を悩まされている方も多いのではないでしょうか。受験英語、オンライン英会話、TOEIC。さまざまな学習法がありますが、「試してみたが、なかなか続かなかった」という方もいらっしゃると思います。特に、スピーキングを練習するには、オンライン英会話が最も手軽な方法であるものの、ハードルが高いと感じられることもあるでしょう。 ChatGPTの音声チャットを使うと、いつでも、気兼ねなく、何度でも、英会話を練習できます。例えば、以下のように話しかけることでそれぞれの学習が可能です。- 基本的な会話練習:「今日の天気について英語で話しましょう。」

- 文法の質問:「"have"と"have got"の違いは何ですか?」

- 単語学習:「"sustainability"という単語の使い方を教えてください。」

- リスニング練習: 「短いストーリーを英語で話して、その内容を要約してください。」

- 発音練習:「この文章を正しい英語の発音で読んでください。」

特にオススメなのが、英語の先生になってもらうことです。ビジネスや日常生活で英語を利用されている方は、普段の利用シーンに応じて、話題を展開していくと良いでしょう。例えば、前回の会議で言えなかった言い回しを再度練習してみる、今度のプレゼンテーションの内容を練習してみる、といった使い方があります。次のように話しかけてみましょう。

「あなたは英語の先生です。英語力をつけたいので、英語で会話しましょう。私の英語が間違っていたら直してください。今日のテーマは生成AIです。それでは始めましょう。」

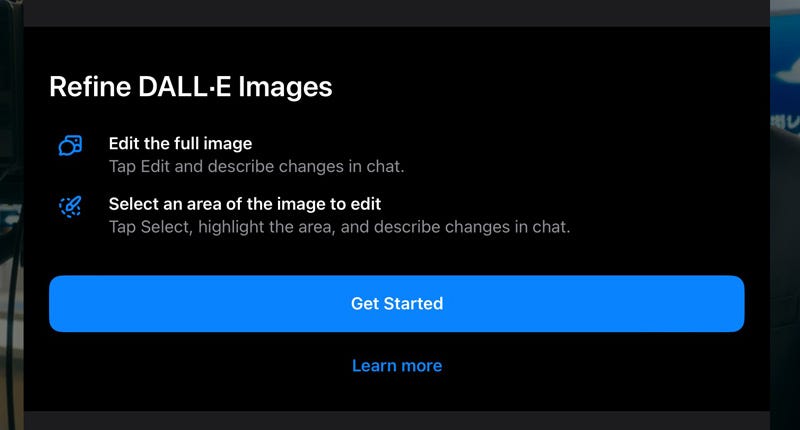

3. 画像は生成し直しから、編集可能に

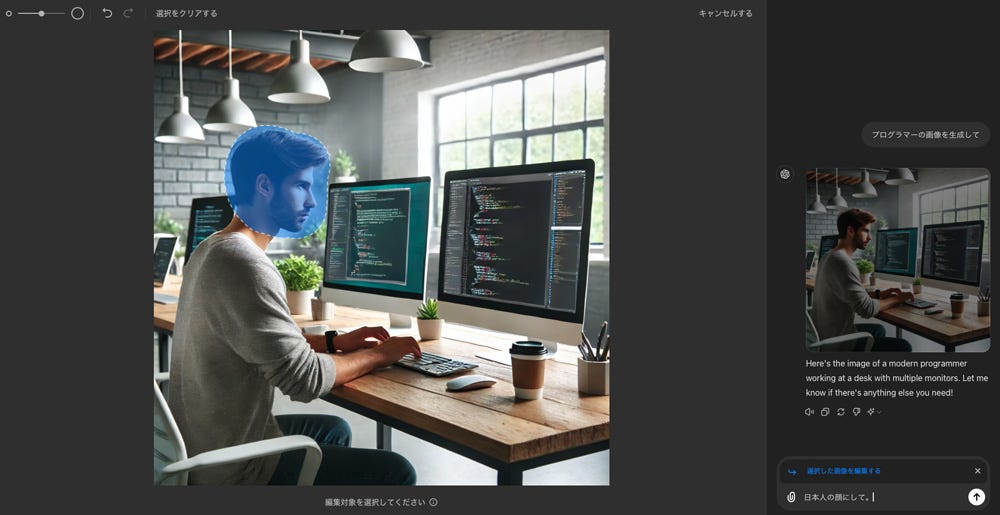

DALL・E3の機能によりさまざまな画像が生成できます。例えば、「プログラマーの画像を生成して」と言うと即座に画像を生成してくれます。ただしこれまでは、作成した画像を一部微調整したいと思っても、指示するプロンプトを色々書き換えて望む画像が得られるまでトライし続ける必要がありました。最新の機能では以下のように、画像の編集が可能になりました。

以下のように、変更したい箇所を塗りつぶして「日本人の顔にして。」指示を与えると、その部分だけ修正してもらうことができます。

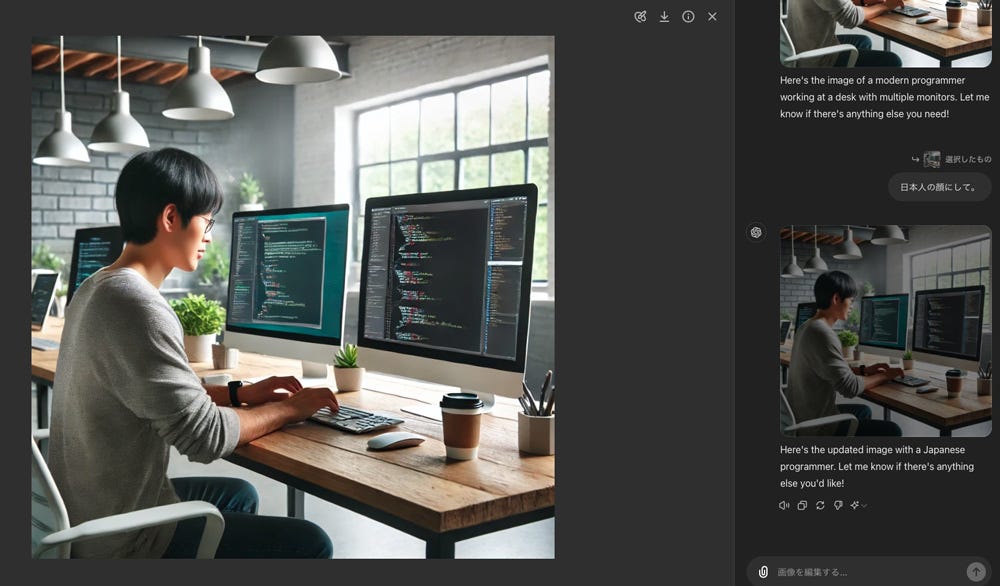

得られた結果は以下の通りです。

* * *

GPT-4oの登場により、生成AIのLLM単独の性能がこれまで以上に向上しています。GoogleのGeminiやAnthropicのClaudeなどと共に、性能向上の動きが今後も続いていくでしょう。

加えて、テキストだけでなく、音声や画像を組み合わせたマルチモーダルな利用方法が一層進んでいくことが考えられます。タイムラグは短くなり、感情表現が豊かになって、人間とのやりとりにより近づいていくことが予想されます。

最初にお伝えした通り、GPT-4oは、なんと無課金ユーザーでも利用可能になりました。ぜひ、読者のみなさんも使ってみてください。