Appleは現地時間6月10日、“パワフルな生成モデルをもたらす”パーソナル人工知能「Apple Intelligence」を発表。iOS 18、iPadOS 18、macOS Sequoiaの一部として無料で提供し、2024年秋にベータ版が米国英語で利用できるようになる。

Apple Intelligenceが利用できるデバイスは、iPhone 15 ProとiPhone 15 Pro Max、Apple SiliconシリーズのM1以降を搭載したiPadとMac。利用する場合、Siriとデバイスの言語は米国英語に設定される。一部の機能とソフトウェア プラットフォームは2025年中に提供予定。発表時点で、日本語を含む他の言語対応については触れていないが、追加言語も2025年中に提供するとしている。

Apple Intelligenceでは、文章を書いたり、メールを読んで返信したり、通知の内容を把握して優先づけしたり、画像生成機能を使って他のユーザーとのやりとりを楽しんだり、写真を探したり……といった、ユーザーのやりたいさまざまなことを、新しいAI機能を用いて支援する。他の生成AIのように、文章をキーボード入力するチャット型とは趣が異なる。

大きな特徴として、まったく新しいUIになり、“一段と深くなった言語理解機能”を備えたパーソナルアシスタント「Siri」を搭載。デザインを一新し、Siriがアクティブなときは画面の端(周囲全体)を囲むように淡い光が輝いて、ユーザーからの指示をうながす。

ユーザーの行動や意図を汲み取って動作し、日常のタスクを簡素化し高速化できるようになったのも進化ポイント。たとえば、ユーザーが言葉に詰まってもSiriは理解し、ひとつのリクエストから次のリクエストまで文脈を維持。テキストと音声を切り替え、Siriに直接話しかけられるときも、声が出せないときも、シチュエーションに応じたやり方でSiriとコミュニケーションできるようになった。

複数のアプリや機能をまたぎ、各アプリの画面を開かずに動作することも可能。WWDC24の基調講演では一例として、家族が乗った飛行機のフライト情報通知や迎えに行く場所までの経路設計、カレンダー登録などを、各アプリを開かず音声のみですべて完結させるデモを見せた。

Appleのプラットフォーム全体に、OpenAIが提供するChatGPT(GPT-4o)を統合。ユーザーがツール間を移動することなく、ChatGPTがもつ専門知識や画像およびドキュメントの理解機能にアクセスできるという。生成した画像やテキストは各OSのアプリ内に取り込んで利用できる。

Siriは、役に立つ場合には ChatGPTの専門知識を活用できる。ユーザーがChatGPTに質問やドキュメント、写真を送信する前にユーザーにたずね、Siriが直接回答を提示する。ChatGPTへのアクセスは無料で、アカウントは必要ない。ChatGPTの有料登録者であれば、有料ユーザー向けの機能も利用できるとのこと。

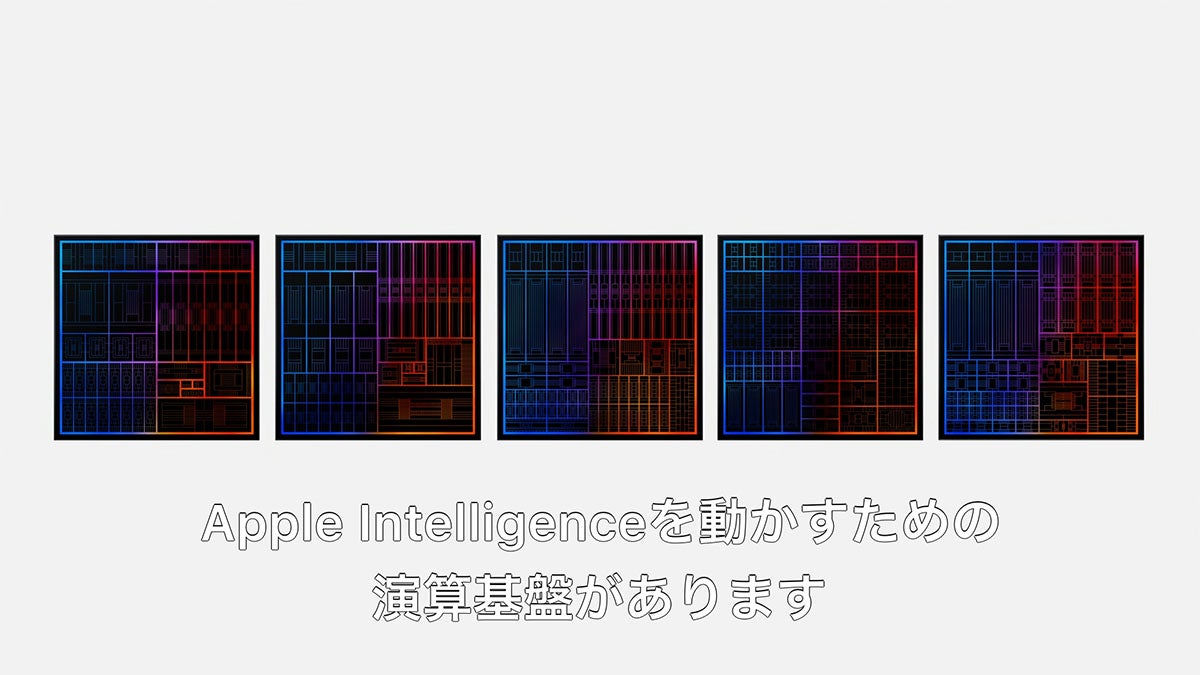

A17 PROやM1〜M4までのAppleシリコンシリーズに搭載した演算基板で動作しながら、手元のデバイス内(ローカル)で作業できることはローカルで、より大きな演算能力を必要とするときはクラウドサーバを活用するといった仕組みを装備。アップル独自のプライバシー機能とセキュリティ機能を、人工知能にも活用し、ユーザーのプライバシー保護機能を組み込んだという強みも強調している

Appleでは、「Apple Intelligenceが本当に役立つためには、ユーザーのプライバシーを保護しながら、個人の詳細なコンテキストを理解することが必要」とアピール。

Apple Intelligenceの基盤はデバイス上での処理であり、それを支えるモデルの多くはすべてデバイス上で実行。クラウドを利用するときも、Private Cloud ComputeがApple デバイスのプライバシーとセキュリティをクラウドに拡張し、さらに多くのインテリジェンスを実現するとしている。

ChatGPT にアクセスするユーザー向けにもプライバシー保護を組み込んでおり、IPアドレスは隠され、OpenAIはリクエストを保存しない。ChatGPT のデータ使用ポリシーは、アカウントを接続することを選択したユーザーに適用される。