アップルの開発者会議「WWDC」が今年も始まる。

2024年のテーマはなにか、と問われれば、それは間違いなく「生成AIを軸とした機能」になるだろう。ティム・クックCEOも「今年中にAI戦略を発表する」とコメントしており、タイミングとしてはこの時期以外考えづらい(まあ、そうでなかったら、アップルにとって非常に厳しい状況とも言えるのだが)。

巷で「アップルはAIで遅れている」と言われることが多い。確かに、AIを強くアピールすることはないし、ChatGPTやGeminiのようなチャットAIサービスも(まだ)提供していない。

だが、AIについてアップルがなにもしていない、というのは誤解だ。OSへの組み込みについても、プロセッサーについても、むしろ他社に先駆けている部分も多い。AIという名前でアピールすることは少ないが、アップルも色々やっているのだ。

それがどんなものなのか、WWDCに向けた「予習」として説明してみたい。

画像や音声ですぐ使えるAI機能

アップルのOSが持つAI機能として、多くの方にすぐに役立つものを2つご紹介したい。iPhone・iPad・Macとどのプラットフォームでも使える。

ひとつは「画像からのテキスト認識」。

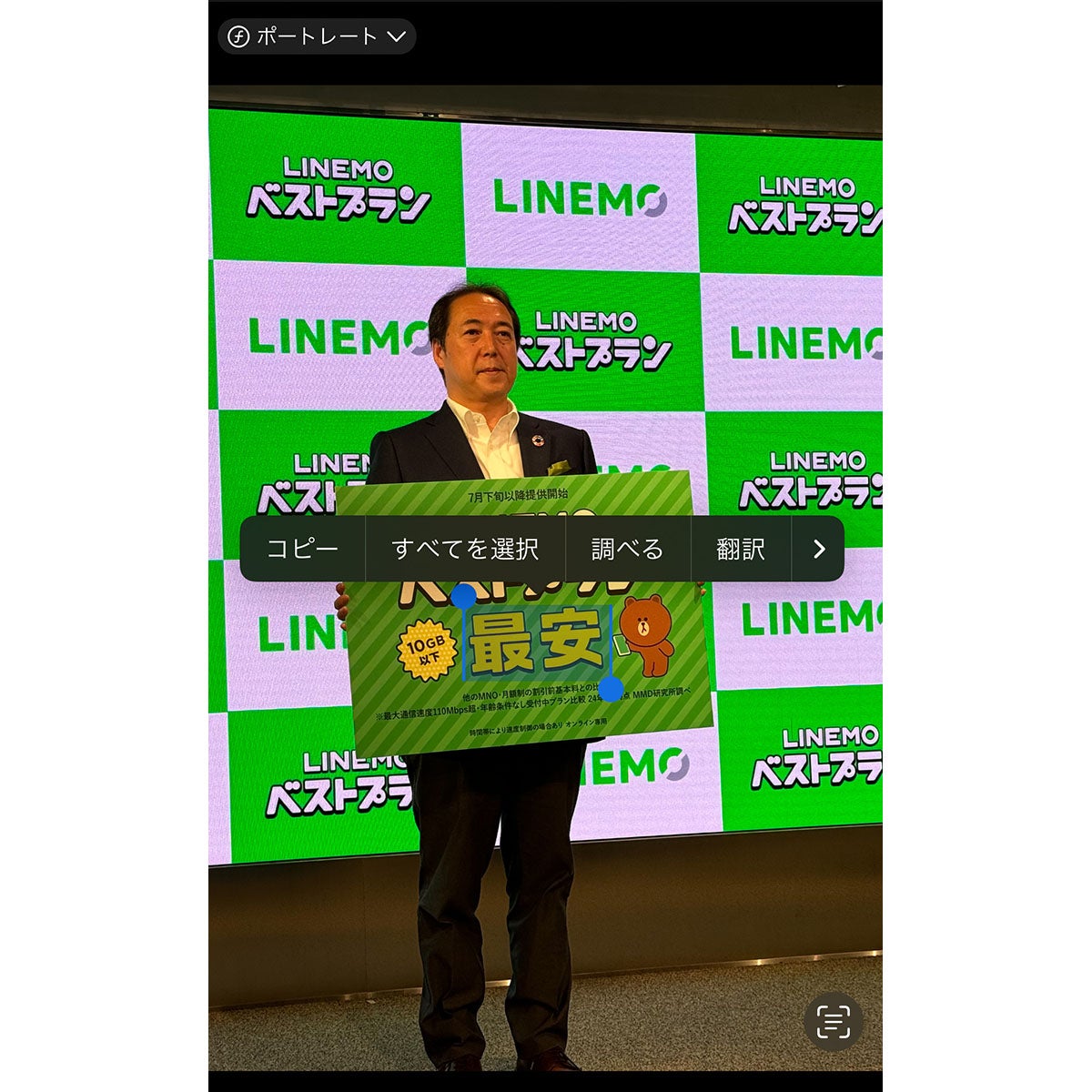

「写真」アプリで文字が含まれた画像を表示してほしい。右下に「三」に似たマークが表示されるのにお気づきだろうか。

これが表示されている画像で、文字の部分を指でなぞって「選択」してみよう。すると、文字だけが選択される。あくまで画像なので、本来はその中の文字だけが選択される、ということはないはず。しかし、AIが背後で動き、画像の中の文字部分を自動認識しているので、ウェブなどと同じように文字部分だけを選択し、「文字情報として」コピーしたり、翻訳したりできるようになっているわけだ。

次は「マイクモード」。

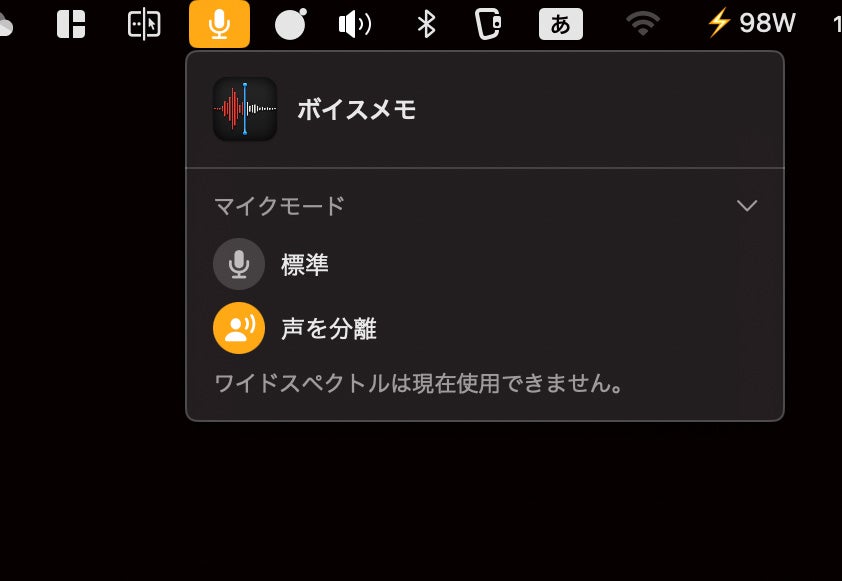

電話する時やMacでビデオ会議をするとき、周囲の騒音が気になる時はあるだろう。ここで使うのが「マイクモード」にある「声を分離」という設定だ。

たとえばMacの場合、マイクを使うとメニューバーに黄色いマイクのマークが出る。ここで「標準」にしておくとマイクからの音はそのまま相手に伝わるが、「声を分離」にすると、周囲のノイズが消え、声だけが相手に聞こえるようになる。たとえばビデオ会議で、キーボードのタイプ音が気になることもあるだろう。しかし「声を分離」にしておくと、タイプ音はきれいに聞こえなくなる。あくまでOSがやっているものなので、アプリの種類は問わない。ビデオ会議・ビデオ通話はもちろん、ボイスメモで音声を録音する時や、ゲームでボイスチャットをする時だって有効になる。

これらはどれも、iOSやmacOSに内蔵されているAIが、画像や音声を裏で自動的に処理してくれているからできることだ。

アクセシビリティでAIを活用

他にも、あまり知られていないAI関連機能はいくつもあるのだが、いわゆるアクセシビリティに関する機能は、AIをうまく活用しているものが多い。

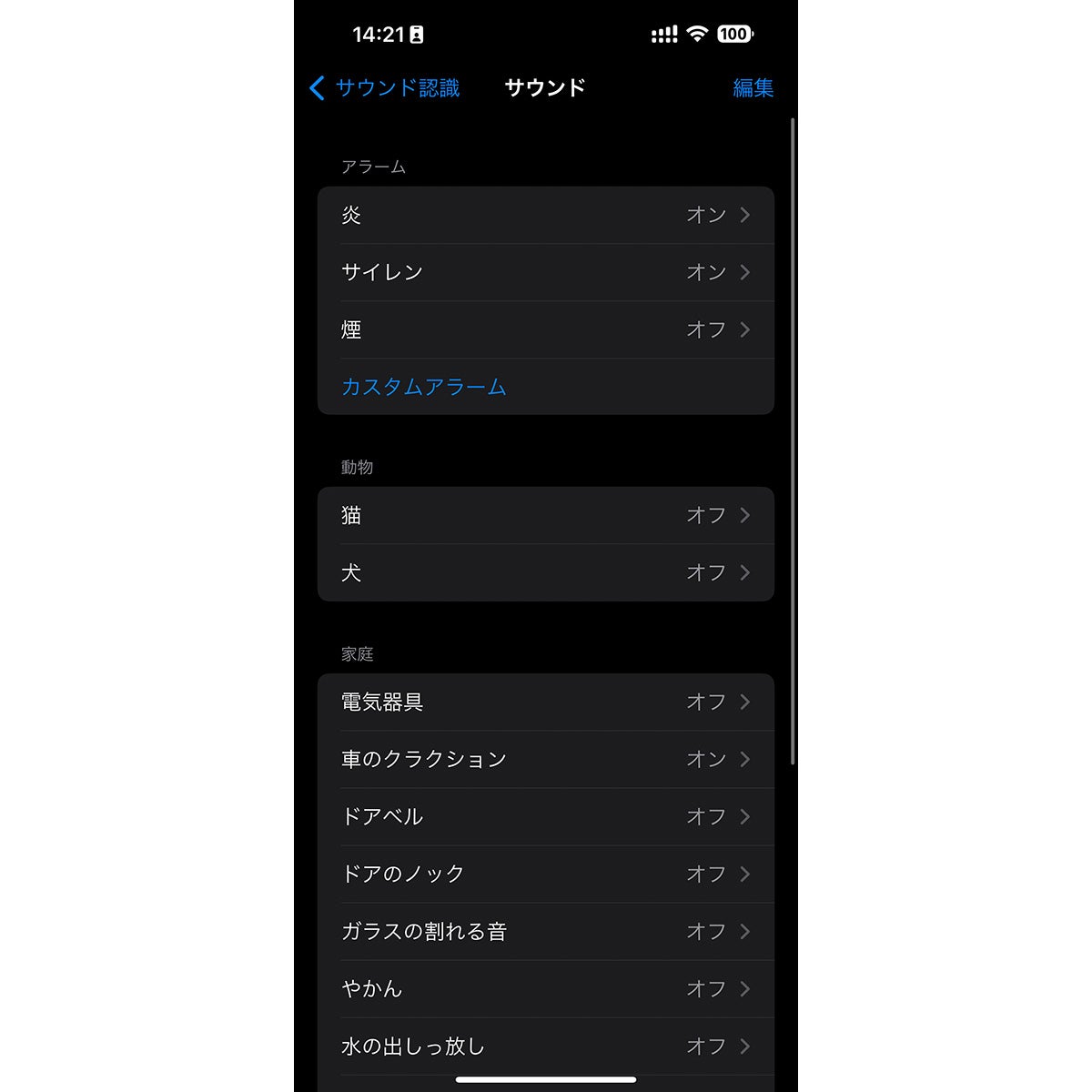

たとえば「サウンド認識」。これはiPhoneやiPadに搭載されているものなのだが、周囲でサイレンや車のクラクション、ガラスが割れる音やドアベルなどが聞こえた際、それを機器の通知(振動や音、画面表示)で伝えてくれる。聴覚にハンディがある人が、iPhoneを一種のセンサーとして使い、周囲の状況を把握しやすくするための機能である。

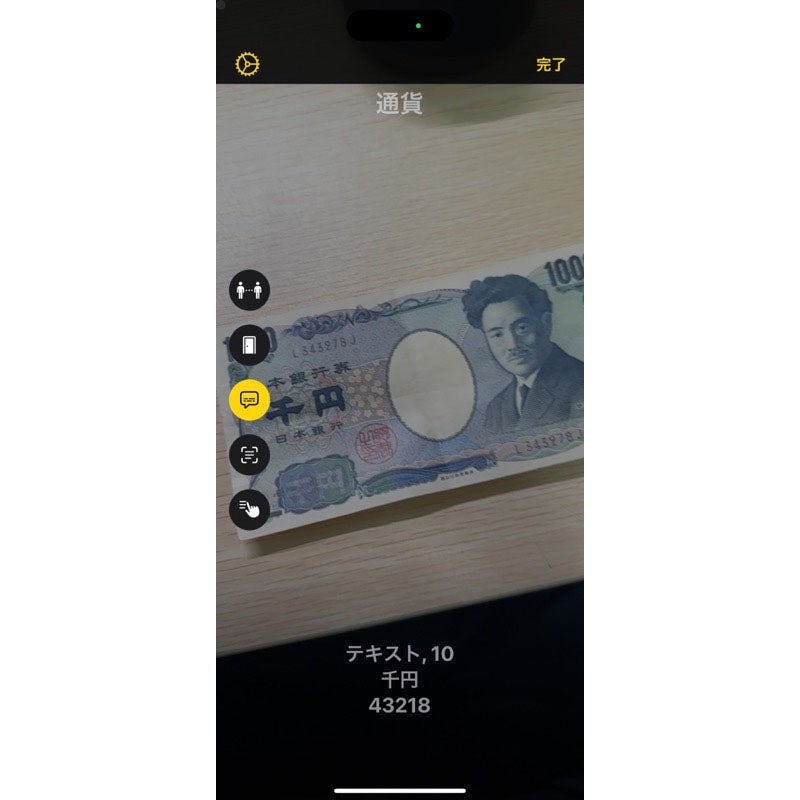

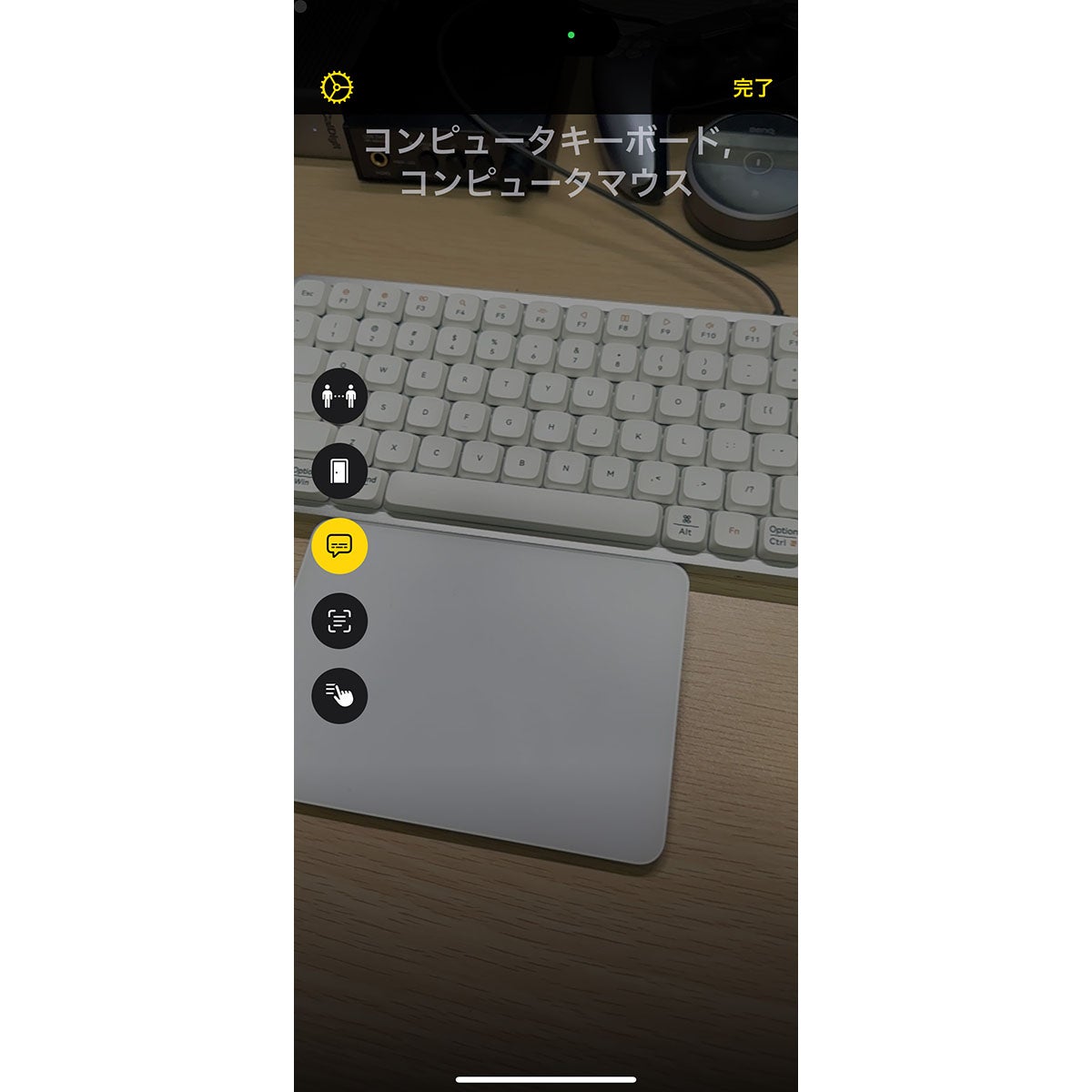

なにかを拡大して見るアプリである「拡大鏡」にも面白い機能がある。それが「検出モード」だ。

検出モードをオンにすると、カメラの前にあるものがなにかをテキストで解説する。たとえば千円札を移せば「紙幣」で「千円」という文字がある、と表示されるし、キーボードに向けると「キーボードがある」と示してくれる。これを音声読み上げモードと組み合わせると、視覚にハンディがある人は、目の前のものがなにかを把握しやすくなるわけだ。

アップルAIの特徴は「使いやすさ」

これらの機能は「アップル製品にしかないもの」というわけではない。ただ、単純にUIがよくできていて、より利用しやすいのは事実だろう。

たとえば画像内の文字認識については、Androidなら「Googleレンズ」機能で、Windowsの場合、OS付属のキャプチャツール「Snipping Tool」に似た機能がある。

しかし、それらは「画像の中の要素を認識する」という動作をしてから認識が行われる形の機能だ。アップルの場合、「画像内の文字がテキストのように扱える」という実装になっていて、より自然に使える。また、iPhoneからMacまで、幅広い製品で同じように使えるというのもありがたい。

ノイズ除去についても、ZoomやMicrosoft Teamsには同じような機能が付いている。ノイズ除去だけを行うアプリもある。しかし、OSに機能が標準で組み込まれていて、誰でもコスト追加なく、幅広いアプリから利用という意味では、アップルの機能は優れたものと言えるだろう。

アクセシビリティ系については機能が表からは見つけづらく、そこが課題だとは感じる。しかし、動作も素早く精度も良いので、OSの基本機能として備えておくべきもの、というのは間違いないだろう。

Vision Proで使える“分身”もAI活用

少し変わったAIという意味では、Apple Vision Proに搭載されている「Persona」が挙げられるだろう。

これは、自分の顔をVision Proでキャプチャし、立体のアバターを作ってビデオ会議などで使うものだ。Vision Proをかぶった状態でビデオ会議をする場合、自分の顔をビデオカメラで撮っても、Vision Proで顔が隠れてしまう。そのため、自分の「仮想の顔」を作って仮想カメラからの映像として使い、ビデオ会議に流すわけだ。

映像を見るとそこまでリアルなCGではないのだが、首の動きや視線、表情などを認識し、かなり正確に反映されていて、意外と違和感がない。このモデルは、Vision Proのカメラと距離センサーのデータをAIが処理して生成する。

この種のアプローチはMetaも研究開発しているものだが、本格的な実装はアップルが先行した形である。

NPUでは先行するアップルだが……

Vision Proの例はクラウドを使っているが、その他のAI機能については、アップルが自社製品に採用しているSoC内の「AI用コア」、いわゆるNPUで処理されている。アップルはこのコアに「Neural Engine」(ニューラルエンジン)というブランド名をつけて展開している。

Neural Engineは2017年秋発売の「iPhone X」で採用されたSoCである「A11 Bionic」で初めて採用された。

指紋認証であるTouch IDに変わって登場した顔認証機能「Face ID」の処理などから活用が始まったが、当時は0.6TOPS(Tera-Operation Per Seconds)くらいしか性能がなく、本当にFace ID関連にしか使われていなかったようだ。

しかし、2023年発売の「iPhone 15 Pro」に使われているNeural Engineは35TOPSまで性能が上がった。先日発売されたばかりの「iPad Pro」に採用された「M4」は38TOPSまで性能アップしている。

A17 ProやM4のNeural Engineは、示されたスペックだけで比較すると、先日マイクロソフトなどが発表した「Copilot+ PC」での「40TOPS以上」という条件に近く、NPU搭載という意味では先行していた……ともいえる。

一方で、Neural Engineが全力で活用されているか、というとその点は若干あやしい。たとえば、Mac向けの「M3」は18TOPSとされており、iPhoneより下になっている。これはおそらくGPUを重視したためであろう。

逆に言えば、本気でSoC内でAI処理を増やしていくのはこれから、という予想も成り立つ。すなわち、最新のデバイスはこれから発表されるOSで大きく機能が変わる可能性も高いのだ。

大規模なAI学習という意味では、Windows PCにNVIDIAの高性能GPUを搭載した方が有利であることは間違いない。

ただ、アップルはOSに「Core ML」というフレームワークを持ち、AI関連アプリの開発がしやすくなっている。また特に「MacBook Pro」や「Mac Pro」に使われるプロセッサーは、GPUから64GB以上の大容量メモリーにアクセスしやすいという構造もあって、オンデバイスAI開発はしやすい。

こうした「AIを使う」部分が、今年のWWDCでどう変わってくるのか。そこが、Googleやマイクロソフトとの競合を考える上で重要になってくるだろう。