日本科学未来館、KDDI、KDDI総合研究所は、未来館の展示に対してxR技術を使ってデジタルコンテンツを重ね合わせるデジタル展示「HYPER LANDSCAPE」を開発し、3月11日から実証実験を行っています。来場者がARグラス「NrealLight」を装着すると、「バーチャルヒューマン coh(コウ)」が現れて展示の案内をしてくれ、未来館のシンボルでもある「ジオ・コスモス」に重ね合わせたコンテンツを鑑賞できます。実験は11日から14日までの4日間、15~17時の間に行われます。

「HYPER LANDSCAPE」は、未来館が従来から模索してきた「展示の多層化」を目的とした取り組みです。今回は、展示に情報やコンテンツを重ね合わせることで鑑賞体験がどのように変化するか、という点を検証することが目的のひとつだと、日本科学未来館の展示企画開発課課長の瀬口槙人氏は話します。

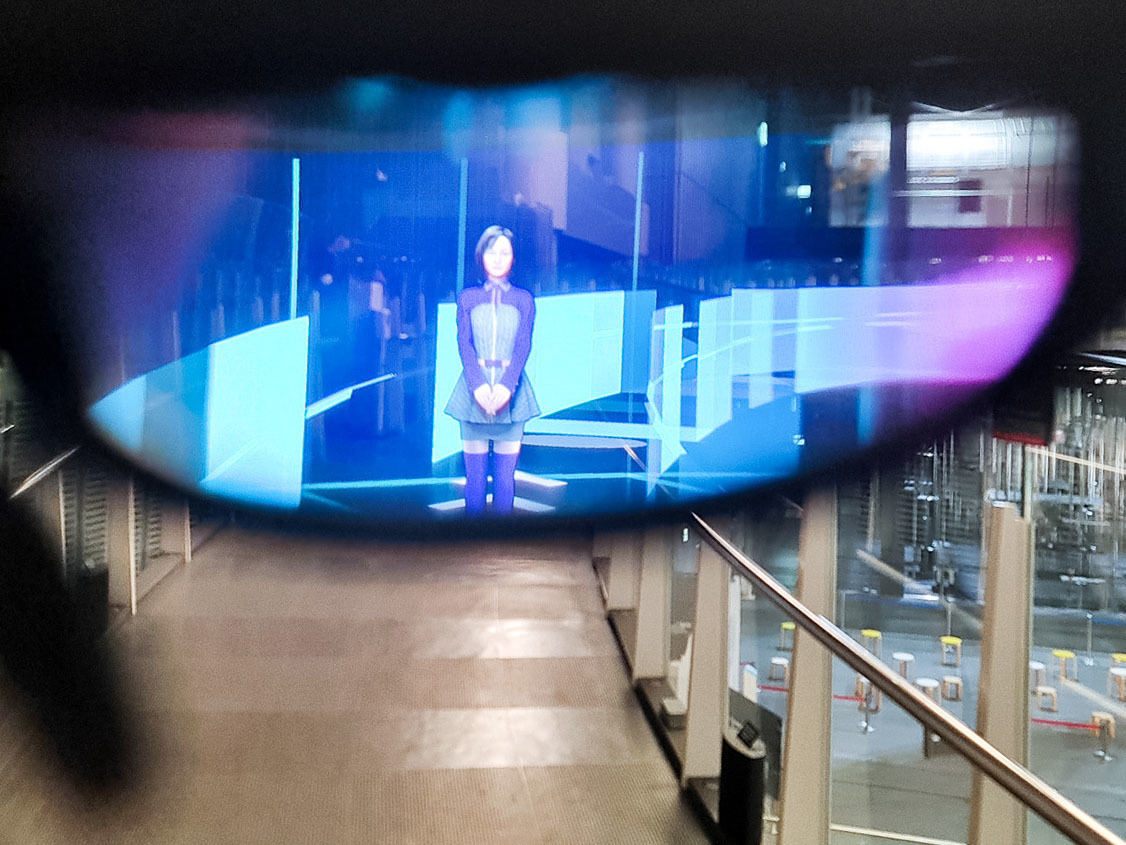

その実現のために、KDDIが5GとARで協力。ARグラスとしてNrealLightを貸し出し、参加者がNrealLightを装着してジオ・コスモスに近づくと、展示を案内するキャラクターとして全身フルCGのバーチャルヒューマン「coh」が現れ、展示の説明をします。ジオ・コスモスを取り囲む回廊「オーバルブリッジ」上にもコンテンツを重ねて合わせ、ルートを案内しつつ、ジオ・コスモスに重なる複数のコンテンツを鑑賞できます。

ここでのポイントが、cohのCGレンダリングはクラウド側で行い、ストリーミングでARグラスにリアルタイムに転送しているという点です。フルCGのレンダリングはマシンパワーが必要ですが、これをクラウドコンピュータ側で行う仕組みとしています。これによって、フルCGでリアルに動作するバーチャルヒューマンがスマートフォンにも配信できるようになりました。

「従来は、モバイルへの配信だとCGは簡素になりがちだった」とKDDIのパーソナル事業本部サービス統括部5G・xRサービス企画開発部サービス・プロダクト企画Gグループリーダーの水田修氏は説明します。それに対して、クラウド側で処理を行うことで、スマートフォンやARグラス上でもリアルな全身フルCGを実現したとしています。

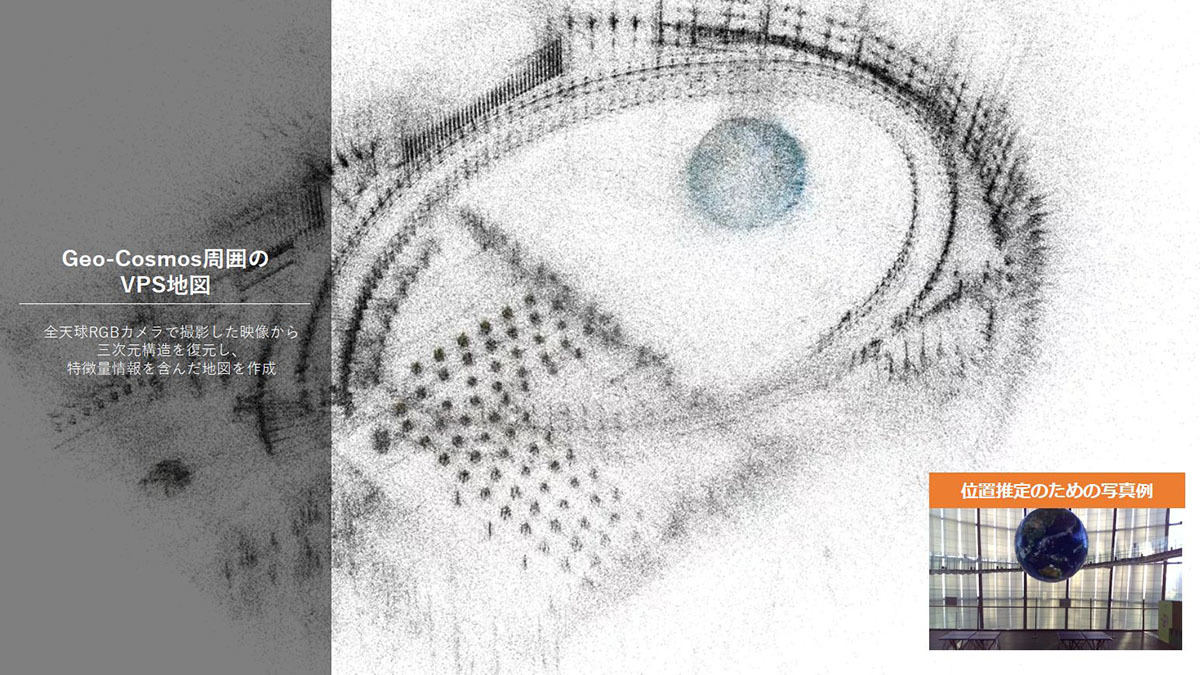

さらに、展示のために屋内VPS(Visual Positioning Service)技術を活用します。これは、現実世界の3Dマップを作成し、ARグラスの前面カメラから得られる画像情報を照合して、ARグラスの位置や向いている方向を正確に割り出す技術です。ARグラスからは常時画像がアップロードされており、それを3Dマップと照合して、鑑賞者がどこにいて、どの方向を見ているかが分かります。

-

未来館のジオ・コスモス周辺のVPS地図。「THETAやInsta360のような市販の360度カメラで撮影した」(KDDI総合研究所メディアITC部門メディア認識グループグループリーダー・小森田賢史氏)そうです

リアルタイムで位置と方向が分かるので、その先にある展示物(今回はジオ・コスモス)にデジタルコンテンツを重ね合わせて、新たな情報・コンテンツを提示できるようになっています。この技術はKDDI総合研究所が提供しました。

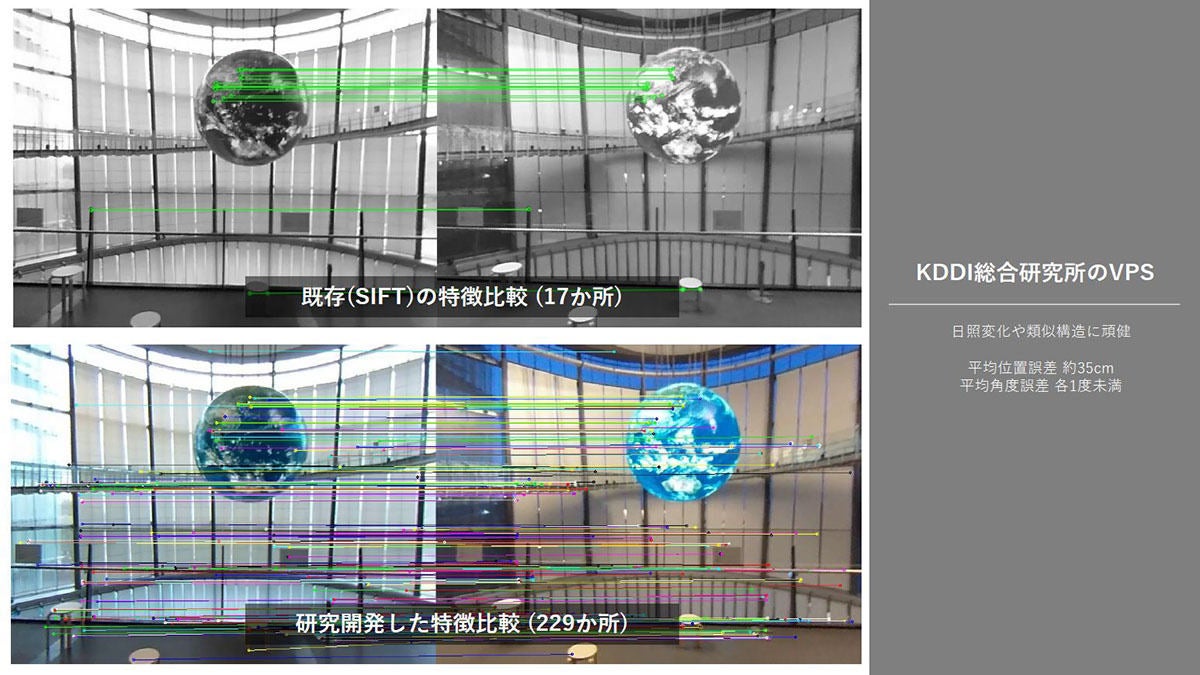

市販の360度カメラを使ってジオ・コスモス周辺を撮影した複数の画像の視差を活用して三次元構造を復元した30×50mという大きな空間のVPS地図を作成。通常のVPSでは、照合のための特徴比較が17カ所であるところ、KDDI総合研究所は229カ所という多くの特徴比較を行うそうです。これは、ジオ・コスモス周辺の環境がVPSにとってチャレンジングであるから、といいます。

ジオ・コスモスは、周囲を窓ガラスに囲まれており、外光が差し込むため、一日の間で光の状態が大きく変わり、それに伴い露出も変化します。回廊のオーバルブリッジは、ガラスの壁面が透過して向こう側の窓ガラスも透過していて、回廊を移動しても変化が少ない外観になっています。

こうした難しい状況で、リアルタイムに照合して正確に位置・方向を認識するために、多くの特徴点で比較をします。その結果、日照や光の変化、類似の構造でも正確な照合が可能になり、平均の位置誤差は約35cm、平均角度誤差は1度未満に抑えたそうです。

これに加えて、リアルタイムにコンテンツやcohを配信するために重要なのが「低遅延」です。鑑賞者が向きを変えたら、すぐにコンテンツも反映されなければなりません。そこで5Gの特徴である低遅延が威力を発揮します。そのため、MEC(マルチアクセスエッジコンピューティング)も導入。コンテンツを基地局の近くに配置して配信するMECを活用し、5Gらしい低遅延によってリアルタイムに「展示の多層化」を実現します。

動画で実際の表示を撮影

HYPER LANDSCAPEは、KDDIとKDDI総合研究所、日本科学未来館の3者による共同研究の成果だといいます。未来館の展示空間を拡張し、リアルに存在するジオ・コスモスの表現力を拡張することを目指します。

こちらはオフィシャル動画。ジオ・コスモスに人工衛星の軌道が重ねられています

もともと、未来館では多言語化が課題となっており、さらに障害のある人々を含むすべての人に開かれた場所になっていない、という問題意識があったといいます。こうした課題の解決にも、情報の多層化が貢献すると考えているそうです。この10年、こうした取り組みを全館的に広げていきたい考えを持っていたそうですが、技術的な課題があって取り組みが遅れていたところに、5GやARを活用することで多層化の実装が可能になった、としています。

今回の実証実験の期間は3月11日から14日ときわめて短い期間ですが、3者の提携は今後も継続し、新たなコンテンツの提供の可能性もあるそうです。