南フロリダ大学(USF)のUSF Health Voice Centerでは、耳鼻咽喉科医師でもあるYael Bensoussan博士が、AIを活用して患者の声から疾患を特定するという取り組みを行なっている。では、この取り組みとはどのようなものだろうか。今回は、そんな話題について紹介したいと思う。

患者の声をAIで解析し疾患を特定

人が話す声には、声帯振動と呼吸パターンを含むあらゆる音声特徴があるという。Bensoussan博士は、この音声特徴が健康状態を反映するさまざまな情報を含むと考え、神経障害、音声障害、気分障害、呼吸器障害、発達障害などにおける疾患の診断の可能性を、AIを使って模索している。

例えば簡単な事例を紹介すると、低くゆっくりと話す人はパーキンソン病の可能性が、ろれつが回らないときは脳卒中の可能性がある、などだ。そしてAIの活用によって、このような疾患の特定精度を向上することができるのだ。

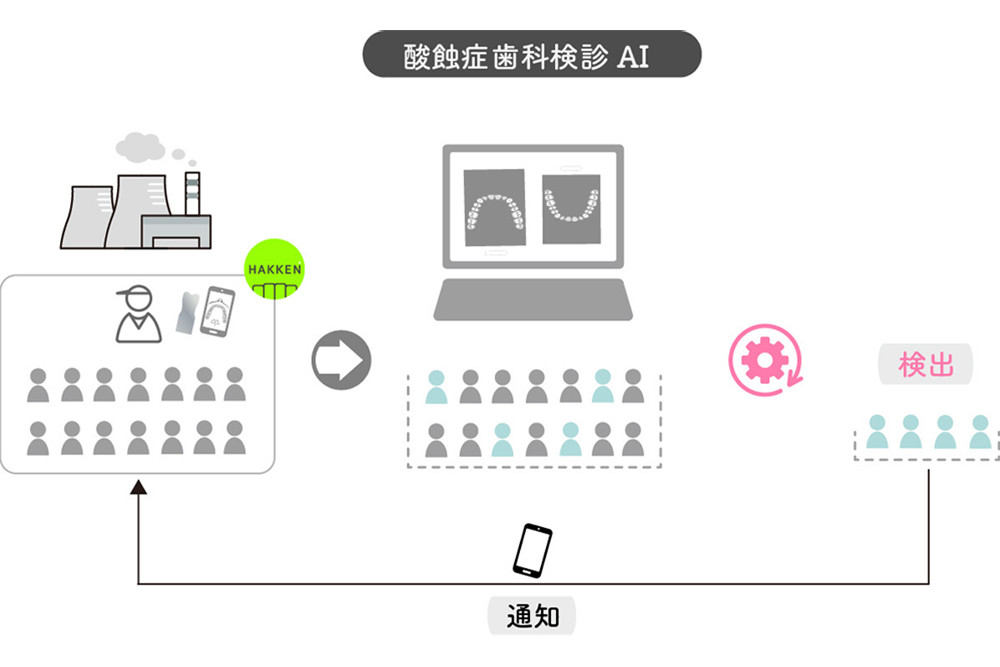

Bensoussan博士が目指すのは、医師がどこにいても、患者がどこにいても使用できるアプリを開発すること。患者は自分の電話で話すか、別のデバイスを使用して声を録音し、アプリ上でデータベースと照らし合わせて音声を診断するという構想だ。

音声データベースは、この取り組みを進めるために重要となる。このデータベースには2万から3万人の患者の声が収集され、がん、呼吸器系の問題、小児の発話遅延、自閉症、うつ病、双極性障害などの患者が含まれるという。患者の音声データベースの構築を進めるために、米国国立衛生研究所(NIH)から数百万ドルの研究費も出ているという。

またこの取り組みには、USF Health Voice Centerに加えてコーネル大学などの10以上の大学や研究機関が参加し、プロジェクトを推進しているという。

特に医療AIについて技術開発の面で特段目新しいものはないというが、このデータベースの構築を大きく進めるために、情報をオープンデータ化して多種多様なデータが収集できるようにしているという。

USF Health Voice Centerで行われた、AIの音声解析を利用した診察の様子(出典:USF Health Voice Center)

いかがだったろうか。現在、医療とAIは大きな結びつきを見せている。否定的な意見もあると思うが、将来的には融合することだろう。もちろん、AIは統計的なデータに基づく診断になるため、診断による疾患的中率は100%とはならないにしても、患者の病気予防や疾患の早期発見などには有効な診断になると感じる。それは、多忙な医師の負荷軽減にも寄与するだろう。そして、医師による触診や目視検査などの的確な診断も加われば、疾患というものは完全に予防し、予測できるほどの進化を遂げるかもしれない。