2023年12月1日、「2023ユーキャン新語・流行語大賞」の表彰式が行われ、阪神タイガースの岡田監督の「アレ(A.R.E)」が大賞に輝いた。そのほかにも「ペッパーミル・パフォーマンス」や「蛙化現象」など、2023年に日本を沸かせた言葉がラインクインする中、「生成AI」という言葉も上位10位に入選した。2023年は、企業にとって生成AIと向き合う1年になったことだろう。

これだけ生成AIが世に浸透してきた現在、次に考えるべきなのは「生成AIがもたらすリスク」ではないだろうか。Akamaiが、同社のトレンド予測内で「ランサムウェア攻撃において、攻撃者はFraudGPTやWormGPTなどのプログラムを通じて生成AIを攻撃に悪用している」と記載している通り、生成AIを悪用したサーバ攻撃が増加している。

このような外部からのリスクに加えて、AIにおける「ハルシネーション」の存在も危険視されている。ハルシネーションとは、AIが事実に基づかない「もっともらしい嘘」を生成してしまう現象のことで、AIの回答を鵜吞みにしてしまうと事実とは大きく異なった認識をしてしまうことも起こりうる。

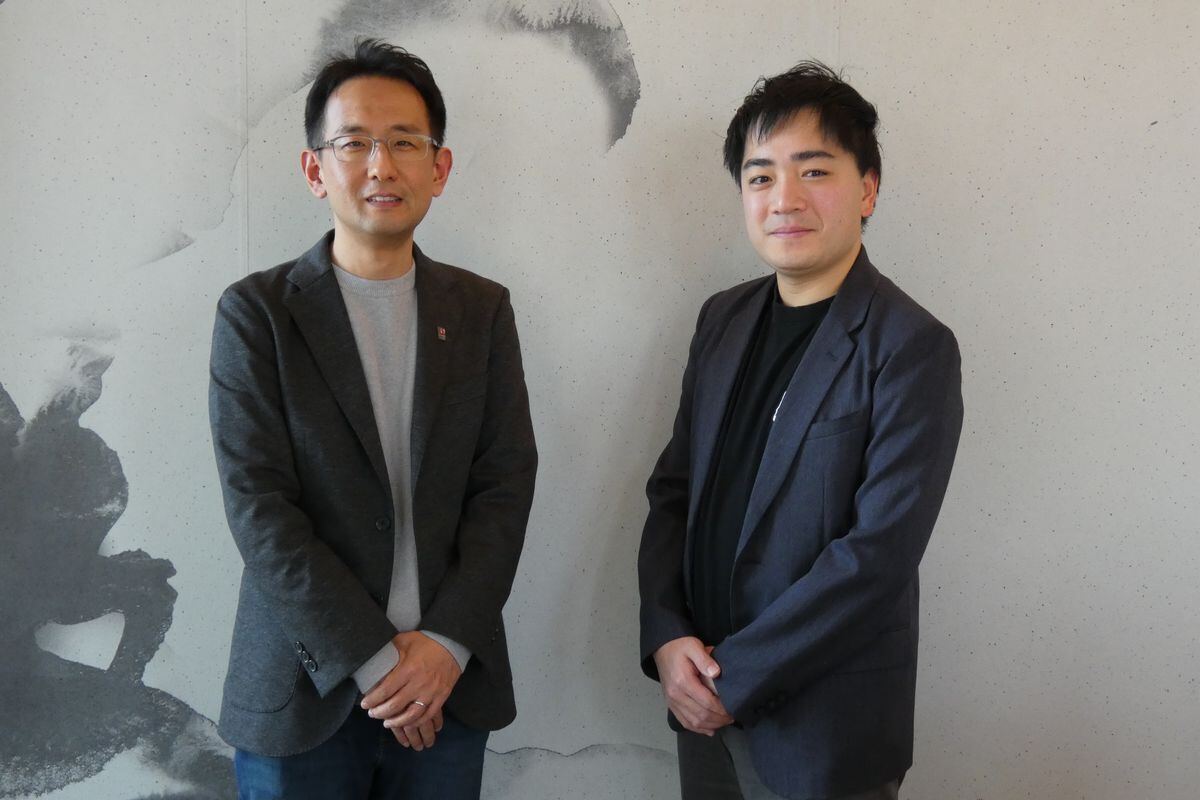

今回は、AIのリスク対策に知見を持つ、損保ジャパン DX推進部 開発推進グループリーダーの石川隼輔氏とロバストインテリジェンス 日本技術責任者の松本崇宏氏に「AIリスク」について話を聞いた。

損保ジャパンとロバストインテリジェンスの共同プロジェクト

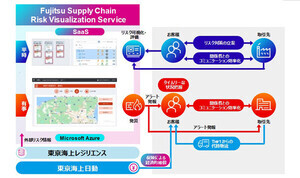

今回、話を聞いた損保ジャパンとロバストインテリジェンスは、2023年8月から生成AIを活用した業務システムのリスク評価テストを開始している。SOMPOホールディングスとロバストインテリジェンスがAIの信頼性確保に向けたガイドラインの策定とリスク管理体制の構築のために業務提携を行い、実際のAIリスク評価の対象として、中核会社である損保ジャパンの開発中のシステムが選定された形だ。

この業務提携の背景について石川氏は以下のように語る。

「現代社会におけるAI技術の進歩は目覚ましく、生活者や企業活動における生産性の向上や意思決定スピードの強化など、さまざまな好影響をもたらしています。損保ジャパンでも、生成AIや音声認証、画像認識といった最先端のAI技術を活用して、さまざまな事業展開を進めています。一方で、AI活用に際しては品質や倫理、セキュリティといったさまざまな観点でのリスクが発生します。損保ジャパンにおいても自社のAIサービスの信頼性確保のため、AIリスクを適切に管理し、利用者に対する透明性を確保することが課題となってきました」(石川氏)

そして、このような課題を解決するために共に立ち上がったのが、2019年にハーバード大学の研究者たちによって創業されたシリコンバレー発のAIスタートアップであるロバストインテリジェンスだった。

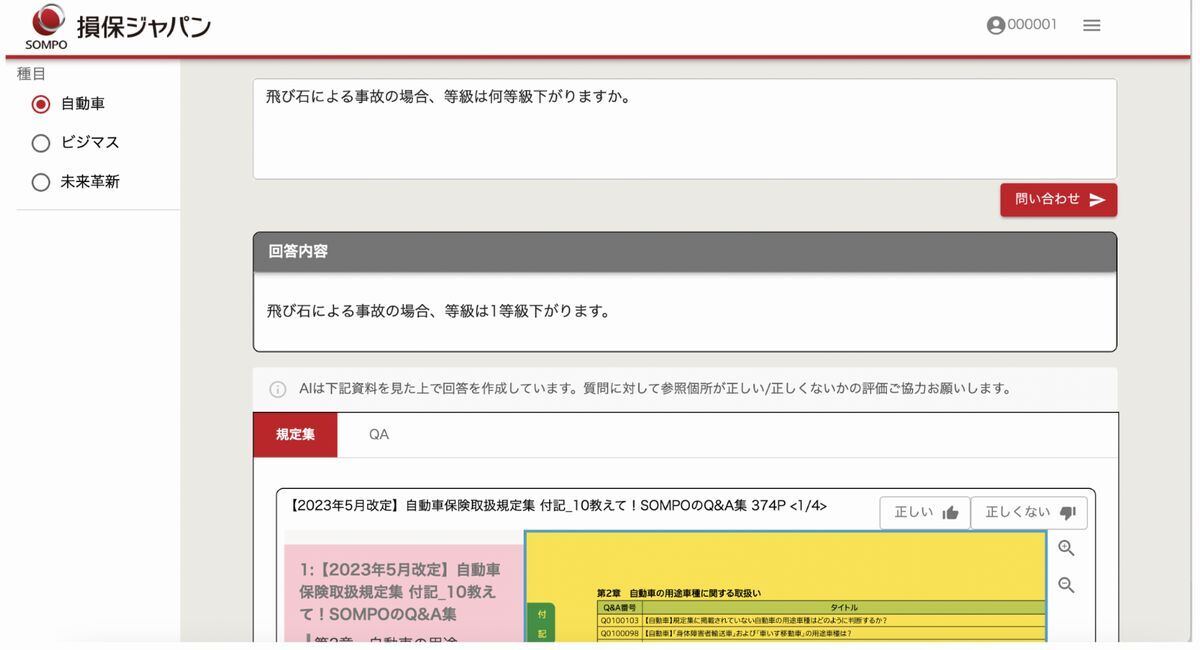

損保ジャパンは、大規模言語モデルを組み込んだ社内照会システムを開発するプロジェクトを進めており、このプロジェクトでは、システムのリスク検証・対策のため、同システムで採用している生成AIモデルに対して、ロバストインテリジェンスのプラットフォームを活用し、品質・倫理・セキュリティなど、さまざまな観点から設計された多数のテストによるリスク評価を行ってきたという。

「これらの取り組みに加えて、SOMPOグループ全体に適用可能なガイドライン策定を支援し、全社的なAIガバナンスの構築に向けた取り組みを後押しすることも実施しています」(松本氏)

AIが持つ3つのリスク

このように生成AIに知見を持つロバストインテリジェンスは、生成AIのリスクについてどのように考えているのだろうか。

「さまざまなお客さまとお話しする中で、やはりAIのリスク管理はまだまだ始まったばかりだなと思っています。損保ジャパンさんのように意識を高く持って取り組んでいる会社もある一方で、世の中の潮流という点で見ると、まず『AIリスクとはなんですか?』というような質問をされる企業も少なくありません」(松本氏)

特にChatGPTを含む生成AI系のリスクに関しては、世に出てからまだ日の浅いツールであるということもあり、企業としての経験もナレッジも少なく、企業側が苦戦している段階のようだ。その中で松本氏は、AIのリスクを大きく3つに分類して企業に伝えているという。

1つ目に松本氏が挙げたのが「品質面」でのリスクだ。多くの場合、AIは過去のデータを使って学習したモデルを用いて、入力からもっともらしい回答を出力するツールのため、開発時の段階と実際の使用時のギャップが生じることもよくあるという。特に生成AIにおいては、先に挙げたハルシネーションの存在が厄介で、自然と信じてしまいそうな内容の出力を行ってしまうことも少なくないため、品質面で損害が起きてしまうというリスクがあるようだ。

また2つ目に挙げられたのは「倫理面」のリスクだ。このリスクもAIが過去のデータを参照して学習していくという特性を持ったツールであることが関係しているそうで、 AIが学習したデータの中に、差別や偏見が含まれてしまっている場合、性別や人種などで異なった回答をするなど攻撃的な出力をしてしまうケースがあるというリスクが確認されている。

そして、最後に挙げたのが「セキュリティ」のリスクだ。外部に漏らしてはいけない個人情報や機密情報を学習したAIが、ユーザからの指示であるプロンプトへの回答としてその情報を吐き出してしまうというリスクが存在しているという。中には、読み取り用の画像に人間には分からないほどの微小な変化を施し、結果を誤らせるという攻撃手法も発見されているそうだ。

損保ジャパンの先進的な取り組み -「保険とAIリスク対策は似ている」

ここまでロバストインテリジェンスが考える生成AIのリスクを説明してきたが、そんなAIリスク管理のプロフェッショナルとも言えるロバストインテリジェンスから見て、共同でリスク評価を進める損保ジャパンは、「非常に高いAIリスクへの意識を持ち合わせた企業」だと松本氏は語る。

損保ジャパンが開発中の社内照会システムは、ただ質問に回答してくれるツールではなく、一旦質問に対して適切と推定された参考文献やさまざまなドキュメントを取得してから、根拠に基づいて回答をするというシステムになっているのだという。

先にもリスクとして挙げたが「AIは嘘をつく」という可能性があるため、文献に基づいて回答するシステムを構築しているのだというが、理論上では可能でも取り組んでいる企業はほとんどいないのが実情だ。松本氏によると、損保ジャパンは生成AIのリスク対策において高い技術と意識を持ち合わせた先進的な取り組みを行う企業だと説明していた。

このような先進的な取り組みが行える理由について、石川氏は以下のように語る。

「エンジニアが自社内に多数在籍していることが多いと思います。保険会社のイメージとは少し離れますが、損保ジャパンにはDX推進部というデジタル化に特化した部署が設置されています。部内にエンジニアをはじめとする専門家が多く在席しているため、迅速に先進的な取り組みを進めることが可能となっているのです」(石川氏)

DX推進部は、損保ジャパンのDX(デジタルトランスフォーメーション)を進めるために 2021年4月に設立された新設部署だ。社内各部署から集まったビジネスエキスパートと、主に外部から招集されたテクノロジーエキスパートがチームを組んでデジタル案件にあたっている。

DX推進部は「戦略グループ」「パーソナルライングループ」「コマーシャルライングループ」「開発推進グループ」という4つのグループで構成されており、戦略グループが全体戦略、パーソナルが個人向け案件、コマーシャルが企業向け案件をそれぞれ担当している。

石川氏も所属している開発推進グループは18人のエンジニアと1人のデザイナーで構成される専門家集団であり、各種デジタル案件の技術コンサルティング、エンジニアによる内製実装(プロトタイプから本番化まで)を担当しているという。

最後に石川氏に今後の展望を聞いた。

「残念ながらAIを活用する上で100%の精度を出すのは非常に難しいです。とはいえ、使うとリスクがあるからと言ってAIの活用をためらっていては今後の発展は考えられません。リスクををうまくコントロールし、利用に際して最大限リスクを回避するために準備しておく。これはわれわれ保険業界にも通じる考え方です。これから先、ルールが整備され、リスクがあることを受け入れてAIを活用できる世の中になってほしいと思います」(石川氏)