第370回で、ゲームバランスに影響する要素を人工知能(AI : Artificial Intelligence)に見つけ出させようとする、米国防高等研究計画局(DARPA)の「ゲームブレーカー」計画を紹介した。同じ「ウォーゲーム」がお題だが、今回は違う切り口から。

コンピュータは頭が悪い?

シミュレーション・ウォーゲームというジャンルは昔からある。当初はボードゲームでスタートしたが、後にコンピュータ上でゲームを行えるようになった。ボードゲームでは、プレーヤーが何人か集まらないと対戦できないが、コンピュータ・ウォーゲームならコンピュータが相手をしてくれる。

ところが、筆者が大学生の頃(つまり30年ぐらい前だ)のパソコン用ウォーゲームといったら、あまり「頭の良い」代物ではなかった。周波数10MHz(GHzではない!)の16ビットCPUで、使えるメモリが640KB(GBではない!)なんていう時代のことだから、使えるリソースが少なすぎたし、手の込んだロジックを組み込むわけにも行かなかったのだろう。

よって、何回も対戦していると、「ここではきっと、コンピュータが操る敵軍はこういう手を打ってくるな」という予測ができたし、往々にしてその通りになった。それで「コンピュータは頭が悪いなあ」などとボヤきつつも、またプレイしてしまうのであった。

その点、人間同士が通信対戦するほうが意外性がある。プレーヤーによっては、定石から外れた、意表を突いた作戦を仕掛けてきて相手を翻弄する、なんていうこともあるだろう。もちろん、この業界にも「定石」のようなものはあるが、実戦では常に「定石」通りに事が運ぶとは限らない。

さて。個人が遊びでプレイするものならともかく、本職の軍人が作戦計画を立てて、それを実際に検討するために行うウォーゲームではどうだろうか。図上演習では通常、関係者が敵味方に分かれて人間同士の対戦を行うが、同じような教育を受けた、同じ国の軍人同士では、思考が似てきてしまうかも知れない。といってまさか、仮想敵国の軍人を呼んできて相手をしてもらうわけにも行かない。

では、そこで過去のさまざまな実戦事例を大量に学習させることで、AIに相手をさせることができないだろうか。なんていうことを、ふと考えた。

過去の歴史をひもといてみれば、定石通りにやって勝ちを収めた事例も、定石を外すことで勝ちを収めた事例もある。いずれにしても反対に、負けた事例もある。具体的な名前は挙げないけれども、「意表を突いた作戦」で敵軍を翻弄した事例はあるし、敵軍の意表を突くのが得意だった指揮官もいる。

そういう、あまたの事例を大量にかき集めて学習させたらどうなるだろう。常に定石通りに動くのではなく、定石を外したり、お約束の勝ちパターン通りに動かなかったり、という話にならないだろうか?と考えたわけだ。

AIを応用する分野-電子戦の場合

話の流れから「作戦レベル」での相手役という応用を考えてみたが、もっと細かいレベルでも応用できる可能性がある。例えば、電子戦(EW : Electronic Warfare)。

電子戦とは煎じ詰めると、妨害すなわちECM(Electronic Countermeasures)と、耐妨害すなわちECCM(Electronic Counter Countermeasures)の仕掛け合いである。一方が、敵軍の状況認識を阻害しようとしてECMを仕掛けると、仕掛けられた側は妨害を排除しようとしてECCMを仕掛け返す。

どちらにしても、それなりの「定石」があるのは作戦レベルと同じだ。そして以前に書いたように、電子戦システムにAIを持ち込む動きはすでに出てきている。電子戦システムに学習させられるのであれば、電子戦訓練システムに対する学習もできないだろうか?

つまり、電子戦要員を養成する際の敵役としてAIが出てきて、妨害を仕掛けてきたり、妨害をかいくぐろうとして対策を講じてきたりする。それに対して訓練生が、また別の妨害を試みて制圧しようとする。AIが電子戦システムを管制できるのであれば、それを応用して敵役を務めることもできそうではある。

となると、ひょっとすると要撃管制の分野も可能性があるかも知れない。要撃管制官とは、レーダーサイトやAWACS(Airborne Warning And Control System:早期警戒管制機)機に乗り込んで、彼我の状況を見ながら味方機を誘導したり、指令を出したりする、難しい任務だ。そこで「敵機」の動きをAIにやってもらうわけだ。

AIを応用する分野-対潜戦の場合

もうひとつ考えたのは、対潜戦(ASW : Anti Submarine Warfare)。対潜戦の敵役たる潜水艦は、艦長・個人の性格や戦術的判断によって動く部分が大きいという。すると、艦長が通常以上にアグレッシブだったり、定石を外して意表を突いた手に出たりすれば、相手は翻弄される可能性がある(ときどき、アグレッシブに過ぎて、平時に自分のフネを相手のフネにぶつけてしまう艦長もいるが)。

そうした「個々の艦長の思考や戦術」に関する事例を集めて、学習させることはできないだろうか。ただしこれまでのところ、ASWの訓練でAIを活用するとの話は出てきていないようである。出てきていないということは、それだけ実現のためのハードルが高いということかもしれない。

もっとハードルが高そうなのは、特殊作戦や対反乱戦の分野。これは生身の人間を相手にする方が実戦的な訓練になるし、AIに相手をしてもらうのは無理がある。

米陸軍の特殊作戦部隊(いわゆるグリーンベレー)では、新人を対象とする訓練課程の最終仕上げとして、生身の人間を相手に一種のロールプレイを行う「ロビンセージ(Robin Sage)」という演習をやる。

そこでは、訓練生は実際に車両やヘリコプターで「敵地」に潜入して、現地の「ゲリラ勢力」と接触、味方につくように説得したり、訓練を施したりしつつ、不正規戦を展開していく。もちろん、相手は一筋縄ではいうことを聞いてくれないし、ときには理不尽な要求をぶつけてくることもある(それも訓練のうちだ)。

さらに、ロビンセージ演習を実施するノースカロライナ州の田舎では、地元住民までロールプレイに参加してくる。これもまた、可変要素を増やして不確実・不透明にするひとつの要素であり、より実戦的な訓練につながる。プロの軍人ではなくて部外者だからこそ、意外性を生む要素になりそうではある。

こんな訓練は、生身の人間が相手でなければ実現できそうにない。やはり、すでにコンピュータを相手に訓練している分野のほうが、AIに相手役を務めてもらうのに向いているだろう。

著者プロフィール

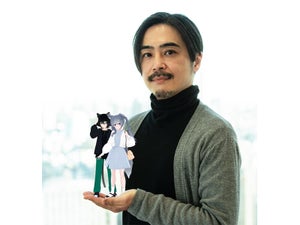

井上孝司

鉄道・航空といった各種交通機関や軍事分野で、技術分野を中心とする著述活動を展開中のテクニカルライター。

マイクロソフト株式会社を経て1999年春に独立。『戦うコンピュータ(V)3』(潮書房光人社)のように情報通信技術を切口にする展開に加えて、さまざまな分野の記事を手掛ける。マイナビニュースに加えて『軍事研究』『丸』『Jwings』『航空ファン』『世界の艦船』『新幹線EX』などにも寄稿している。