レッドハットは10月16日、都内で最新のソリューションやテクノロジートレンドをテーマに、同社のオープンソーステクノロジー戦略に関する記者説明会を開催した。説明会には米Red Hat シニアバイスプレジデント兼CTO(最高技術責任者)のChris Wright(クリス・ライト)氏が来日し、プレゼンテーションを行った。

オープンハイブリッドクラウドを進化させてきたRed Hat

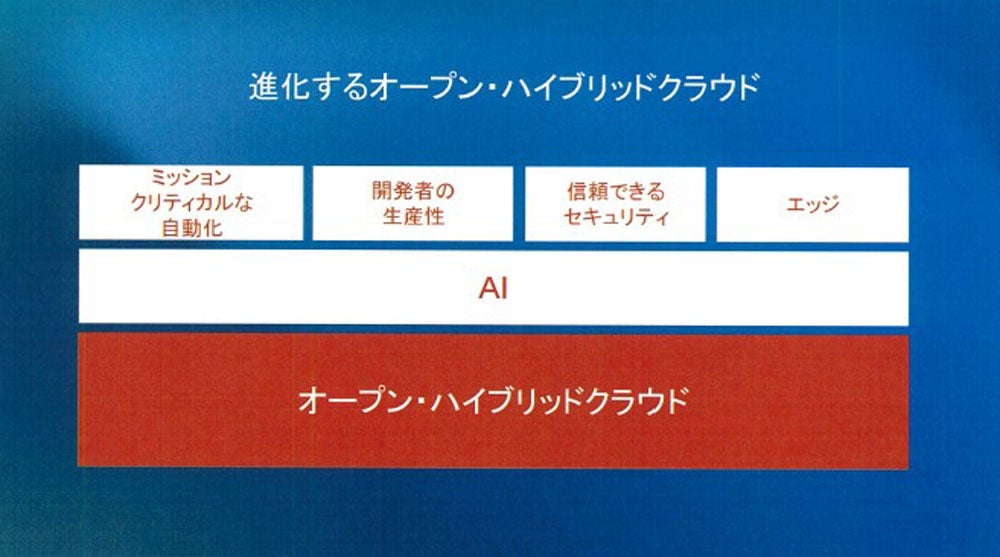

まず、ライト氏は「過去数年間、私たちはオープンハイブリッドクラウドを進化させてきた。Red Hatのすべての作業はオープンハイブリッドクラウドに焦点を当てており、昨年からAIをポートフォリオ全体の基本的なワークロードとして有効にするために取り組んでいる。当社は、AIをポートフォリオに組み込み、ユーザーがプラットフォームを使用する際の生産性を向上させるツールとして活用している。AIを自動化の一形態と考えるならば、IT自動化ツールの『Ansible』を提供し、自動化をビジネスのミッションクリティカルな要素として位置づけることに重点を置いている」と話す。

同氏によると、企業においては多くの部署が各タスクのために自動化を使用しているが、自動化を企業内のコスト削減の中心と考えるならば、すべての操作が自動化を中心に構築され、自動化が失敗したり、スケールできなかったりすると、ビジネスが中断されることになりかねないと指摘。

そのため、同社ではインフラストラクチャの観点からミッションクリティカルな機能を自動化プラットフォームに導入することに注力しているほか、開発者の生産性の向上にもフォーカスしている。しかし、これは生産性を向上させるために何でも好きなことをすることを意味するわけではなく、企業のポリシーに準じたガードレールが必要との見立てだ。

同氏は「これにより、政府からの外部規制や内部ポリシーに準拠することができる。オープンハイブリッドクラウドのインフラストラクチャの大部分は、プライベートデータセンターやパブリッククラウドにあると考えられるが、Red Hatとお客さまにとって、オープンハイブリッドクラウドはエッジまで拡張される。したがって、当社はエッジ機能への投資を続け、テレコム市場、小売市場、産業自動化および製造、自動車などの業界においてお客さまに提供できるものを進化させている」と述べている。

すべてがオープンハイブリッドクラウド戦略に関連しており、AIに関する新しいワークロード、ミッションクリティカルな自動化、開発者が迅速に生産性を向上させる能力、そしてエッジへの拡張にまで広げているという。

企業でのAI活用をバックアップ

ライト氏はAIについて「OpenAIがChatGPTを発表してから2年が経過したが、ゲームチェンジャーだった。ChatGPTの導入により、誰もが想像力をかき立てられた。AIは新しいものではなく、多くのハイプサイクルと冬の時代を経験したが、生成AIの動きは驚異的だ。私のキャリアの中で、これほどのスピードでの革新と変化を見たことはない。当社は、お客さまが何が現実で、何がビジネスにポジティブな影響を与えないかを探る際に支援できるようにしたいと考えている。AIを考えるとき、私たちはそれを複数のカテゴリーに分けて考えている」との認識だ。

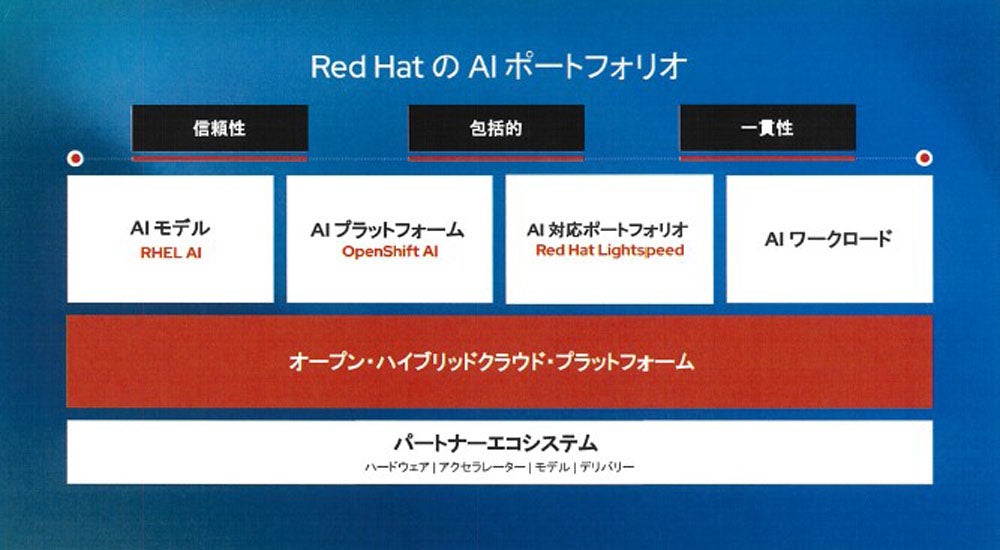

同氏が言及したカテゴリーの1つは、AIモデルが同社のプラットフォームにとって重要なワークロードであるということだ。今日の企業はアプリケーションとビジネスロジックがビジネスを支えているというものだが、将来の企業はアプリケーションとビジネスロジックに、機械学習モデルが組み合わさったものになると予測している。

そして、これらのモデルはアプリケーションがビジネスの各側面に合わせてカスタマイズされるのと同じく、ビジネス内の各ユースケースに合わせてカスタマイズされる必要があるという。つまり、ビジネス全体を運営する1つの大きなモデルではなく、特定のタスクにカスタマイズされた多数の小さなモデルが存在するということだ。

同氏は「当社のプラットフォームがそれらの活動をサポートすることを確実にすること、またAIを企業全体にスケールできるようにすることも重要だ。つまり、1つの部門だけでなく、企業全体で協力してビジネスに価値を提供することだ。これにより、リソースを共有し、スケールされた運用を行い、モデルを構築して製品に投入し、その後のモデルのライフサイクルを管理することがカギになる。さらに、当社はAIを製品ポートフォリオの一部としてツールとして活用できるようにしている」と説明した。

AI活用に向けたRed Hatのポートフォリオ

その点、昨年に一般提供を開始した生成AIツール「Ansible LightSpeed」はAnsibleのデータにもとづいてトレーニングされた専用AIサービスであり、ユーザーのプロンプトから推奨コンテンツを生成する。「IBM watsonx Code Assistant」と統合してIBMの基盤モデルにアクセスし、Ansibleコンテンツを迅速に構築するというものだ。

Red Hatの他のポートフォリオにも拡張されており、「Red Hat Enterprise Linux Lightspeed」や「OpenShift Lightspeed」がある。これにより、同社のスキルと知識をAIを通じてユーザーに提供し、プラットフォームを生産的に活用できるようにしているという。

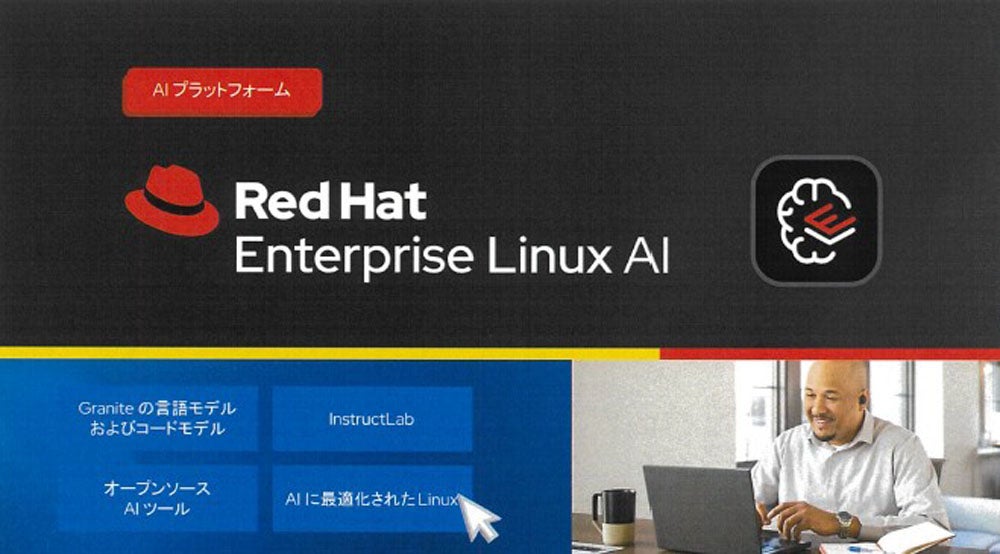

「Red Hat Enterprise Linux AI」

加えて、生成AI開発プラットフォームとして「Red Hat Enterprise Linux AI(RHEL AI)」の一般提供を9月に開始。これは、RHELの基盤を活用してサーバ、仮想マシン、パブリッククラウド上でミッションクリティカルなワークロードをサポートし、IBMによるオープンソースのAIモデル「Granite」を統合。

Graniteは7億または8億パラメータのモデルであり、IBMとRed Hat開発したLLM(大規模言語モデル)を強化するためのオープンソースAIプロジェクト「InstructLab」を使用して企業データをモデルに取り込み・調整し、NVIDIAやインテルl、AMDなどのアクセラレータを柔軟に選択できる最適化された環境でモデルを実行することができるという。

ライト氏は「これにより、特定のユースケースをサポートするために企業固有のデータを使用して小規模なモデルを融合させるワークフローを実行できる。DellやSupermicroなどのOEMパートナーと協力して提供する。RHELが実行できる場所ならどこでも実行できることを意味する」と強調した。

「OpenShift AI」

そして、もう1つは「OpenShift AI」だ。RHEL AIが単一のモデル・ユースケース向けであるが、OpenShift AIはモデルを大規模に本番環境に導入することができるという。また、RHEL AIにはGraniteモデルが付属しているが、OpenShift AIではGraniteを含む任意のモデルを選択することを可能としている。

OpenShiftには、GPUクラスタ全体で複数のモデルを提供するためのスケーラビリティと反復可能なプロセスに関する機能があり、顧客が自社のデータセンターやパブリッククラウドのどこにデプロイするかに関して、選択と柔軟性を提供するとしている。

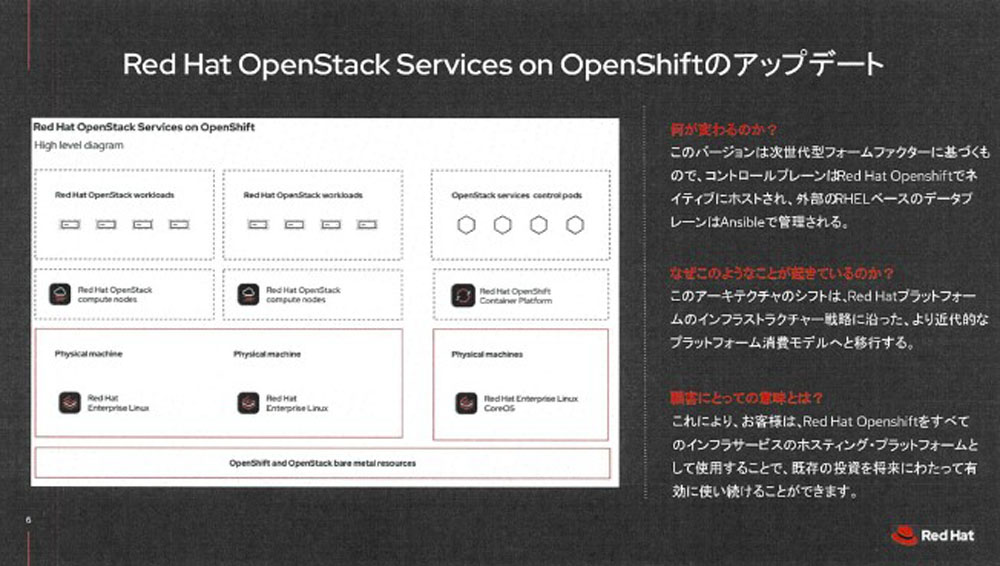

「Red Hat OpenStack Service on OpenShift」

さらには、クラウド基盤ソフトウェア「Red Hat OpenStack」の最新リリース「Red Hat OpenStack Service on OpenShift(RHOSO)」に関するアップデートも語られた。従来、Red Hat OpenStackは独自の物理サーバ上でコントロールプレーンサービスを実行するか、仮想化プラットフォーム上で仮想マシンとしてコントロールプレーンサービスを実行することを可能としていた。

RHOSOでは、コントロールプレーンサービスがOpenShift上のコンテナとして運用される。OpenStackのWorker Nodeは、OpenShiftのWorker Nodeとは独立して動作しており、OpenStackのWorker NodeはRHELで構築し、Ansibleによって管理される。

これにより、OpenStackのデプロイメントから仮想化されたワークロードを、OpenShiftのデプロイメントとともにコンテナ化されたワークロードに統合することを可能としている。

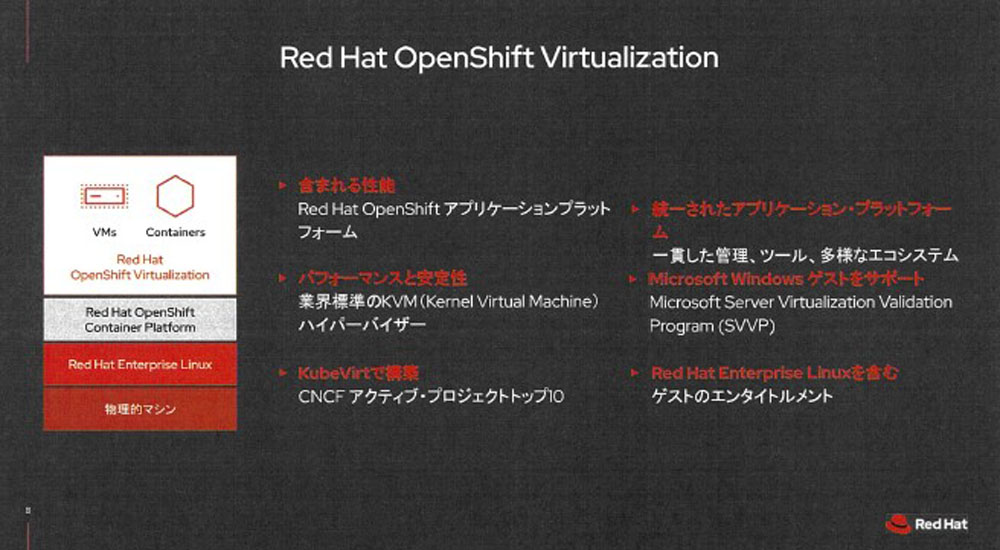

仮想化は「Red Hat OpenShift Virtualization」を訴求

そして、話題はデータセンター内の仮想化されたワークロードに関するものに移った。同社は仮想化プラットフォームを構築する基盤技術としてハイパーバイザーの「Kernel-based Virtual Machine(KVM)」を提供している。

ライト氏は「KVMはRed Hatプラットフォームの一部であるだけでなく、パブリッククラウドや他の商用オファリングのすべての仮想化プラットフォームでも使用されている。今日、お客さまが直面している課題を考えると仮想化の技術的進化というよりも、仮想化の商業的現実に関するものだ。市場の大きな変化により、データセンターにおける仮想化の代替案に関する声を多く聞く。市場の変化に伴い価格上昇に直面し、仮想化にリソースを集中させる必要がある場合、将来のAIへの投資資金をどこから調達するかといいう問題がある」と指摘。

これは言わずもがなBroadcomによる買収に伴うVMwareの大幅な方針転換により、仮想化市場が混乱していることに起因するものだ。

これらに対処するため、同氏は「Red Hat OpenShift Virtualization」を訴求している。これはRed Hat OpenShiftをベースにハイパーバイザーとしてKVMを採用し、Microsoft Server Virtualization Validation Programに認証されているので、Windowsゲストをサポート。

コンテナでVM(仮想マシン)を実行することで、VMをコンテナ化されたワークフローに取り込んで、単一のプラットフォーム上でVMをコンテナと並行してデプロイ・管理することが可能になるという。

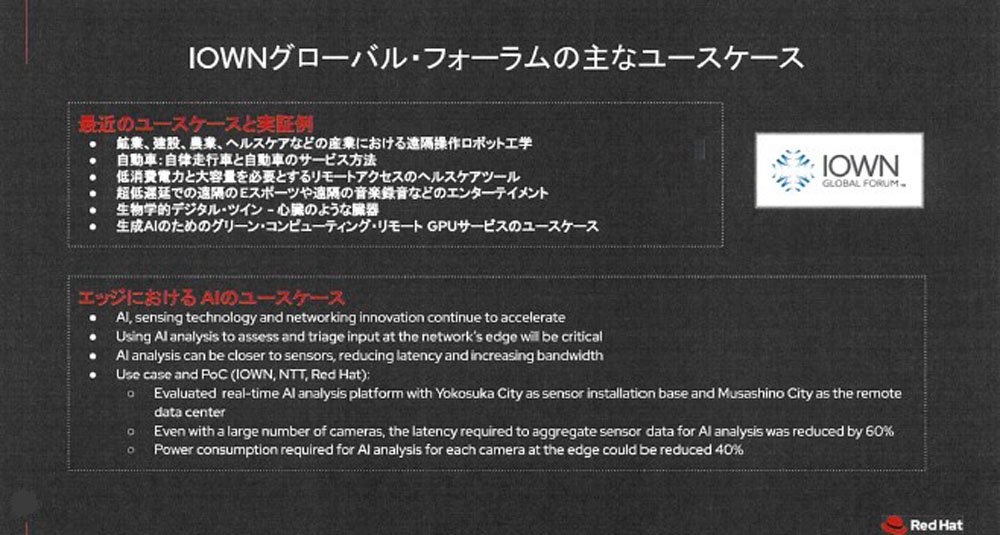

IOWN Global Forumに参画する意義

終盤にライト氏は、IOWN Global Forumについて触れた。IOWN(Innovative Optical and Wireless Network)は、2019年にNTTが提供した最先端の光技術を活用した次世代情報ネットワークに関する構想。その実現に向けて取り組むIOWN Grobal Forumに、Red Hatは北米およびソフトウェアの代表として参画。

同氏は「当社の焦点は、光ネットワークにもとづく次世代ネットワークアーキテクチャを実現することだ。IOWN Grobal Forumのビジョンは光ネットワークを構築し、ネットワークの消費電力を大幅に削減すること。光接続を介してデバイスを直接接続することで、帯域幅も増加することから、現状比125倍の伝送能力の実現を目指しているほか、光速で伝送されるためレイテンシの大幅な削減も期待されている」という。

続けて、同氏は「深く接続されたセンサ、データソース、計算能力を提供し、地理的に分散してAIワークロードをサポートして、ITインフラストラクチャの進化を促進するのに適している。特にGPUやその他のアクセラレータの導入に伴う消費電力の大幅な増加を避けることが可能だ」と、その優位性を説く。

すでに、ロボティクスや産業自動化、スマート農業、スマートシティ、自動運転車、遠隔医療、没入型エンターテイメントなどのユースケースが提起されており、地理的に分散したミュージシャンがリアルタイムで互いの演奏を聞くことができるライブ音楽パフォーマンスのデモンストレーションも実施されている。

ライト氏は「これは驚くべきことであり、医療やネットワーク自体を含むさまざまな市場分野に適用されるデジタルツインの可能性も示唆されており、富士通などのパートナーととのPoC(概念実証)ではメモリ、CPU、GPU、ストレージなどのハードウェアリソースをプールし、特定のワークロードをサポートするためにサーバを動的に割り当てることを可能にしたという。

これまでサーバに標準的なCPU、メモリ、GPU、ストレージがある場合、プロビジョニングは不正確だが、リソースプールから動的に割り当てることでワークロードに直接プロビジョニンした場合、光ネットワークを必要とせずに消費電力を60%削減できたことから、光ネットワークを用いればさらに消費電力を削減できるとのことだ。

そして、最後に同氏は「低レイテンシ、高帯域幅の接続に興味を持つ企業向けのユースケースには、災害復旧やリアルタイム仮想化が含まれる。規制遵守や大規模なグローバル企業の複雑さに直面する中で、顧客がレジリエンスを構築できるようにする移行能力を備えている」と述べ、締めくくった。