東京大学(東大)と科学技術振興機構(JST)は11月23日、量子コンピュータで計算を実行中に発生するエラーを、「量子エラー抑制」手法で取り除く際に必要な計算時間の理論限界を明らかにしたことを発表した。

同成果は、東大大学院 工学系研究科 物理工学専攻の坪内健人大学院生、同・沙川貴大教授、同・吉岡信行助教らの研究チームによるもの。詳細は、米国物理学会が刊行する機関学術誌「Physical Review Letters」に掲載された。

量子コンピュータは、素因数分解や量子化学計算を従来のコンピュータ(古典コンピュータ)よりも桁違いに速く実行できることが理論的に示されているが、現在実現されている小中規模の量子コンピュータでは、演算するたびに外部環境との相互作用に起因するノイズの影響を大きく受けてしまうため、計算結果に大きなエラーが含まれてしまうことが課題となっている。そこで、現代の量子コンピュータでも実行可能な、簡易的な対抗手段としてこれまで提案されてきたのが、エラーの多い量子コンピュータで計算を複数回実行し、その実行結果を古典コンピュータに事後処理させることで、真の出力を予測するハイブリッドな手法群である「量子エラー抑制」だという。

これまで、さまざまな量子エラー抑制手法が提案されてきたものの、手法そのものの理論的研究は不足しているとされ、既存手法よりも有効な手法の有無や、限られた計算資源の中で抑制できるエラーの量の理論的限界などについては良く分かっていないという。そこで研究チームは今回、「量子推定理論」と呼ばれる理論体系の考え方を応用することで、量子エラー抑制に必要な量子コンピュータの実行回数の理論的下限の導出を試みることにしたという。

具体的な研究方法としては、さまざまな微調整が施された量子コンピュータを複数回実行し、その実行結果を古典コンピュータに事後処理させるという、量子エラー抑制の一連の処理を一度に実行できる仮想的な量子コンピュータを構築。量子コンピュータに量子推定理論を適用することによって、そのエラーを取り除くために必要な実行回数計算時間の下限が、その演算回数に対して指数的に増大するという原理限界を導出することに成功したとする。

また、この結果は量子エラー抑制を用いる現行の計算方式では、演算のたびに発生するエラーの除去に莫大な計算時間を必要とするため、量子コンピュータ中で実行可能な演算回数が大きく制限されることを示すものとなったともする。

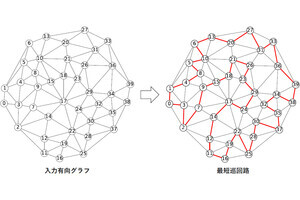

今回の研究ではさらに、導出した下限を達成するような、エラーの除去に必要な計算時間が最小となる最適な量子エラー抑制手法も同定されたという。量子コンピュータ中のノイズは、演算が進むごとにホワイトノイズ(均一なノイズ)に近づいていくが、ホワイトノイズはあらゆる演算が等しい確率で加わるようなランダムノイズであり、量子コンピュータの実行結果を均一に縮小するエラーを起こすことから、ノイズがホワイトノイズで近似できる場合、量子コンピュータの実行結果を定数倍し、エラーによって均一に縮小された実行結果を拡大することによって、エラーを効率的に取り除くことが可能となり、この定数倍手法に必要な量子コンピュータの実行回数は、導出された下限を達成することが確認されたという。これは、この定数倍手法が、ホワイトノイズによる近似が妥当な場合、エラーの除去に必要な計算時間が原理的に最も短くなる、最適な量子エラー抑制手法であることを意味しているという。

-

最適な量子エラー抑制手法の概念図。ホワイトノイズの影響で「均一に縮小する」エラーが加わった量子コンピュータの出力は、古典コンピュータによる事後処理の際、定数倍することによってエラーの影響を受ける前の出力に復元できる (出所:プレスリリースPDF)

研究チームでは今回の研究成果について、エラーの多い量子コンピュータを有効活用する際の重要な一歩であるといえると説明しており、今回の研究で得られた量子エラー抑制の原理限界は、量子エラー抑制のみを用いる現行の量子コンピュータの性能が大きく制限されることを意味することから、量子エラー訂正機構を備えた大規模な量子コンピュータの早期開発を促すことにつながるとしている。

-

さまざまな量子エラー抑制手法における、エラーの除去に必要な計算時間の振る舞い。最適手法に必要な計算時間は、今回の研究によって導出された、量子エラー抑制によるエラーの除去に必要な計算時間の下限と一致する。最適手法を実行することで、さまざまな既存手法と比較して、計算時間を削減することが可能となるとしている (出所:プレスリリースPDF)

なお、完全な量子エラー訂正機構の実現には、数十年におよぶ研究開発が必要とされることが予想されており、中長期的には、量子エラー抑制手法の知見を組み合わせた、ハイブリッドな計算方式が必要になると考えられるとしており、今回の研究で得られた最適な量子エラー抑制手法の知見は、現代においても将来においても、量子コンピュータの実用化を早める役割を果たすことが期待されるとも説明しているほか、基礎科学・材料科学・機械学習など、量子コンピュータの応用が有力視されている幅広い分野の発展への貢献も見込まれるともしている。