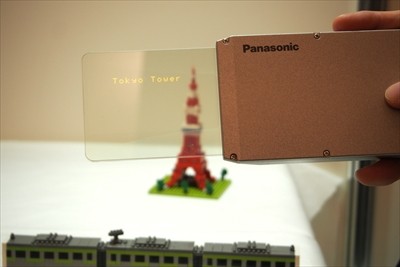

見たものの名前を教えてくれるポータブル端末

パナソニックとの共同開発として展示されていたのが「透明型ディスプレイを搭載したシンプルなポータブル端末によるおもてなしサービス」。展示では透過型の有機ELパネルと、カメラを内蔵した端末から構成されており、透過パネル内に対象を収めると、画像認識でその対象物の名前が表示されるデモを行っていた。

これだけならただの「ちょっと変わった端末+画像認識技術」だが、認識技術はNTTが独自に開発したもので、対象物がどんな角度でも表示できる柔軟性がポイント。わずか6箇所の特徴を記録しているだけなので、データ容量が小さく済み、低解像度(展示ではVGA)のカメラでも正確に認識できるという。

また端末側もかなりローコストに作成でき、ローエンドスマートフォンよりも安く作れる可能性があるとのことで、観光地でのガイダンス用に加え、博物館などの展示説明用にも役立つだろう。ソフトウェア的にはスマートフォンやポータブルゲーム機のアプリとしても実装できそうで、端末を問わずあちこちで使えるようになれば便利そうだ。

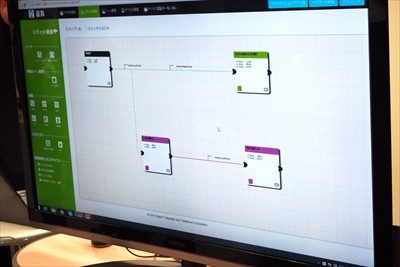

ロボットやIoTをつなぐ「R-env」

市場にはさまざまなロボットやIoT機器が増えてきたが、外部から制御できるものでも、制御コマンドの違いやプログラミングの手間などが障害となって、カスタマイズするのは難しかった。こうした機器同士を組み合わせ、ユーザーの行動に対して処理を返すようにすれば単独で使うときよりも複雑な処理を可能にするためのソリューションが「R-env」(レンブ)だ。

R-envはウェブブラウザベースで動作する一種のプログラミング環境で、制御のインタフェースを統一し、ほとんどマウス操作だけで条件分けされた反応を返したり、複数の機器が連動する動きを設定できる。R-envとロボットをつなぐAPIはオープンな規格として展開し、多くのメーカーの参加を期待したいとのこと。操作も簡単そうで、さまざまな利用法が考えられる。