同日発表された「ドライブモード」ではインターフェースが単純化されたほか、従来版とは違い、"フル音声"に対応し、Google Naviに連動したルート案内も利用可能になった。いずれもドライバーの運転を妨げないための配慮だ。これは日本自動車工業会(JAMA)のガイドラインに従ったものだという。

考え対話とは?

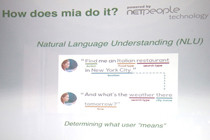

音声認識技術としては、すでにGoogleが精度の高いものを提供している。また、音声アシスタント技術にはNTTドコモの「しゃべってコンシェル」や、アップルの「Siri」などが存在する。しかしイナゴでは"その先をいく次世代アシスタント"として、miaをアピールする。

肝となるのは、自然言語理解+文脈把握+ゴール共有型会話機能をミックスさせた独自技術だ。同社では、それを「考え対話(かんがえたいわ)」と呼んでいる。

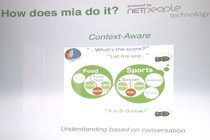

自然言語理解(NLU)はユーザーが何を言っているのか理解するため、文脈把握(Context Aware)は会話の流れを理解するために用いられる。これらの技術によって、ユーザーとmiaの間で人間的な会話が成り立つ。

例えば「麻布十番にあるイタリア料理のレストランを探して」とお願いした後に「そこの天気を教えて」と聞くと、麻布十番の天気が表示される。サッカーの話をしているときに「イタリア」という単語が出ると、サッカーのイタリア代表チームとして認識される(イタリア料理とは認識されない)といった具合である。