好調な決算を発表したNVIDIAが最新のGPUアーキテクチャ「Blackwell」を搭載したAIサーバの生産を加速させている。2024年に報道された生産遅れの問題解決に向けて、FoxconnやDell Technologiesなどのパートナーと協業した結果のようだ。

サプライチェーンに準備時間を与えなかったことため遅れが発生

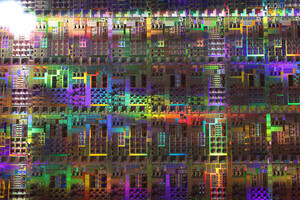

最大36基のBlackwell、および最大72基のGrace CPUを搭載した「GB200」は複雑な構成により液体冷却システム、チップ間接続などの問題が発生していた。NVIDIAはFoxconn、Dell、Inventec、Wistronなどとの協業を通じて2~3カ月前に技術的問題を解決したという。出荷は第1四半期末に開始したとのこと。

台湾のアナリストは「これほど多くのAIプロセッサをサーバ内で同時に動作させようとした例はない。NVIDIAがサプライチェーンに十分な準備時間を与えなかったため遅れが生じた」とコメントしている。

NVIDIAは現在、第3四半期中に次期「GB300」の発売を予定している。GB300は、OpenAIのo1など、より複雑な推論モデルをサポートすべくメモリなどで強化が加わっている。NVIDIAはGB300の展開を加速するため、当初の計画を変更して新設計ではなく従来の設計で進めているという。5月28日付のFinancial Timesが報じている。