PwC Japanグループ(PwC Japan)は7月24日、「生成AIを巡る日米欧中の規制動向」をテーマにメディアセミナーを開催した。

生成AI(ジェネレーティブAI)の登場によって、企業でのAI活用のすそ野が広がりつつあるが、各国・地域のルール整備は後手に回っており、規制の方向性もまちまちだ。同セミナーでは、生成AIを巡る日本・米国・EU(欧州連合)・中国の規制動向とともに、企業が取るべき対応策が解説された。

ハードとソフト、二極化するAI規制の方向性

PwC Japanによれば、日米欧中のAI規制は現在、罰則や禁止行為も定めた厳格な法律によって対応を進める「ハードロー型」と、罰則のないガイドラインや既存の法律で対応を進める「ソフトロー型」の2つに分かれるという。

ハードロー型の対応を進めるのがEUと中国だ。EUは加盟国の個人情報保護を目的にGDPR(General Data Protection Regulation、一般データ保護規則)を制定し、規制適応をグローバルに進めてきた。そうした経緯もあることから、AI規制をリードしていこうとしているそうだ。

一方、中国は国家主導によるテクノロジー政策を推進していると同時に、政治的コントロールにデジタル技術の活用は欠かせないことからAI規制も強固にしていくだろうと同社は予想する。

ソフトロー型の対応を進めるのが米国だ。同国はデジタル技術を経済繁栄の礎と見なしており、ガイドラインなどによって緩やかな規制に誘導する戦略を採用している。現状、禁止事項や罰金などを盛り込んだ規制を制定していない。

日本はAI規制の内容を議論している最中だ。内閣府のAI戦略会議では、AIを利用する際の「ガードレール」となるようなルールの制定が検討されている。具体的には、AIサービス提供者には法令順守や過度な規制に依存しない柔軟性を求め、AI利用者にはAI利用のリスク提示やリテラシー向上などを進める案が挙がっている。

PwCコンサルティング トラストコンサルティング サイバーセキュリティ&プライバシー ディレクターの上杉謙二氏は、「2023年5月に開催されたG7広島サミットで、AIの国際的なルール作りに向けた議論の枠組みとして『広島AIプロセス』を年内に創設することについて合意がなされたが、各論での思惑は異なる。そのため、AI規制が複雑に絡んでいくことが予想される。日本企業が国内基準を基に海外でAI利活用を推進した場合、法令対応コストが発生する恐れがある」と指摘した。

米国ではNISTがAIリスクのフレームワーク策定

EUは2021年に欧州委員会により「EU AI規則」が提案された。同規則は2024年に採択、2026年に施行される見込みだ。このほか、AIに起因する損害に特化した「EU AI責任指令」やAIの開発・市場投入・利用などを対象とした「EU AI規制に関する調和のとれた標準」など新たな規制が登場している。

「EU域外で開発されたAIでも、EUの関連法規制が適用されるため、早期の準備が重要になる。EU AI規則では禁止行為に違反した場合、4000万ユーロまたは全世界売上の7%が企業に制裁金として課される可能性がある」(上杉氏)

中国はこれまで、既存のサイバーセキュリティ関連法を活用しながら、AI関連の規制を制定している。その中でも特徴的なのが、アルゴリズム関連の規制だ。中国ではアルゴリズムの透明性に関する届出制度を敷いている。AIを活用してビジネスを行う企業は、専用のWebサイトからAIで利用している教師データや、アルゴリズム、AIのアウトプットなどを中国当局に届け出なければいけない。

また、AIには個人情報保護やログの保存などの機能実装が求められる。個人情報にまつわる違反があった場合は、5000万人民元または全世界売上の5%の制裁金が企業に課される可能性がある。

米国は、2019年にAIに関する大統領令「Executive Order 13859」が出されたほか、国防総省や連邦取引委員会など複数の政府機関がガイドラインを出している。2023年にはNIST(国立標準技術研究所)が「AIリスクマネジメントフレームワーク」を制定した。

同フレームワークでは、誰にどのような権限を与えるか、システム上の分類をどうするか、時間経過に伴うリスクの追跡、リスクの優先順位付けなど組織のAIリスクを管理するための72の要件がリスト化されている。上杉氏は、「NISTのサイバーセキュリティフレームワークと考え方が類似しているため、セキュリティ部門が取り扱いやすい」と説明した。

サプライチェーンまでアジャイルガバナンスを拡大

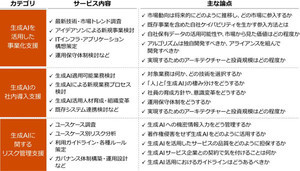

各国における規制動向を踏まえて、上杉氏は「日本企業の責任者は、AI規制に関する海外動向を注視する必要がある。特にAIを利用する企業は、社内におけるAIの管理部門を定めるほか、倫理委員会の設置や従業員教育などが必要になる。実際には、個人情報・プライバシー保護対応やクラウドサービス導入、例外IT対応のように法務、IT、セキュリティの3部門が連携して対応することになるだろう」と述べた。

ただし、法令対応はあくまで最低ラインの対応となり、企業が競争力を確保するためには、法令制定前の積極的なガバナンス強化が重要だという。

ガバナンス強化にあたって、PwC Japanはさまざまなステークホルダーと、外部変化に対する目的の再設定を含めてガバナンスの運用結果に基づいてPDCAを行う「アジャイルガバナンス」を推奨する。アジャイルガバナンスを成功させるうえでのポイントはスモールスタートだ。

例えば、生成AIの組織内での利活用では、最初は限られた領域・分野での生成AIの適用と、それに応じたガバナンスの策定・運用をスタート。その後、生成AIを使ったサービスの成長と利用拡大に伴って、ガバナンスの強度を高めて範囲も広げていくといったアプローチとなる。

PwCあらた 執行役 新規ソリューション開発/業務DX担当、CIO/CISOの宮村和谷氏は、「技術発展が早い時代においては、環境変化を捉えて、ガバナンスを継続的に進化させることが重要となり、そのための手段がアジャイルガバナンスだ。生成AIのサプライチェーンは、ネットワーク型の産業構造で支えられていくことになるため、サプライチェーンワイドでアジャイルガバナンスを整備・運営していく必要も出てくるだろう」と予想する。

アジャイルガバナンスをサプライチェーンに拡大するうえでは、サプライチェーンを構成する他組織だけでなく、ステークホルダーや多様な専門性を巻き込むことが重要になる。そのうえで、ガバナンスに必要な知見の共有やガイドづくりなどに、さまざまな組織が積極的に参加する取り組みが求められる。