米Googleは5月10日(現地時間)、開発者カンファレンスGoogle I/Oのキーノートで、対話AI・生成AIの実験的プロジェクト「Bard」のアップデートを発表した。大規模言語モデル(LLM)を「PaLM 2」に移行。プロンプトに画像を含められるマルチモーダル、コーディング支援の強化や新しいエクスポート機能などを紹介した。また同日より、順番待ちのリストに登録することなくすぐに使用できるようになり、英語以外のサポート言語として日本語と韓国語が追加された。

同社は2月にBardを発表し、3月にUS英語をサポート言語に米国と英国で参加者を制限した一般への試験提供を開始した。5月10日から順番待ちリストへの登録が不要になり、180以上の国・地域においてBardのサイトでGoogleアカウントを使ってサインインするだけで利用できるようになった。発表とともに日本語と韓国語でのBardとの対話が可能になっており、まもなく40カ国語に対応言語を拡大する計画だという。

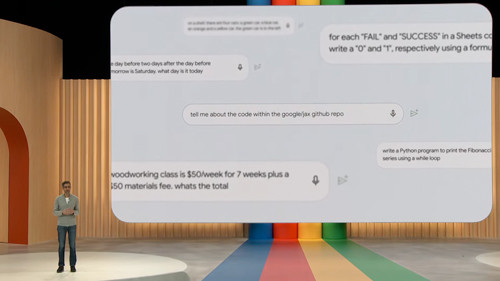

PaLM 2では、100以上の言語にまたがる多言語テキストを学習させ、イディオムや詩、なぞなぞといった、ニュアンスの異なるテキストも多種多様な言語間で理解、生成、翻訳する能力が向上している。また、科学論文や数式を含むWebページ、公開されている大量のソースコードを学習しており、ロジックや推論、数学の能力が向上しているほか、PythonやJavaScriptといった一般的なプログラミング言語に加えて、Prolog、Fortran、Verilogといった言語の特殊なコードの生成にも対応する。

PaLM 2は従来のモデルより高速かつ効率的に動作する。また様々なユースケースに導入できるように、Gecko、Otter、Bison、Unicornの4つのサイズでの提供を予定している。最も軽量なGeckoはモバイルデバイスでの動作が可能。オフライン時でもデバイス上でインタラクティブなアプリケーションを実現できるほど高速に動作する。

コーディング支援では、開発者が好むダークテーマを追加。引用を改善するアップデートを来週から提供する。例えば、対話においてBardによるコードブロックや他のコンテンツの引用に下線を引いて示し、ユーザーがソースを簡単に確認できるようにする。また、Colabに加えて、Replitにエクスポートする機能を近日中に追加する。

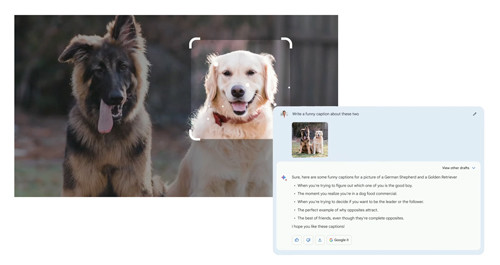

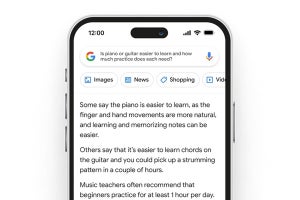

マルチモーダルは、Google Lensを使って画像を含めたプロンプトを可能にする。例えば、ペットの犬の写真をアップロードして、「この犬の面白いキャプションを書いて」と依頼すると、BardはGoogle Lensを使って写真を分析し、犬の品種などの情報を使っていくつかのクリエイティブなキャプションを作成・提案する。

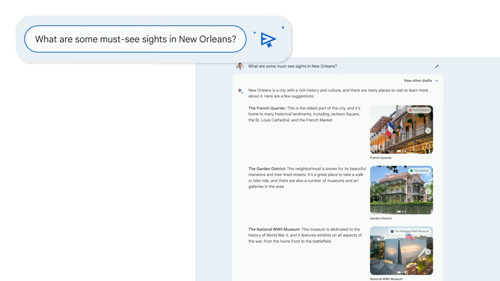

また、対話での受け答えにもビジュアルを活用する。例えば、「ニューオーリンズで必見の観光スポットはどこですか?」という質問に対して、Bardはテキストだけではなく、その場所の写真も含めておすすめのスポットを紹介する。

生産性の支援という点では、Docs、Drive、Gmail、Mapsなど、Googleのアプリケーションやサービスの機能をBardの体験に統合していく。

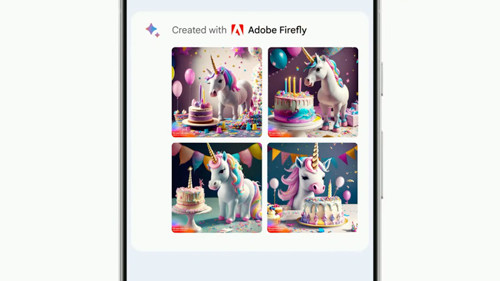

さらに外部パートナーと接続する拡張機能も提供する。まずは数カ月中にAdobeの生成AIモデル「Adobe Firefly」をBardに統合し、言葉でアイディアを説明して画像を生成し、それをAdobe Expressで編集したり、デザインに加えられるようにする。さらに、Kayak、OpenTable、ZipRecruiter、Instacartなど、様々なパートナーと拡張機能提供の作業を進めているという。