アセスメントを含めたPDCAの実施が不可欠

こうした課題を解決して、企業が自社の成長を実現できるAIの導入を成功させるにはどうしたらよいのだろうか。保科氏は、「個別のAIエンジン導入をゴールとするのではなく、自社のビジネスのゴールに応じた業務の自動化・高度化を目指し、そのツールとしてAIを位置付けるべき。従来のSI開発の考え方を捨て、あらゆる業務に『今ある』AI技術を素早く取りこんで、育てていく必要があります」とアドバイスする。

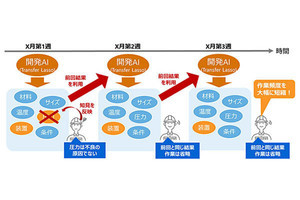

これまで、大規模なシステム開発は数年単位のプロジェクトの下で進められることが多かったが、AIの導入はトライ&エラーを繰り返し、スピーディーに進めていくことが重要となる。「AIはデータやモデルを学習してみなければ、何が正解かわからない」と保科氏。

したがって、AI導入においてはPoC(Proof of Concept:実証実験)が必要不可欠となる。PoCの中で、「ダメなものは切り捨て、いいものを取り入れていくことが大事」だという。

保科氏は、基幹システムと連携した形でAIを取り入れ、AIをスケールできる仕組みとして、同社の「AI Hubプラットフォーム」を紹介した。同プラットフォームは複数のAIエンジンから最適なエンジンを組み合わせ、人間のオペレーターとの協調も可能になっている。

「AI Hubプラットフォーム」では、「マネジメントコックピット」「バックオフィス」「コンタクトセンター」など、業務領域ごとにAIを活用したさまざまなサービスを提供している。

そして、保科氏はAIを効果的に導入するためのアプローチとして、アセスメントから始まり、「PoC設計」「分析・施策実施」「業務運用・自動化」「精度改善」といったフローから構成されるPDCAを紹介した。

AI導入のPoCまで進んだものの、その結果をうまく生かせていない企業もあるだろう。そうした企業の場合、アセスメントが十分できていない可能性が高いという。自社がどのような状況であり、そこから成長するために何が必要であり、それを実現するためにどんなAIが必要なのか――こうしたことを、PoCを実施する前に検討しておく必要がある。

また、施策実施の段階では、単にAIサービス・ツールを導入するだけではなく、周辺の業務プロセスやデータフローの改善、そして運用にあたる人材の育成・定着化も含めて取り組んでいくことも必要だ。

AIの利用拡大に伴って生じるリスクへの対策も必要

最後は、AIによる「社会貢献」「リスクの顕在化」について紹介したい。新型コロナウイルス感染症の感染防止に関しても、さまざまなITベンダーや大学が協力して、AIを活用した研究を進めている。例えば、理化学研究所はJALと共に、世界一の計算性能を持つスーパーコンピュータ「富岳」の計算資源を活用して、航空機内における新型コロナウイルス感染症拡大防止に関する研究を行っており、先日、その成果が発表された。

アクセンチュアも東京女子医大と共同で、生活や仕事を大きく制限し、高額の医療費が社会的な問題にもなっている腎疾患治療へのAI活用に取り組んでいる。腎移植後の生着率予測や投薬シミュレーションを実施し、医師の診療サポートを目指すそうだ。

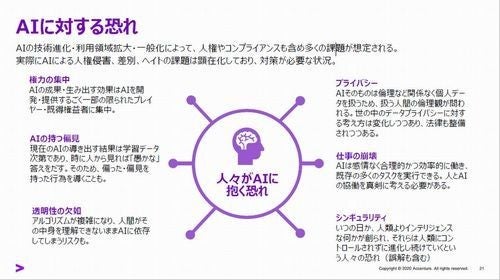

こうして、AIの利用領域が拡大し、AIの活用が一般化する中で、「顔認証の人種バイアスなどが既に取り沙汰されているが、AIの影響によって多くの課題が顕在化されており、対策が必要な状況にある」と、保科氏は指摘する。顕在化しているリスク以外にも、「権力の集中」「AIの持つ偏見」「透明性の欠如」「プライバシー」「仕事の崩壊」「シンギュラリティ」といった恐れ(誤解も含む)を人々が持っているという。

こうした恐れを解消したうえで、責任あるAIの活用を進めていくために、保科氏はAIの「管理」「設計」「監視」「再教育」が必要であると説明した。「AIを利用する上でデータやモデルが不可欠ですが、人の作ったデータにはバイアスが含まれるし、モデルでそれが増幅してしまうこともあります。そこで、それらバイアスをいかにして取り除くかが重要となります。また、モデルに関しては、『なぜそう判断したのか』を明らかにする透明性が求められるケースも増えています」と保科氏。AIによって人の仕事が奪われるかもしれないという不安に関しては、AIと人の得意とすることを見極め、AIが得意なことはAIに任せ、人は付加価値の高い業務に集中し、人とAIが協働していくことが必要だ。

保科氏は、最後に、2021年にAI時代を迎えるあたり重要になる5つの原則として、以下を紹介してくれた。