半導体ベンダが考える自動運転車の姿とは

今回のDevConでは、このように基調講演の大半をRenesas Synergyに費やしたわけで、その力の入れようが判るというものだが、残った時間は自動車向けにあてられた。氏は「米国の場合、2020年に4000万人が70歳以上になる。問題はこのうち、自力で運転できるのは4%しかいない事だ。つまり残った人々の移動をどう社会が支えてゆくかを考えねばならない。解決方法は2つある。1つは欧州や日本のように公共交通機関を充実させる方法だ。そしてもう1つは、自動運転車だ」と切り出した。このあたりの視点は、いかにも米国的である。

もう1つの事情として、過去数年の間、事故発生時の死亡率を引き下げるためのさまざまな工夫(エアバッグやABS、TPMS、etc…)が実装されてきた結果、現在では事故発生要因の95%は運転者によるものであり、より一層事故率を下げるためにはやはり自動運転車が必要、という事になっている(Photo28)そうだ。

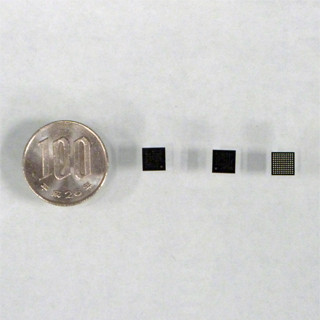

このために、車にはさまざまなセンサが搭載され(Photo29)、これらを利用して総合的に判断を行う事になる。幸いな事にもうすでにこうしたセンサは存在し、ちゃんと機能することが確認されているとした上で、ただ、こうした多くのセンサの結果を取り込んで分析するためには、高い処理性能が必要になる事を強調した(Photo30)。これに関してはすでにR-Carシリーズというソリューションが提供されているが、これに併せて新しく「R-Car T2」(Photo31)と「R-Car W2R」(Photo32)がそれぞれ発表されたほか、新たにHarbrickとの協業が発表された(Photo33)。これはHarbrickの「PolySync」というプラットフォームをR-Carの上に搭載し、この上に自動運転に必要とされるアプリケーションを実装してゆくというもので(Photo34)、この協業により自動運転に必要となるインテリジェンスを実現できる、と力説して氏の基調講演は終了した。

|

|

|

Photo31:日本では9月9日に発表済。H.264といっても実際は全部Iフレームで処理する(つまりフレーム間演算は行わない)事で低遅延を実現しているが、それでもMJPEGに比べればずっと高い圧縮効率を実現できるとの事 |

Photo32:こちらも日本では9月29日に発表済。R-Car W2Rの日本向け仕様が後回しなのは、やはりADASシステムの開発が欧米が中心な事と無縁ではないのだろう |

|

|

|

Photo33:PolySyncはあくまで(Renesas Synergyと同じく)プラットフォームであり、この上で開発者は自分の必要とするADAS向けの要素を自分で構築できる |

Photo34:最終的には自動ステアリングや自動アクセル/ブレーキなど、自動運転に必要になる要素をすべて実装できるとした |

全体としてみると、ポイントが絞られていて判りやすかった反面、色々落とされていた事柄(例えばRZ/T1の発表とかRenesas Synergyの最初の2製品の発表)も多いのだが、このあたりは後で直接Ali Sebt氏に伺ったのでこれも別記事でお届けする予定だ。やはり一番インパクトが大きかったのはRenesas Synergyということになるが、次回はこれについてもう少し細かく(インタビューも交えて)お届けしたい。