筆者は、昨年夏にICT支援員の資格を取得しました。ただ、企業に勤めている都合上、リアルに学校を支援することはできません。そこで、夜な夜な教育の未来を考えていこうと企画しました。最初は、「デジタルスクール」というテーマで、小さな机にパソコンを置くとほかに教材やノートが置けないなぁ……そこで、「デスクトランスフォーメイション(DX!?)だ」と、書くことを思い立ちました。

「個人最適なまなび」や「協働のまなび」を成立させるには、「考える生徒」をモニターすることが必要です。そのためには、取り組みの姿勢や考え方など、学習の過程と結果をデジタルの目で観察しなければなりません。

今回も前回に引き続き、「考える生徒」をモニタリングするために必要なことを考えていきます。

CBTは、CATそしてCMへ

コンピュータベースのテストをCBT(Computer Based Testing)といい民間資格試験では一般的となっています。いわゆる紙ベースの試験をコンピュータに移し替えたものです。一部の民間試験では、すでにCAT (コンピュータ適応型テスト:Computerized Adaptive Testing) に移行しています。

CATでは、受験者の回答状況に応じて、より受験者の学習レベルを推定しやすい問題に順次切り替えていく方式(小職にとってみれば、ふるい落としの仕組み)です。さらに、CM(連続測定:Continuous Measurement)では、期末テストという大きな区切りではなく、学習の区切りごとに設けてある確認テストを頻繁に行うことで、未習熟な領域を可視化して、先生と生徒を(デジタルで)補っていくモデルです。

CMでは、まなびの痕跡(軌跡)の時系列変化を毎授業時間や学習要素ごとに測定(Continuous Measurement)る、授業と一体となるモデルです。このCMモデルでは、期末テストの結果で通知書を書く必要がなくなりそうです。

結局のところ、教育のDXを進めるためには、生徒と寄り添って走る(伴走)ことで、「学びのリデザインをループさせる」しかないと思えてきます。

CBTはデジタル化で、CMはDXですね。

考える生徒をセンシングする

さて、個別最適のまなびを最良の状態にするためには、常にセンシングし、学習環境を改善することをまわし続ける必要があるとお話ししました。そして、そのために必要な「まなびの痕跡データ」をひろい続ける必要があると。

結局ゴールはこのあたりにありそうです。では、「まなびの痕跡データ」とは何でしょうか?何が取れるのでしょうか?よくある回答は、こんな感じかと思います。

子供たちの成果物や思考過程を画面で可視化

40人分も見ていられません。可視化できるのならAI分析結果の表示まで自動で進むことが望ましい。

学習時間やテストの正誤判定を記録し、授業や学びに直ちに活用

テスト正誤程度では、問題の不適切さが露呈する程度ではないか?

意見・回答の即時共有を通じた効果的な協働学習

即時共有は、意見の誘導、考えの「寄らば大樹の陰」を招くだけなので適切に扱う必要がある。

スタディ・ログPDSに保存され、自ら学びを振り返り

算数のような積み上げ教科であれば、次に進めなくなるため、活用できるかもしれない。

AIを活用したドリル(知識・技能の定着を助ける個別最適化)

正解・不正解の二択の答えではなく、もっと踏み込んだ回答分析が欲しい。

さらに、どんなデータが取れるでしょうか?直接的観察データと直接的入力データに分けて、見て行きましょう。

直接的観察データ

音声画像データ

・端末のカメラやマイクを通して、目の動き、発言(トーン)やしぐさの可視化。 ・顔の表情から、学習状況を推測する。(AI感情分析、ニュアンス) →安定してデータ取得できるか、保証の限りではない。

マウスにセンサー

マウス自体にタッチセンサーや握力センサー、湿度センサーを取り付ける。 →コスト高。マウスがない場合もある。

直接的入力データ

・端末のキーボード、マウスなどの入力系の動かし方をセンシングする。迷いはあるか?決定までの時間など。 ・端末での文字の選択動作、コピッペバッファの中、クリック状況など。 ・授業内容やテストへのアンケート。

直接的出力データ

試験成績データ

回答順、回答までの時間、回答選択のまよい、記入文字の修正頻度、単純に正誤。

動画視聴データ

繰り返し、早送り、特定のセクションのみ選択などの操作データ、カメラ映像データ。

間接的出力データ

・理解度推定AI(アルゴリズム)が分析したデータ。 ・思考過程の分析評価データ。どんな思考をし、どのあたりまで到達しているのかを示すデータ。

これらが難題かつ重要です。

-

さまざまなタイミング取得できる「まなびの痕跡データ」をひろい集め、「まなびのOS」を成立させ、「まなびのリデザインをループ」させます。まなびの進捗は「個人のダッシュボード(児童生徒ボード)」でいつでも確認できます

最低限の学習到達点

どのくらいの頻度と確度で、どのような学習データが取れるのか?取れそうなデータはありそうですが、実現困難であったり、データ品質が安定しないため分析が困難であったりする可能性があります。授業中の節目節目に確認ポイント(簡単な作業)をおいて、理解度を観測・推測する程度が現実的かもしれません。

求めていることは学習に関するすべてのデータ「まなびの痕跡データ」です。しかし、生徒はモルモットではないというジレンマ。CMのような連続測定モデルで、理解度をできる限りリアルタイムに推定しないと、今戻るべき学習内容(学習単元)を指し示せないし、次に進むべき単元や解決する課題をすぐに提示できません。

リアルタイムに変えていくという個人最適の世界。これを突き詰めると時間割という枠は必要なくなり、最低限の学習到達点のみがある学びの世界が見えてきます。

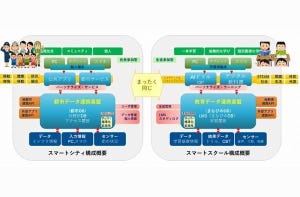

まなびのOS

まなびのOSは、スマートシティの「都市OS」のように、特定のアプリ専用のデータベースや専用の入力データがあるのではなく、すべてのデータは、必要に応じてすべてのアプリで利用され、他の教育委員会とも連携します。新しいアプリを採用したときもすぐに過去の「まなびの痕跡」を汲み上げて、最適に使えるようにするものです。

また、まなびのOSには、学習要素ごとに細かく確認フェーズを設ける連続測定(Continuous Measurement)が必要です。都市OSがスマートフォンの操作からフィードバックをもらうのと同じように、都度CMを行うことで、リアルタイムに「学びのリデザインをループさせる」ことができます。その結果、生徒にとって最適な学びの環境を提供し続けられるはずです。

都市OSデータ連携基盤の特徴といわれる「相互運用」「データ流通」「拡張容易性」はそのまま「まなびのOS」にも必要な考えです。

学習要素のつながり

「理科」を考えれば、「算数」が基礎となることが容易に想像できますが、「国語」を生かして的確に読み取ることも必要です。実験の背後にある目的は「社会」であり、「アート」な感覚も必要かもしれません。細かな学習要素はそれぞれに関係性があり、教科の枠にこだわる必要性がなくなります。まなびのOSのデータベースには、教科での分類は不要かもしれません。つまり、教科のロードマップというよりは、学習要素の関連が重要になると思います。

学習パターン(思考や感情分析)

例えば、1人の先生が40人程の生徒の様子を常に気に留めるのは、いくらICTがマルチ画面で操作の様子を俯瞰させてくれたとしても難しいでしょう。40人分の生徒の学習のプロセスを、全て見るのは、やはりAI分析のようなオートメーションに頼るしかありません。その結果、学習の到達度(見える化されたゴール)は生徒によって変えることができ、個人ダッシュボード(児童生徒ボード)で自己管理が可能になります。

便利なアプリはたくさんありますが、真にDXできるものは少ないのかもしれません。しかし、まなびのOSを中核に据えることで、DXの領域に到達するアプリはあり得ると思います。

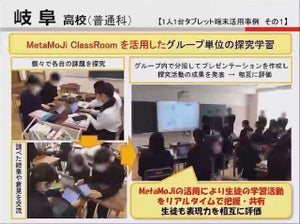

協働のまなび(コラボレーション)

多様性の中での協働こそが、他人の感情や振る舞いを観察してEQを高めていく分野だと思います。個別最適のまなびとは対極です。人や物事の多様性に触れながら、調査、共有(話し合い)、調整、最終的にはまとめへ収束させ、表現(伝える力)まで完結させるのは、社会人でもパワーを使います。

このような協働の流れから得られるコミュニケーション能力やリーダーシップの能力は、ずばりEQです。個別最適なまなびで培ったIQを生かすのが、協働のまなび(EQ)であると言えます。

思考分析評価、感情推測という切り口は協働の学びでは重要になりそうです。この目に見えにくい頭脳の中の変化を見える化することは、やっかいなこととおもいます。もし、見える化ができれば、同じ目的、課題に向かい合える効果的な人選(グループ割り)がAIで可能になります。逆に多様性の混沌さを体験する人選も可能でしょう。いつも同じグループは無策だと感じます。

AI過信は禁物

AI が出してきた「答え」を、かみ砕いて妥当性を分析できる先生がいなければ、AIは使えません。 最後は人です。AIにEI/EQを教えることはおそらくできないと思います。

最後に

現実には、都市OSはこれからですので、「まなびのOS」のようなものもこれから検討していくことになるでしょう。テクノロジーを駆使した教育のアプリやサービスが文房具のように活用される姿が近い将来実現することを強く期待します。次回は、協働のまなびに必要な「多様性を実現するメタバース」を夜な夜な考えていきたいと思います。では、おやすみなさい。