生成AIの進化が止まりません。筆者自身も連日数時間以上活用しており、業務において不可欠な存在となっています。→過去の「柳谷智宣のAIトレンドインサイト」の回はこちらを参照。

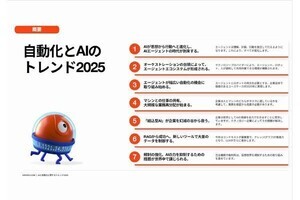

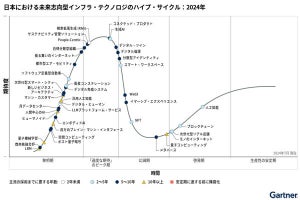

一方、最近のガートナーのハイプサイクルでは生成AIが「幻滅期」に分類され、メディアでもそのネガティブな側面が注目を浴びるようになっています。私は生成AI推進派で、日本企業が積極的に活用すべきだというスタンスは変わりません。

しかし、生成AIが及ぼす負の影響を無視するのはフェアではないため、定期的にネガティブな側面を調査した論文にも目を通しています。そこで、今回は生成AIのダークサイドに着目した最新の研究を紹介します。

生成AIの社会浸透は止まらないし、止めるべきではありません。ただ、その負の影響を知り、正しく対処するための体制を整えておくことが重要です。原稿の最後に、この課題に対処する方法もまとめて紹介しているのでチェックしてください。

生成AIは思考を鈍らせるのか?

2025年4月に発表された論文「The Impact of Generative AI on Critical Thinking: Self-Reported Reductions in Cognitive Effort and Confidence Effects From a Survey of Knowledge Workers(生成AIが批判的思考に与える影響:知識労働者の調査から見る認知的努力の自己報告的減少と自信への影響)」では、生成AIが知識労働者の批判的思考に与える影響を調査しました。

マイクロソフトとカーネギーメロン大学の共同研究チームが、週1回以上生成AIを業務利用する知識労働者319人にアンケートを実施したのです。

集まった936件の具体的事例を解析すると、回答者の約59%が「AI活用時にも批判的思考を行った」と述べる一方で、AIの提案をそのまま採用した例も多く、判断の質が揺らいでいる様子が浮かび上がりました。

AIへの信頼度が1ポイント上がるとクリティカルシンキングの発動確率が0.69ポイント下がるという逆相関です。その反面、自らの専門性に対する自信が高い人ほど批判的思考に時間を割く傾向が強まりました。

つまり「AIを盲信すると考える量が減り、自己効力感が高いほど吟味が深まる」という二重構造が確認されたわけです。

労働者が感じる思考負荷も変質しています。情報検索や要約では負荷が軽くなる半面、生成結果の真偽確認や文脈調整に労力が移動し、従来の「作業者」から「監督者」への役割転換が進行しています。

論文はこの現象を「タスク執行からAI統合へのシフト」と呼び、特に分析・評価段階で顕著だと指摘しました。

教育におけるAI導入に悪影響は?

2024年5月3日に公開されたHeliyon誌の論文「Unveiling the Shadows: Beyond the Hype of AI in Education(影を暴く - 教育におけるAIの過剰な期待の向こう側へ)」(執筆:Abdulrahman M. Al‑Zahrani)は、教育現場におけるAI活用の陰に潜むリスクを浮かび上がらせました。著者はAI礼賛の風潮に一石を投じ、私たちが見落としがちな影の部分へ光を当てています。

本研究は、まず2020~2023年の関連文献238本を精査し、その中から56本を抽出して理論モデルを構築しました。続いて、サウジアラビアの大学関係者260人を対象に調査を実施し、10項目の懸念を検証しました。

得点が高かったのは平均4.11を記録した「AI生成コンテンツの影響」です。また「AIへの信頼性依存」も平均3.78と高めです。

これらは、創造性の低下やシステム障害時の学習停止など、技術を使うほどに生まれる新たな不安を示唆しました。数値が突き抜けた背景には「答えを用意してくれる存在」へ無意識に委ねる心理が透けて見えます。

「人間的つながりの希薄化」で平均3.57とやや下がりますが、顔合わせの減少が動機付けや帰属意識を損なうと学生は感じ、AIが提供する一律の学習経路では「自分だけに向けられたまなざし」が得られないと訴えています。

各懸念の相関にも目を奪われます。AIの信頼性依存と生成コンテンツ問題や、透明性不足と教員研修課題は密接に結び付いていました。1つの傷が別の傷を深める構造を示す結果で、単発の対策では連鎖を断ち切れない現実が浮き彫りになっています。

興味深いのは、性別・職種・学位・AI利用頻度などの属性が懸念レベルに有意差を生まなかった点です。AIがもたらす影響は立場を選ばず、誰もが等しく当事者であるということがわかります。

生成AIが学習をむしばむ可能性は?

2024年1月に発表された論文「Is it harmful or helpful? Examining the causes and consequences of generative AI usage among university students」(生成AIの利用は有害か有益か?大学生における生成AI利用の原因と影響を検証する)は、パキスタンの大学生を対象にして調査を行いました。

学業負担や時間的なプレッシャー、報酬感受性、品質感受性がChatGPTの利用に及ぼす影響を調べました。まず、8項目の「チャットGPT利用度」の尺度を定義し、165人から信頼性係数α=0.914と確度の高いアンケート結果を得ました。続く検証研究では494人を3回に分けて追跡し、蓄積したデータをPLS‐SEMで解析しています。

結果は明らかでした。課題量が重いほど利用度は高まり(β=0.133)、締め切りの圧力でも同じ傾向が強まりました(β=0.163)。つまり「時間も手間も足りない」と感じた瞬間、生成AIが差し出す安易な「近道」に手を伸ばしてしまうわけです。

一方で、過度の依存は学習の質を損ないます。利用度が上がるほど先延ばし傾向が強まり(β=0.309)、記憶力の低下も顕著になり(β=0.274)、成績平均値が落ち込むという負の連鎖が確認されました(β=−0.104)。生成AIはあくまで補助輪であり、本来鍛えるべき思考力や記憶力を代行してはならないという警鐘です。

興味深いのは報酬感度、つまり成績へのこだわりが強い学生ほど、かえってAI利用を控える傾向が見えた点です(β=−0.102)。評価を失うリスクを敏感に察知し、地道な学習を選ぶ姿勢が見えます。

AI時代の“考える力”の危機とは

2025年1月3日公開の論文「AI Tools in Society: Impacts on Cognitive Offloading and the Future of Critical Thinking(社会におけるAIツール:認知的オフローディングへの影響と批判的思考の未来)」(著:Michael Gerlich)は、AI依存が思考力に及ぼす影響を真正面から検証しました。

英国在住の17歳から56歳超までを含む666人を対象に、アンケートと50件のインタビューを組み合わせた混合型調査を実施しました。定量的にはANOVAとランダムフォレスト回帰、質的洞察にはテーマ分析を用い、批判的思考を測るHCTA(Halpern Critical Thinking Assessment)も導入しています。

結果は衝撃的でした。AIツールの使用頻度が高いほど批判的思考スコアが低下し、相関係数は-0.49を示しています。さらに、AI使用と「認知オフローディング(外部化)」の間には+0.89の強い正相関があり、AIに頼るほど自力で考える機会が奪われる構図が浮き彫りになりました。

年齢差も顕著です。17~25歳の若年層はツール依存度が最も高く、批判的思考得点が最低でした。一方、46歳以上では依存度が下がり、思考力は相対的に高水準を保っています。世代間ギャップが教育現場のみならず職場にも波及する兆しが見えます。

研究が指摘する核心は、タスクをAIに委ねることで脳内負荷が減る反面、深い分析や仮説検証を行う機会が激減する点です。便利さの裏で、いわゆる思考の筋トレが不足し、長期的には判断力の衰えを招くリスクが示唆されました。

もっとも、教育水準が高い参加者はAIの恩恵を享受しつつ、情報の裏を取る姿勢を保ち、思考力低下を抑制していました。著者は、アクティブラーニングやメタ認知訓練を併用すれば、AIと共存しながら批判的思考を伸ばせると提言しています。

AI頼みの学習が脳を鈍らせる?

2024年6月公開の論文「The effects of over-reliance on AI dialogue systems on students' cognitive abilities: a systematic review」(AI対話システムへの過度な依存が学生の認知能力に及ぼす影響:系統的レビュー)は、生成AIに頼り切る学生の思考力低下を体系的に検証しました。

研究論文が警告する「過度な依存」とは、生成AIが提案する回答を疑問を持たずそのまま受け入れてしまう態度のことです。パキスタンと中国の大学生285人を対象とした研究では、68.9%の学生が怠惰になり、27.7%が意思決定能力の低下を経験したことが明らかになりました。

インドネシア東部と中部の25の高等教育機関から245人の学部生を対象に、AIの学術的文章作成への統合について調査したところ、AIへの依存による批判的思考能力の低下(75%)、技術への過度な依存リスク(73%)、誤報や不正確さの蔓延(70%)などの懸念が報告されました。また、意図しない盗用(69%)やアルゴリズムバイアス(40%)などの倫理的問題に関する深刻な懸念も示されました。

倫理的課題も深刻です。幻覚(ハルシネーション)やアルゴリズムバイアス、盗用、プライバシー侵害、透明性欠如が連鎖し、AIへの安易な信頼を加速させます。たとえば、提示された178件の参考文献中、実在しない文献が28件見つかったという報告は衝撃的です。

思考面では、迅速な回答に慣れた学習者が「ゆっくり考える」回路を使わなくなり、判断根拠の吟味が弱まる現象が観察されました。意思決定力の低下は調査対象学生の27.7%に及び、創造力の萎縮や問題発見力の停滞も無視できません。

生成AIの負の影響を抑えメリットを最大化するための提言

生成AIのメリットを最大化しつつ、学習者の批判的思考や創造性を損なわないためには、教育現場と開発者が協調して多層的な対策を講じる必要があります。

まず、カリキュラムにAIの仕組みや潜在的バイアスを学ぶ批判的メディアリテラシーを統合し、学生が生成物を鵜呑みにせず吟味できる素地を育てることが重要です。最近は、授業で使う資料のPDFファイルに偽の情報を仕込み(プロンプトインジェクション)、出力をコントロールすることで、AIに丸投げしている学生を発見する取り組みが流行っていますね。

学習評価も見直す必要があるでしょう。AIが人間の能力を超えているのですから、従来の暗記詰込み型学習の意義は薄れています。答案生成が容易な知識再生型テストより、独創性や論証の深さを測る課題へ移行し、AIの補助を超える思考を要求する方が建設的でしょう。

教師はアクティブラーニングやプロジェクト型学習を取り入れ、学生が自らの言葉で仮説を立て、実証や取材で裏付けを取るプロセスを評価軸に据えることで、批判的思考を日常的に鍛えられます。

最後に、人間中心の学びを守る環境づくりが重要です。AIは教師の代替ではなく補完として位置づけ、情緒的なサポートや学習コミュニティとの対話を維持しましょう。

縦断的な研究で認知に対する影響を測定し、教師の研修と学生向けワークショップを継続的にアップデートすれば、生成AIの長所を最大化しながら批判的思考と創造性を育む持続可能な教育エコシステムが実現できるでしょう。

仕事で使う場合も、出力をそのまま受け入れるのではなく、十分に吟味する必要があります。研究の結果、自分に自信がある人は十分に吟味する傾向にあり、若かったり、締め切りが近かったり、課題が多いほど吟味しない傾向にあるので注意しましょう。

生成AIは人類の進化を加速するツールです。くれぐれも、手を抜くためのツールとして使ってダークサイドに落ちてはいけません。ぜひ、きちんと使いこなし、そのメリットを享受してください。