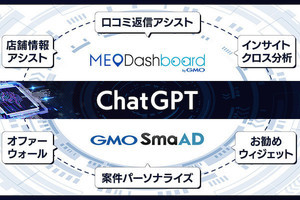

「ChatGPT」などのジェネレーティブ(生成)AIが大きな注目を集める中、有害な情報の拡散などの懸念を受けて米政府が規制の検討を開始するようだ。

米商務省の国家電気通信情報管理庁(NTIA)は4月11日、AIの説明責任の対策について正式なパブリックコメントの募集を開始した。

潜在的にリスクがないことを認証した上で新しいAIモデルをリリースすべきかなどについて、意見を募る。

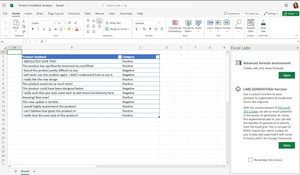

パブリックコメントの専用Webサイトには「AIシステムに対する信頼を獲得するためのAI監査、評価、認証、そのほかのメカニズムの開発のための政策について意見を求める」と記されている。

財務監査が企業の財務諸表の正確性への信頼につながっているような仕組みが、AIでも必要ではないか、としている。

NTIAのAlan Davidson氏は「(AIモデルが)責任を伴って使用されることを確実にするために、ガードレールのようなものを置く必要がある」とWall Street Journalにコメントしている。

OpenAIとの提携を通じて積極的にAIを取り込んでいるMicrosoftは同日、NTIAの動きに賛同し「広く意見を募って問題を慎重に検討し、迅速に行動しようとする政府の動きを歓迎すべきだ」とWall Street Journalにコメントしている。

4月に入り、イタリア政府がデータプライバシー、子どもへの安全などを懸念にあげてChatGPTを一時的に禁止する動きに出た。Wall Street Journalによると、中国でも同日、規制が提案されたとのことだ。パブリックコメントは6月10日まで受け付ける。