日本IBMは6月8日、AI(人工知能)倫理に関する調査レポート「AI倫理の実践 - 信頼できるAI実現へ、全社的取り組みを」の日本語版を発表し、同日に記者説明会を開催した。なお、調査の全内容は「AI 倫理の実践:信頼できるAI実現へ全社的取り組みを(日本語PDF)」で閲覧できる。

同レポートは、IBMのシンクタンクであるIBM Institute for Business Value(IBV)がオックスフォード・エコノミクス社の協力のもと、昨年5月~7月までを調査期間とし、北米、中南米、欧州、中東、アフリカ、アジアを含む22カ国を拠点とする組織の1200人の経営層と、22以上の業種にわたる事業・技術部門の16役職に対して、経営者がAI倫理の重要性についてどのように考え、また組織がそれをどのように運用しているか、調査を実施したものとなる。

AI倫理は実践の段階へ

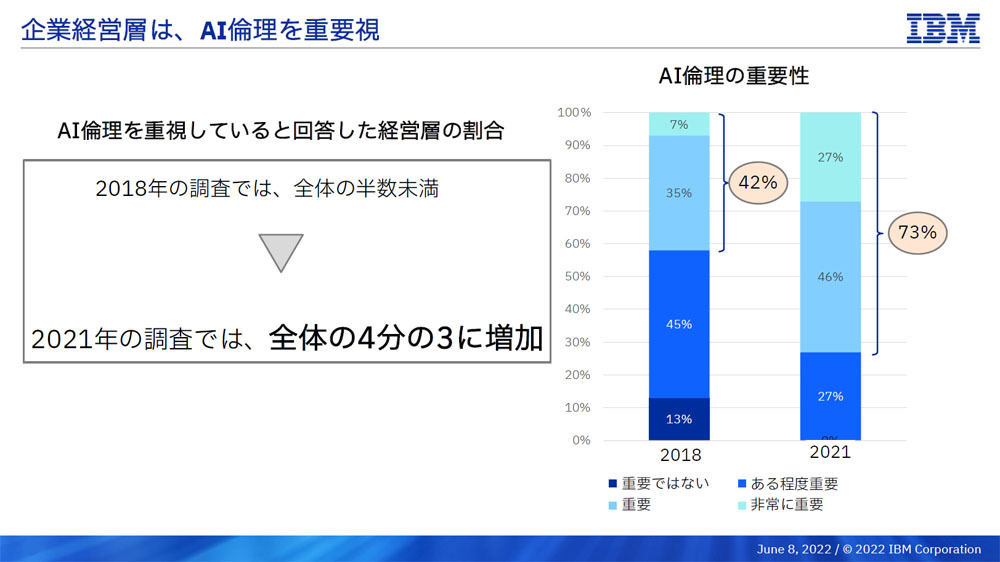

日本IBM 執行役員&IBM技術理事 IBMコンサルティング事業本部 AIセンター長 データ・サイエンティス職リーダー 工学博士の山田敦氏は調査結果を振り返り「昨今では、企業においてDX(デジタルトランスフォーメーション)の専門部署を設置するなど、AIとAI倫理が戦略的に重要だと経営層はとらえられている。AI倫理を重視していると回答した経営層の割合は、2018年の調査では全体の半数未満(42%)だったが、2021年の調査では全体の4分の3(73%)に増加した。AI倫理は従来の認知、原則から“実践”の段階を迎えている」との認識を示した。

今回の調査結果では、組織におけるAI倫理の指導と維持に責任を持つ役割の根本的な変化が明らかになり、回答者の80%がAI倫理について責任を負うべき主な職務を問われた際、CEOなど非技術部門のリーダーをAI倫理の責任者・推進者として挙げ、2018年調査時の15%から上昇したという。

一方、調査対象のCEOの79%が2018年の20%からAIの実践にAI倫理に取り組む準備を整え、回答した組織の半数以上がAI倫理に関する共通原則を公に支持している。

しかし、回答した組織の4分の1未満しかAI倫理を運用可能にしておらず、自社の慣行や行動が既定された原則や価値観と一致する(あるいは上回る)ことに強く同意した回答者はわずか20%未満となっており、山田氏は「企業はAI倫理原則には賛同しているが、自社の実践には遅れが生じており、意欲と行動には大きなギャップが存在する」と指摘。

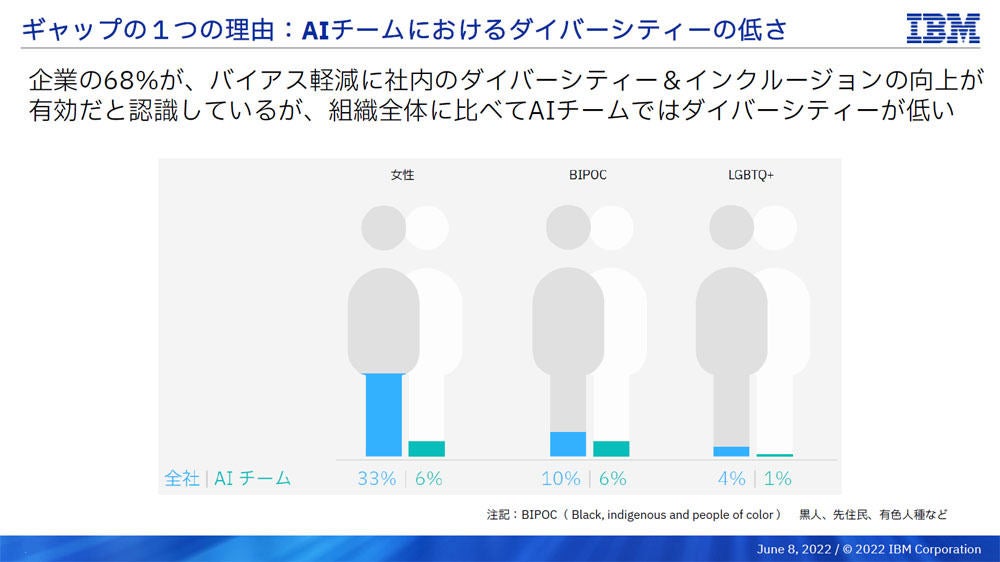

ギャップが生じる理由の1つとしては、調査対象となった組織の68%はAIにおけるバイアスを軽減するためには多様かつ開放的な職場環境を持つことが重要であることを認識しているものの、調査結果によるとAIチームは実質的に多様性が他の組織より低く、女性の割合が5.5倍、LGBTQなどの割合が4倍、人種的な割合が1.7倍低いことが挙げられるという。

また、CEO(28%)や取締役会(10%)、法律顧問(10%)、プライバシー担当役員(8%)、リスクおよびコンプライアンス担当役員(6%)は、AI倫理に最も責任があると見られていることが調査対象者により示唆され、回答者の66%は組織の倫理戦略に強い影響力を持つとして、CEOやそのほかの役員を挙げるているほか、半数以上が取締役会の指示(58%)と株主コミュニティ(53%)も列挙している。

加えて、調査対象のビジネスリーダーの4分の3以上が、AI倫理が組織にとって重要であることに同意しており、2018年時の約50%から上昇したと同時に75%の回答者が倫理を競争上の差別化要因になると考え、67%以上の回答者がAIならびにAI倫理を重要視していることから、サステナビリティ、社会的責任、ダイバーシティとインクルージョンの面で他社をしのぐであろうと回答している。

さらに、多くの企業が前進し始め、実際に回答者の半数以上がAI倫理をビジネス倫理への既存アプローチに組み込むための対策を講じたと回答したことに加え、回答者の45%以上がAIプロジェクトのリスク・アセスメント・フレームワークや監査/レビュー・プロセスなどAIに特化した倫理メカニズムを作成したと回答している、

IBMが提言する3重点分野のアクションと取り組み

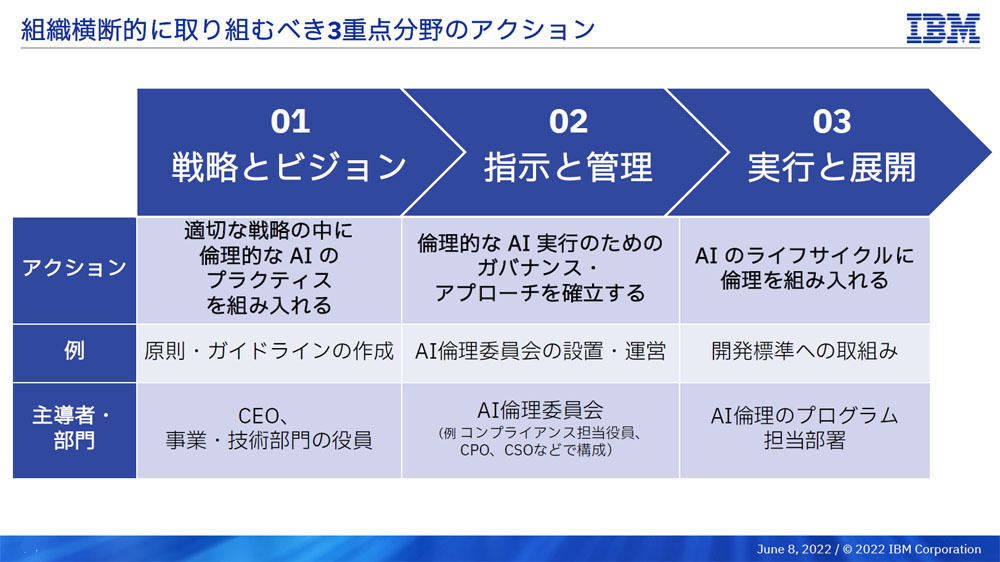

このような調査結果をふまえ、IBMでは広範なAI倫理戦略を事業単位全体にわたって実施する組織は、今後は競争優位を持つ可能性があることが示唆されていることから、組織横断的に取り組むべき3重点分野のアクションを提言している。

1点目は「戦略とビジョン」。アクションは適切な戦略の中に倫理的なAIのプラクティスを組み入れ、例えば原則・ガイドラインの作成を挙げ、主導者・部門はCEO、事業・技術部門の役員としている。

2点目は「指示と管理」となり、アクションとしてはリン的なAI実行のためのガバナンス・アプローチを確立し、一例としてAI倫理員会の設置・運営としており、主導者・部門はAI倫理委員会(ex.コンプライアンス担当役員、CPO、CSOなどで構成)を想定。

そして、3点目は「実行と展開」だ。AIのライフサイクルに倫理を組み入れることをアクションとしており、例として開発標準への取り組みを挙げ、主導者・部門はAI倫理のプログラム担当部署となる。

これまでもIBMではAI倫理に取り組んでおり、2018年5月に「信頼と透明性」に関する原則を公表し、AIの目的は人間の知性を補い、データと知見は作成者に帰属し、AIを含む新しい技術は透明で説明可能でなければならないと位置付けている。

また、同9月には設計者と開発者のための実践的なガイド「Everyday Ethics for Artificial Intelligence」で「説明責任」「価値観の一致」「説明可能性」「公平性」「ユーザーデータの権利」の5つのプリンシパルを提示。同年には社内にAI倫理委員会を設け、AI倫理のビジョン、戦略、見解の策定など組織横断的にAI倫理の実践を推進している。

同社におけるAI倫理リスク評価プロセスは(1)社員によるチェックリストでのリスク評価、(2)事業部のAI倫理担当と法務担当による判断、(3)AI倫理委員会の審査による判断となり、(2)と(3)を都度、(1)にフィードバックするというものだ。

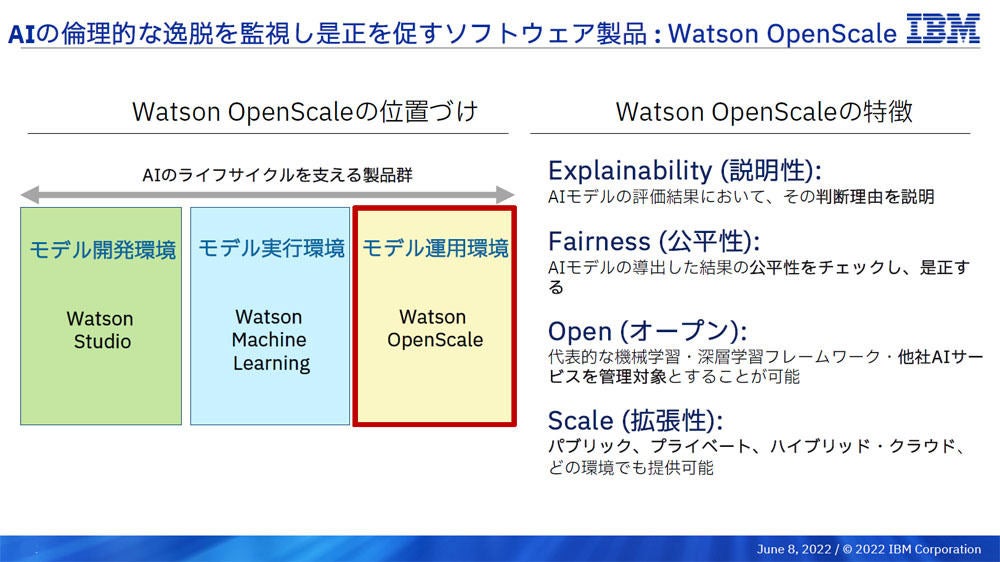

さらに、全社向けの研修として「IBM AI Skills Academy」を実施し、修了後にはデジタルバッジを付与しているほか、AIの倫理的な逸脱を監視して是正を促すソフトウェア製品「Watson OpenScale」や、産総研が主導して策定した「機械学習品質マネジメントガイドライン」を活用した機械学習(ML)モデルの品質を診断するサービス「IBM ML品質診断サービス」などを提供しており、積極的にAI倫理に関する取り組みを進めている。

日本IBM 東京基礎研究所 AI担当シニア・マネージャー Senior Technical Staff Member 工学博士の立花隆輝氏は「当社は、人間の能力を置き換えるのではなく、人間の能力を増幅して強化するようなAIシステムを作るという考え方である『HCAI(Human Centered AI)』という研究戦略のもと、いくもの研究プロジェクトを進めている。これは人とAIの共同作業、人と同じ価値観を実装したAI、人と会話するAIの使うべき言葉という3つの重点領域を掲げており、こうした考えを今後の製品に組み込まれていくことが期待されている」と述べていた。