Kinectで実現に向かう「物理環境と仮想環境の結合」

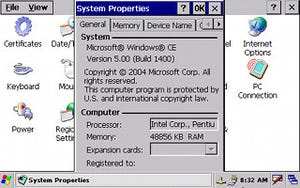

次世代のMicrosoftにつながる技術や情報を紹介する同社のブログ「Next at Microsoft」では、Microsoft UKのアーキテクト(システムエンジニアの上級職)であるDave Brown(デーブ・ブラウン)氏の個人ブログを紹介している。Brown氏はテーブル型コンピュータープラットフォームである「Microsoft PixelSense」の開発に携わり、宇宙をその指で操作する「NUIverse」の開発者(図06~07)。

残念ながら個人がMicrosoft PixelSenseに触れるシーンは少ないため、ピンと来ない方が大勢かもしれないが、その代役として、タッチ機能を備えるWindows 7およびWindows 8上でNUIverseを楽しめる「NUIverse for Windows」が公開されている。通常のコンピューターでもマウスで操作できるが、コンセプトが大きくずれてしまうため、やはりタッチ機能を備えたWindows 8マシンで試してほしい。なお、初期状態はフルスクリーン表示だが、「NUIverse.exe.config」の「

さて、「Next at Microsoft」の編集者であるSteve Clayton(スティーブ・クレイトン)氏がピックアップしたのは、NUIverseではない。Kinectで録画したホログラフィックビデオをリアルタイムにレンダリングする構造「Holographic Recordings」だ。Brown氏のブログで視聴できる動画では、映画「スター・ウォーズ」に登場するレイア姫を映し出している。映画の一シーンを思い出すようなデモンストレーションだ(図09)。

Clayton氏はもう一つのコンテンツとして、オレゴン州にある「Second Story Interactive Studio」のブログも紹介している。同社は社名が表すようにインタラクティブなコンテンツの作成を得意とする会社だが、現在Kinectを利用した「Lose Your Occlusion」と呼ばれるプロジェクトが進行中だという。

具体的には複数のKinectを利用し、センサー機能でフル3Dモデルを作成。複数のデータを一つのメッシュデータに結合する実験だという。動画を視聴する限り、結合処理は完全ではないものの、フル解像度(Kinectの深度カメラは320×240ピクセル、カラーカメラは1280×960ピクセルである)で正確なモデルを得ているのは興味深い(図10~12)。

物理環境と仮想環境の混合は、Kinect for Windows SDK 1.7に含まれる「Kinect Fusion」を利用することで3Dスキャンが可能になるのは以前の記事でも紹介したとおりだ(図13)。

Kinectによる物理環境と仮想環境を混合し、人が仮想空間に滞在するような世界はスタートにも至っておらず、我々が何らかの利益を享受する時点まで進んではいない。そのため、Clayton氏はKinectを利用した応用研究例として、二つの記事を取り上げたのだろう。次期Xboxの登場でKinect for Xbox 360に変化が生じるのか判断できないものの、Kinectを軸としたNUIや仮想空間の利用が近い将来に存在することを示している。映画やSF小説で夢に描いた世界は決して遠くはない。

阿久津良和(Cactus)