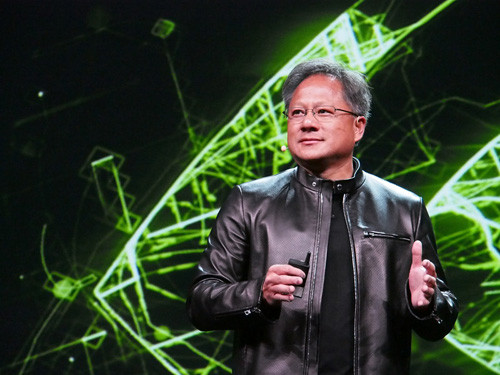

米NVIDIAは2016年4月4日から7日(米国時間)まで、米国サンノゼ市で、技術カンファレンス「GTC2016」を開催した。ここでは5日に行われた同社CEOのジェンスン・ファン(Jen-Hsun Huang)氏の基調講演をレポートする。今回の講演では「NVIDIA SDK」、「IRAY VR」、「Tesla P100」、「DGX-1」、「自立運転カーレース」の5つが発表された。

ファン氏が最初に触れたのは「NVIDIA SDK」で、これはGPUや組み込み向け開発ボード「Jetson」用のSDKをまとめたものだ。計算やゲーム、VR、デザイン、自動運転の5つの分野をカバーする。ただし、ゲーム開発者向けの「GameWorks」や、デザイナー向けの「DesignWorks」など、個々のSDKはすでに提供されているものもあり、それらはこれまでどおりだ。なお、CUDAに関しては、Pascalアーキテクチャに対応した「CUDA8」が6月に登場する予定という。

GPUレンダリングシステム「IRAY」をVRにも

次にファン氏は、VR(Virtual Reality。仮想現実)について話を始める。すでにVRゴーグルがいくつも発表されており、多数のカメラを組み合わせて、VR用動画を撮影する機器なども開発されている。また、VRに関する起業も増えてきているという。

VR分野では、ゴーグルを装着する人の頭部の動きに合わせて高速に描画を行なう必要があり、これにハイエンドGPUが活用されている。NVIDIAは、VRの技術デモとして「EVEREST VR」「MARS 2030」という2つのVRコンテンツを作成した。EVEREST VRは、エベレスト山を体験できるVRコンテンツで、風で雪が舞い上がる様子なども見て取れた。

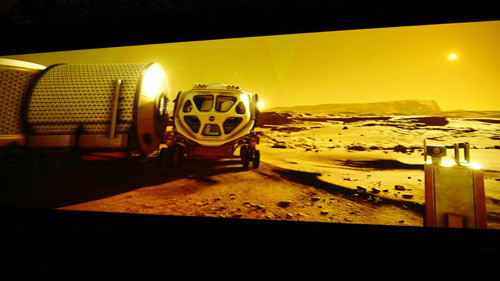

これに対してMARS 2030は、火星での宇宙飛行士の活動をシミュレートするもの。地表を歩いたり、車両に乗って移動できる。車両にはナビゲーションシステムなどがあり、オーバーヘッドディスプレイのように経路や目的地を表示しており、車載コンピュータの音声によるガイドもある本格的なものだ。映画「オデッセイ」の世界を体験できるVRというと少しわかりやすいだろうか。

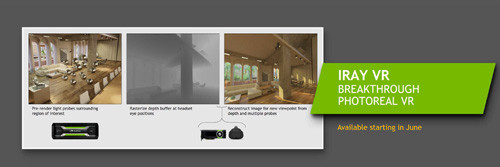

GPUレンダリングシステムである「IRAY」は、工業デザイン向けにCADなどで設計したデザインを、写真のように高精細なグラフィックスとして、リアルタイムで描画するような用途に使われてきた。今回発表された「IRAY VR」は、VRゴーグルに出力できるシステムで、写真のようなVR表示を可能にするという。出荷は6月の予定だ。

なお、IRAY VR用に作成したVRコンテンツは、アンドロイドアプリケーションであるIRAY VR Liteと、スマートフォンを利用したVRゴーグルと組み合わせて見ることも可能になるようだ。

|

アンドロイドアプリのIRAY VR Liteも開発中で、オートディスクの3ds maxにプラグインを入れることでVRによる視聴が可能になる。視聴にはスマートフォンを利用したVRゴーグルやビューアー(CardBoardなど)を使う |

Pascalアーキテクチャによるディープラーニング向けGPU「TESLA P100」

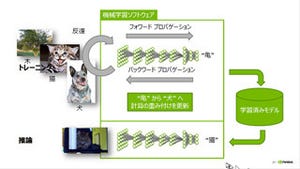

次はディープラーニングについてだ。ファン氏は、2016年は「AIにとって面白い年」だとして、Googleが開発したコンピュータ囲碁ソフト「Alpha Go」といった最新の話題について触れた後、ディープラーニング以前と以後の画像認識の進歩について紹介し、「ディープラーニングは、新しいコンピューティングモデルになった」という。

つまり、コードを書いて特徴量を抽出して画像を識別する方法にかわって、ディープラーニングを使って画像を学習させ、認識システムを作るというやり方は、ほかの技術に対しても有効だという意味だ。

さらにファン氏は、「AI技術はソフトウェアを作るフレームワークから、プラットフォームへと変化しつつある」と主張する。すでに多くのディープラーニング関連のスタートアップ企業ができ、さらに多くの既存企業もディープラーニングを自社の製品や社内のシステムに取り入れている状況がその背景にある。

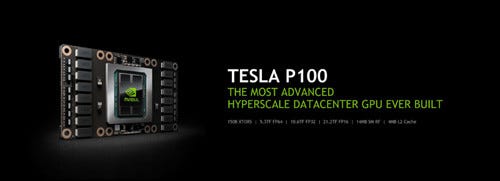

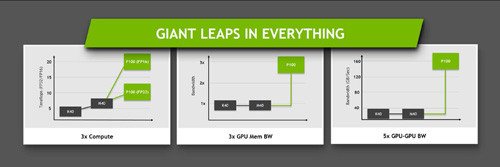

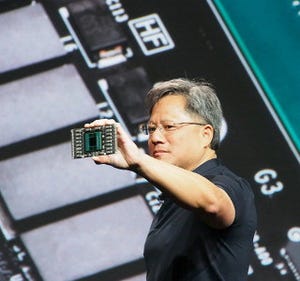

そして発表したのが、TESLA P100チップだ。ファン氏はこれを「ハイパースケールデータセンターGPU」と表現する。P100は、2015年発表されたPascalアーキテクチャをベースとしたGPUで、半精度浮動小数点のサポートや14MBのレジスタファイルなどを搭載するほか、4MBのL2キャッシュを備える。

また、Maxwellでは32基のCUDAコアを1組とし、これを4つ組み合わせて1つのStreaming Multiprocessor(SM)としていた(つまり、SMあたり128基のCUDAコア)が、CUDAコアの稼働率をより上げるため、Pascalでは2組で1つのSM(SMあたり64基のCUDAコア)として、より細かい単位での制御を可能にしている。SMの数を増やせばそれぞれが別のタスクを実行できる。

SMの数が増えたことに応じて、レジスタファイル(演算で利用するレジスタ)も増えている。1つのSMが持つレジスタファイルの数は、Maxwellと同じく256KBだが、SM内のCUDAコアの数が減っているため、CUDAコアで利用可能なレジスタ数は増えていることになる。

これにより、ディープラーニングではノードの「重み」(個々のノードが持つ入力信号につける重み付け。学習時には、この重みを増減させて望む結果を得られるようにする)をレジスタに置いて計算することが可能となり、計算処理が高速化できるという。

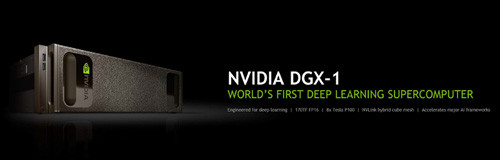

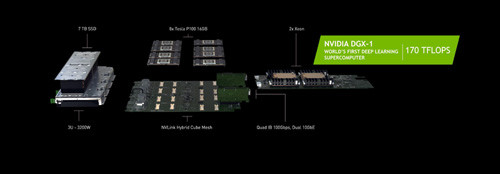

TESLA P100を搭載したサーバーは、IBM、Hewlett Packard Enterprise、DELL、CRAYの4社より2017年の第1四半期に登場する予定だという。続けてファン氏は、8基のTESLA P100と2基のIntel Xeon E5 2698 v3(2.3GHz。16コア)を搭載したスーパーコンピューター「DGX-1」も合わせて発表した。

「DGX-1」は、著名な画像認識ディープラーニングシステムであるAlexnetの学習を2時間で終了させるほどの性能を持つ。同じ処理をCPUであるXeon側だけで行なうと150時間かかり、同じ2時間で終了させるには、250台のXeonサーバーが必要になるとし、「DGX-1は、サーバー250台が1つの箱に入っているのと同じ」とアピールする。

|

DGX-1では、ALEXNETの学習を2時間で終えることができ、同じ学習をXeon側で行わせると150時間となる。逆にXeonで同等の性能を出すには、250台のXeonサーバーが必要であり、これをもって、250台のサーバーが1つの箱に入っていると主張する |

その後、Baiduのディープラーニングの担当者が登場したが、レジスタに重みを置いて処理を行なうことで高速化できるメリットをうったえた。

「DRIVE PX2」を搭載した自動運転車によるレースも開催

5つめの発表は、自動運転に関連するものだ。自動運転は「地図」や「Localize」、「SEE」、「DRIVE」といった各要素を利用するが、利用時にセンサで情報を収集し、学習を行なうことで、より高い精度での状況認識や運転が可能になるという。これに向けて、同社の車載向け開発ボード「DRIVE PX」やDGX-1が利用できるとする。その後、NVIDIAのデバイスを使ったBaiduの自動運転車用コンピュータを紹介、NVIDAの自動運転車の開発の模様を示すビデオを流した。

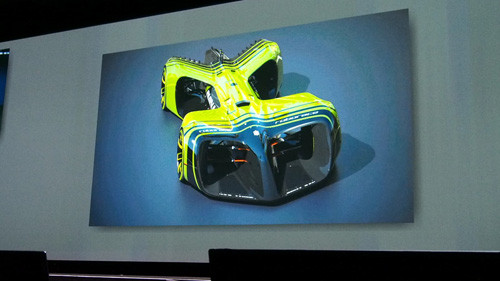

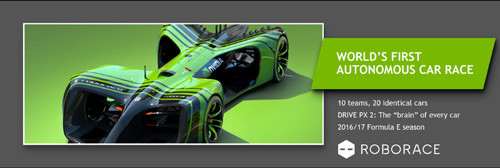

そしてジェンスンCEOが見せたのが、「世界初」だという開発中の自動運転レースカー。デザインは、映画「トロン:レガシー」の車両デザインなども行うドイツの自動車デザイナー ダニエル・シモン氏が手がけたという。

この車は、2016~2017年に開催される自動運転車によるレース「ROBORACE」に参加する。同レースには10チームから計20台の自動運転車が参加する予定で、NVIDIAが各チームに「DRIVE PX2」を供給するという。ROBORACEのホームページには、同じくNVIDAロゴをつけた車の写真が掲載されている。

ディープラーニングで先行するNVIDIA - 次の一手は?

NVIDIAがディープラーニングを大きくアピールしはじめたのは、2014年のGTCからだ。続く2015年のGTCでは、NVIDIAがディープラーニングにリソースを集中させる方向へと転換したことが見て取れた。そして今回、それを裏付けるように具体的な製品が登場している。

NVIDIAは、ディープラーニングなどのAIを主要なターゲットとし、その応用として自動運転について、精力を傾けている。しかし、古くからのGTC参加者の中には、ディープラーニング関連のセッションが増え、GPU本来の応用やグラフィックス関連のセッションが減ったことに不満を持つ人もいる。リソースが限られる場合、新たに何かを得えようとすれば、何かを失うこともある。

ディープラーニングに応用可能で、汎用プロセッサよりも早いとはいえ、GPUは本来、グラフィックス用に作られたものだ。ディープラーニングといった演算処理に向けて、GPUよりも適したアーキテクチャを開発することも考えられるだろう。ただ、新規のアーキテクチャを開発するには大きなコストがかかる。すでに高速演算機能を実現しているGPUが優位であることは変わりなく、しばらくはGPUとディープラーニングがセットで語られる状況が続くだろう。

既存のプロセッサメーカーも、ディープラーニング分野が大きくなってくれば、なんらかの対応を行うだろう。今後、ディープラーニング分野における競争は激しくなっていくはずだ。いまのところ、この分野で先行したNVIDIAが、どのような手を打ってくるのか。それが次回のGTCのポイントかもしれない。