米Googleは11月13日(現地時間)、AIリサーチ支援ツール「NotebookLM」に、「Deep Research」の導入と対応する情報ソースの拡充を行うことを発表した。

Deep Researchは、AIエージェントがユーザーに代わってインターネットを横断的に調査し、出典を明示した報告書を自動で作成する機能である。NotebookLMは従来、ユーザーがアップロードまたは指定した情報源を対象にAIを利用できるツールとして機能してきた。WebサイトのURLリンクを登録して調査対象とすることはできたが、Deep ResearchはNotebookLMの機能を「外部情報の能動的な調査」へと拡張する。

Deep Researchを利用するには、ソースパネルで「ウェブサイト」を選び、研究スタイルでDeep Researchを選択する。同機能は以下のようなプロセスを自動で行う。

- 調査計画の立案:ユーザーの依頼や質問に基づいて調査プランを作成。

- Web検索と閲覧:何百ものWebサイトをユーザーに代わって閲覧・分析。

- レポート作成:収集した情報を整理し、引用元を明示したレポートを作成。

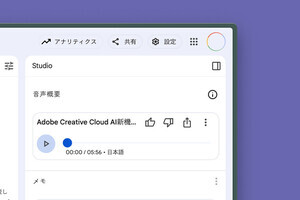

ユーザーは必要に応じて、特定の場所を検索するようDeep Researchに指示することも可能である。生成されたレポートと参照ソースは直接ノートブックに追加でき、NotebookLMではリサーチや研究プロジェクトの準備や過程にDeep Researchを組み込めることが他とは異なる。また、「音声解説」や「動画解説」といったNotebookLMの他機能と組み合わせることで、複雑なトピックやリサーチ内容の理解をより深められる。

また、今回のアップデートで情報源として以下を利用できるようになる。

- Google スプレッドシート:表形式のデータを読み込み、要約や統計的解釈を行える。

- 画像:手書きのメモやパンフレットなどの画像をアップロードして解析可能。

- Microsoft Word文書:.docxファイルのアップロードに対応。

- Googleドライブ内のPDF:ダウンロードや再アップロードを行わずにGoogleドライブ内のPDFを追加できる。

- Googleドライブ内のファイルをURLとして追加:WebサイトやYouTube動画と同様に、Googleドライブ内のファイルをURLで指定して参照可能。複数URLをカンマ区切りでまとめて追加することもできる。

これらの機能は順次ロールアウトされる予定で、多くは1週間以内に提供される見込みだが、画像解析機能のみ数週間かけて提供される予定である。