米Googleは3月21日(現地時間)、同社が研究開発を進めている対話型生成AI「Bard」の試験提供を一般に拡大すると発表した。US英語をサポート言語に米国と英国で申し込みの受け付けを開始、段階的に対象を拡大し、時間をかけて他の国や言語にも拡大していく。

昨年12月に米OpenAIが対話型AIサービス「ChatGPT」を公開し、さらに今年2月に米MicrosoftがOpenAIの大規模言語モデル(LLM)を用いた「新しいBing」のプレビュー提供を開始してから対話型AIサービスが大きな話題を集めている。そうした中、AI研究の成果の一般公開や製品化に慎重だったGoogleもそのアプローチを見直し、今年2月に同社のLLM「LaMDA」(Language Model for Dialogue Applications)を活用した「Bard」を発表、信頼できるテスターを対象としたテストを開始した。試験的提供の一般への拡大を通じてより多くのフィードバックを収集し、改善のスピードを加速させる。

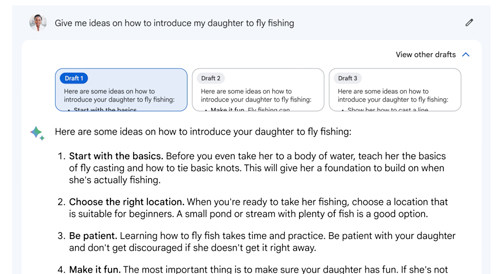

LLMへの直接的なインターフェースであるBardは、例えば「娘にフライフィッシングを教えるには?」と質問すると手順を箇条書きで示すなど、ユーザーの生産性を高め、発想や好奇心を刺激するものになるとしている。Google検索の補完的な体験と位置付けており、試験版では質問に対するBardからの回答で「Google it」をクリックするとクエリの提案が表示され、検索を実行して新しいタブで検索結果を確認できる。将来的には検索により深くLLMを統合することも考えているという。また現在の試験版はコードの生成に対応しないが、コーディングやマルチモーダル機能の追加を計画している。

LaMDAは予測エンジンのようにふるまい、プロンプトが与えられると次に来るであろう単語を1つずつ選んで応答を生成する。Googleが考える高品質な情報に基づくが、常に最も確率の高いものを選ぶとクリエイティブな回答にはならないので、ある程度の柔軟性を持たせている。

また、現実における偏見や固定観念も含む様々な情報から学習するため、それが不正確な情報や誤解を招く情報といった形で出力に現れる可能性がある。まだ研究開発途上の技術であり、入力ボックスの下に「Bard may display inaccurate or offensive information that doesn't represent Google views」(Bardは、Googleの見解に沿わない不正確な情報や攻撃的な情報を表示することがあります)と表記して注意を呼びかける。