iOS 18.4のアップデートにより、iPhoneでApple Intelligenceの一部機能が利用できるようになりました(*)。Apple Intelligenceは、メールやメモ、カメラといった、日頃から使い慣れたアプリに組み込まれ、いつもの使い勝手をサポートしてくれることが特徴です。

今回は、Apple Intelligenceで部分的に強化されたSiriの機能をご紹介します。とはいえ、急激に成長する他社のAIからするとまだまだ足りない部分が目立ちます。

*対応モデル

iPhone 16シリーズ、iPhone 15 Pro、iPhone 15 Pro Max

Siriの見た目が変わった

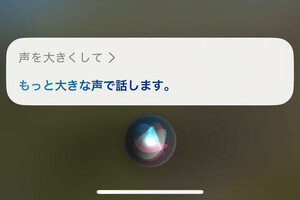

Siriを呼び出し方はこれまでと変わりません。サイドボタンを長押しするか、「Hey Siri」と呼びかけます。Siriが起動すると、画面を囲む光が表示されるようになりました。

文字入力でSiriを使えるようになった

新たに、ホームバーの2回タップでもSiriが起動するようになりました。これはタイプ入力専用です。話せない場所でSiriを使うなら、こちらが便利です。

ホームバーをタップしてもSiriが起動しない場合は、次の設定を確認しましょう。

ChatGPTの回答を参照してくれるようになった

実用性を大きく広げてくれたのがこの新機能。SiriにわからないことはChatGPTに情報を送って回答してくれるようになりました。ChatGPTアプリを開くことなく、Siri上でやり取りができます。

今後の強化に期待する機能

この他、Siriの新機能として次のようなものが紹介されています。まだ改善の余地が大きいものもあります。