今回もハード寄りの話です。前回は撮像素子のシャッターの方式についてでした。今回は、光学的に光を集光するレンズについて書きたいと思います。レンズを購入する際に、焦点距離、F値、MTFという数値をチェックしてますか? 今回はレンズの仕様・性能を表すこれらの数値について概要をご紹介します。

焦点距離とは?

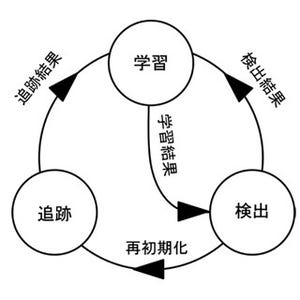

一般的なカメラは図1の通りピンホールモデルとして扱うことができます。入射光はレンズの焦点を通り、撮像素子で受光します。撮像素子から焦点までの距離が焦点距離です。

焦点距離が短くなると図2のように、図1の焦点距離が長い場合と比較して、広い範囲の光を受光することができます。つまり、遠くをズームインして撮影したい場合は、焦点距離の長いレンズを、広い範囲をズームアウトして撮りたい場合は、短焦点レンズを選ぶ必要があります。

F値とは?

F値(F-number)という単語を聞いたことはありますか? 一眼レフなどのレンズ交換式カメラのレンズにはほぼ必ず記載されている値で、レンズの明るさを表します。F値は、レンズの焦点距離を有効口径で割った値で、値が小さいほど明るいレンズとなります。

F値の2乗に反比例して入射光量は少なくなります。具体的には、F値が2のレンズ「1/(22)=1/4」に比べ、F値が2.8のレンズ「1/(2.82)≒1/8」は入射光が半分になります。暗い環境下でなるべくノイズの少ない画像を取りたい場合は、F値が小さく明るいレンズを選びましょう。

また、F値の小さい明るいレンズの方が被写界深度(ピントの合う奥行き幅)が浅く、背景のぼけた画像になります。背景をぼかしたい場合は、F値の小さいレンズ、ぼかしたくない場合はF値の大きいレンズ(または絞りを調整)が良いでしょう。

MTFとは?

MTF(Modulation Transfer Function)は、レンズの解像度の性能を評価するための指標です。被写体の持つコントラストをどの程度忠実に再現できるかを空間周波数特性として数値化したものです。

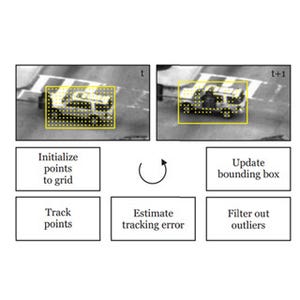

MTFの測定には図3のように白と黒が周期的にsinカーブ状に変化する正弦波チャートを用います。被写体のテクスチャ(チャートの白黒パターン)は、レンズを通して撮像するとコントラストが低下してしまいます。このコントラストの低下の度合いを表す数値がMTFです。空間周波数が低い(白黒パターンが太い)場合は大きな問題となり難いのですが、空間周波数が高い(白黒バターンが細い)場合は、MTFの高いレンズを用いないとコントラストの高い画像は撮れません。テクスチャの細かさによっては、MTFの低いレンズを使うと白黒パターンが完全に潰れてしまい輝度変化のないグレーとして撮像されてしまいます。

レンズを選ぶ際は、焦点距離、F値、MTFを確認するようにしましょう。撮影したい視野角、被写体の距離と認識に必要な画素数から焦点距離を決めましょう。F値は、夜間画像のノイズの少なさをどの程度優先するか、近くの物体のみに焦点を合わせて背景をぼかしたいかなどから決めると良いと思います。ただし、ある距離以上は無限遠までピントが合うので近距離を撮影対象にしない場合は被写界深度によるボケはあまり気にしなくても良いでしょう。また、細かいテクスチャを撮影したい場合、高解像度の撮像素子を用いる場合はMTFの高いレンズを選びましょう。

著者プロフィール

樋口未来(ひぐち・みらい)

日立製作所 日立研究所に入社後、自動車向けステレオカメラ、監視カメラの研究開発に従事。2011年から1年間、米国カーネギーメロン大学にて客員研究員としてカメラキャリブレーション技術の研究に携わる。

日立製作所を退職後、2016年6月にグローバルウォーカーズ株式会社を設立し、CTOとして画像/映像コンテンツ×テクノロジーをテーマにコンピュータビジョン、機械学習の研究開発に従事している。また、東京大学大学院博士課程に在学し、一人称視点映像(First-person vision, Egocentric vision)の解析に関する研究を行っている。具体的には、頭部に装着したカメラで撮影した一人称視点映像を用いて、人と人のインタラクション時の非言語コミュニケーション(うなずき等)を観測し、機械学習の枠組みでカメラ装着者がどのような人物かを推定する技術の研究に取り組んでいる。

専門:コンピュータビジョン、機械学習