ディープラーニングの活用による第3次人工知能(AI)ブームの到来、IoTのビジネスでの活用シーンの拡大、そしてそうして生み出されるビッグデータの活用と、2016年のIT/エレクトロニクス業界は、さまざまな技術トレンドが絡み合い、大きなうねりを生み出す年となった。その勢いは2017年も継続して続いていくことが期待される。

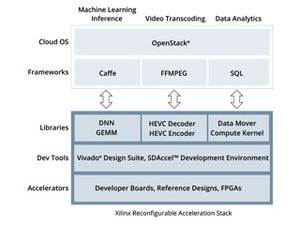

また、2016年はこれらIT/IoT技術の進展の根底に半導体の進化があることが示された年になったとも言える。例えばGoogleはディープラーニング用プロセッサ「Tensor Processing Unit(TPU)」を自社で開発していることを明らかにし、専用チップを活用することで、演算能力を消費電力をそれほど引き上げずに高められることを示した。そこで今回は、こうした演算処理を向上させるアクセラレータとして2017年も活用が期待される3つのデバイス、GPU、FPGA、コプロセッサ(Xeon Phiなど)の動向を読み解いていきたい。

半精度浮動小数点演算をサポートしたGPU

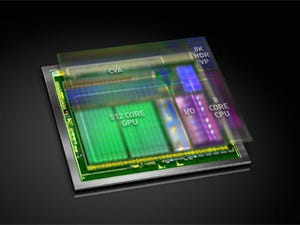

まずはGPUコンピューティングをうたい、HPCそしてディープラーニングに邁進してきたNVIDIA。同社の共同創業者 兼 CEOであるJen-Hsun Huang氏の言葉を借りれば、今や同社はGPUチップを提供する半導体ベンダから「AIコンピューティングカンパニー」へと変貌を遂げつつある。その最たる例が最新アーキテクチャであるPascal世代の「Tesla P100(GP100)」で、FP16の半精度浮動小数点演算をサポートした点である。FP16のサポートは、グラフィックス性能という点ではあまり必要なく、わざわざそれらの性能を抑えたグラフィックス用GPU(GeForce GTX 1080など)を用意するなど、用途に応じたラインアップを用意することで、同じGPUベースと言いつつも、使い分けをしつつあるように見える。

また、8ビット整数演算命令(INT8)をサポートした「Tesla P4/P40」もディープラーニングの"推論"向けに提供したほか、TensorRTやDeepStream SDKといったソフトウェアも提供することで、ディープラーニングの総合的なサポートを強化している。

GPUのもう一方の大手ベンダであるAMDも、半精度演算性能でPascalベースのTesla P100を上回る25TFLOPS(FP16)を実現する次世代アーキテクチャ「Vega」ベースのGPU「Radeon Instinct MI25」を2017年に投入することを予定しており、GPUコンピューティングブランド「Radeon Instinct」として展開していくとしている。