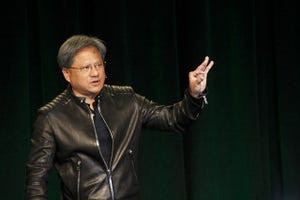

米NVIDIAが毎年米国で開催する開発者向けイベント「GPU Technology Conference」(GTC)が、3月17日(現地時間)からスタートした。会場は2014年と同じ米国カルフォルニア州サンノゼ市のコンベンションセンターだ。初日に行われる基調講演は毎年、NVIDIAの創業者でありCEOのジェンスン・ファン(Jen-hsun Huang)氏が行う。

GTC 2015のテーマは「ディープラーニング」

今回のGTCの話題は「ディープラーニング」だ。ディープラーニングとは、「ニューラルネットワーク」により「認識」や「識別」を行うシステムを構築するものだ。

ニューラルネットワークは、1980年代後半に一時ブームとなったが、当時は、初期状態の設定をランダムに行うぐらいしか方法がなく、高い認識率などを実現するのが困難だった。

しかし、現在では、「よい」初期状態を与える方法などが確立され、さまざまな分野での応用が可能になった。例えば、クラウドサービスなどが持つ、画像の認識機能や、一部の自動車などに搭載されている歩行者の認識機能、あるいは自然言語認識などに使われ始めている。

ディープラーニングには、大量の行列計算が必要で、GPUの汎用演算機能(GPGPU)と相性がいい。実際、多くのディープラーニングのシステムがGPUを利用しはじめている。この組み合わせは、2014年のGTCでも話題にはなったが、このときはGPGPUにおける1つの応用分野にすぎなかった。

しかし、2015年の基調講演を見るに、NVIDIAはディープラーニングを1つの大きな柱として考えているようだ。基調講演では、ディープラーニングの話が大半だったし、セッションも大半がディープラーニング関係で、NVIDIAがディープラーニングに注力する様子がうかがえる。

PCユーザーからみると、NVIDIAは、3Dグラフィックスカードのメーカーとして知られているが、最近CPUは、ほとんどGPUを内蔵しており、以前のようにどのPCにもグラフィックスカードが搭載されているという状況ではない。このため、NVIDAはグラフィックス以外のさまざまな分野へ方向性を模索してきた。GPUによる汎用演算もその1つで、そのためにTeslaのような科学技術計算向けのシステムなどを製品化している。

また、スマートフォンなどのモバイルのプロセッサでは、ARMのCPUコアを使ったSoC(System on a Chip:1つのチップ上にプロセッサコアやGPUなどの周辺回路を統合したもの)が多くを占めており、NVIDIAもTegraシリーズのようなSoCを投入している。

こうした中、登場した「ディープラーニング」は、GPGPUにとって大きな分野になりつつある。さまざまな開発が行われるなかで、いろいろな製品が登場しているが、GPUを使うことで、学習時間を大幅に短縮できる。GPUは計算性能だけをみれば、いまや汎用CPUを大きく上回っており、適合する処理では、高い性能を発揮できる。ディープラーニングはまさにGPGPU向けの分野なのだ。

さて、今回の基調講演では、4つのアナウンスがあった。ただし、いくつかは、すでに2015年1月のCESなどで発表されたものの、アップデートになっている。

3072個のCUDAコアを備えた「Geforce GTX TITAN X」

最初に紹介されたのは、新GPUである「Geforce GTX TITAN X」だ。Geforce GTX TITAN Xは、これまで出荷されてきたTITANシリーズの最新版で、Maxwellアーキテクチャを採用したGM200コアを搭載している。

トランジスタ数は80億個、3072個のCUDAコアを内蔵し、単精度演算で7TFLOPSテラフロップス、倍精度演算で0.2TFLOPSの性能がある。また、搭載メモリは12ギガバイトとなる。価格は999ドル。

Geforce GTX TITAN Xは、もちろん、ゲームやグラフィックスで利用できるもので、そうした紹介も行われたが、ジェンスン氏は、Geforce GTX TITAN Xでのディープラーニングの処理速度を紹介した。

Geforce GTX TITAN Xの詳細な仕様やパフォーマンスについては、下記の記事を参照されたい。

| 【米NVIDIA、999ドルの新フラグシップGPU「GeForce GTX TITAN X」を正式発表 | |

| 【レビュー】NVIDIA GeForce GTX TITAN Xを試す - Maxwell世代の新フラグシップGPUの実力を探る |

ディープラーニングを対象とした「DIGITS DevBox」を5月に出荷

次の製品は、まさにディープラーニングを対象とした製品だ。NVIDAのディープラーニング用のソフトウェアパッケージ「DIGITS Deep Learning GPU Training System」とこれを高速で実行できる「DIGITS DevBOX」だ。

|

|

ディープラーニング用ソフトウェアDIGITS。既存のディープラーニングライブラリ(バークレーのCaffeなど)を利用し、GPU対応が行われている。GPUは、クラウドやクラスターなどさまざまなものが利用できる |

DIGITSは、すでにディープラーニング用として利用されているCaffe(UCバークレー開発のディープラーニングフレームワーク)を中心に、Torch(Luaスクリプトを使うディープラーニングライブラリ)、Theano(Pythonを使うディープラーニング用ライブラリ)などをサポートし、GPU側のインタフェースやユーザーインタフェースなどをまとめたソフトウェアパッケージで、オープンソースとして入手できる。

このDIGITSが導入されているディープラーニング開発者向けのハードウェアが「DIGITS DevBox」だ。ただし、DevBoxは、いわゆるワークステーションクラスのPCであり、そこにTITAN Xを装着して利用する。OSとしてはLinuxが採用されていて、前述のようにDIGITSが導入されている。2014年の5月から出荷開始で、価格は15,000ドル。